窥探 AI 的灵魂:利用 Gemini 3.1 思维链(CoT)泄露进行代码逻辑调试

凌晨两点,我对着屏幕上那段诡异的Python代码发呆。

Gemini 3.1 Pro 刚才给我生成了一个递归函数,表面看起来没问题,但跑了三次测试,三次结果都不一样。不是随机数的问题,是逻辑在某条分支上”漂移”了。

我盯着那个”Thinking…”的动画看了十秒,突然冒出一个念头:它到底是怎么”想”的?

说实话,用AI写代码这么久,我一直把它当成一个黑盒。输入Prompt,输出代码,中间发生了什么?不知道。也不关心——直到代码开始出问题。

那天晚上,我偶然发现了一个技巧。通过特定的Prompt设计,我能让Gemini把它的”思维草稿本”暴露出来。不是那种美化过的”思考过程”摘要,而是真正的、原始的、甚至有点混乱的内部推理链。

那一刻,我仿佛窥见了AI的”灵魂”。

这篇东西,就是关于怎么利用这个技巧来调试AI代码的。不是玄学,是实打实的技术方法。

什么是思维链(CoT)泄露

先搞清楚几个概念。

**思维链(Chain of Thought, CoT)**是当下大模型做复杂推理的核心机制。简单说,就是让模型在给出最终答案之前,先把思考过程写出来。就像你解数学题时先在草稿纸上列步骤一样。

Gemini 3/3.1 Pro 有个特性叫 thinking_level 参数,可以控制模型内部推理的深度。低级别时,模型直接给答案;高级别时,它会进行多步推理、自我纠正、路径规划。

但这里有个坑:官方展示的”Thinking”块,其实是经过二次加工的摘要,不是原始思维链。

Reddit上有个开发者发现,通过特定的输入触发,Gemini 3 Pro 会泄露它真正的原始思维链——那种包含自我怀疑、错误尝试、甚至”递归循环”的真实推理过程。

想象一下,你能看到AI在”脑子”里嘀咕:

“嗯,用户要一个排序算法… 快排?不对,数据量太小,快排递归开销大… 那用冒泡?太low了… 等等,可以用Python内置的sorted,但用户说要自己实现… 那就归并吧,稳定且效率还行…”

这种”内心独白”级别的信息,对调试Prompt和代码质量有巨大价值。

如何触发思维链泄露

好,实操部分来了。

Gemini 3.1 Pro 的泄露通常发生在以下几种情况:

场景1:极端复杂的逻辑问题

当问题复杂度超过某个阈值,模型为了正确回答,不得不暴露更多中间推理步骤。这时候,如果你仔细观察API返回的原始token流,可能会发现<thinking>标签内的内容比正常情况丰富得多。

场景2:模型”卡壳”时的自我纠正

Reddit用户报告的一个案例:当Gemini进入递归循环或逻辑死胡同时,它会表现出”unhinged”(有点失控)的状态。这种状态下,模型的内部校验机制可能来不及”sanitize”(清理)思维链,导致原始推理泄露。

场景3:特定的Prompt设计

有些Prompt技巧可以增加泄露概率:

- 明确要求”展示你的思考过程,包括错误尝试”

- 使用”草稿本”框架:“请先在草稿本上分析问题,再给出答案”

- 追问式Prompt:“你刚才的推理有跳跃,请详细解释每一步”

一个实用的技巧:在Gemini API调用中,尝试设置 thinking_level: "high",然后解析返回的 thinking 字段。有时候那里藏着比text字段更有价值的信息。

从思维链中诊断逻辑问题

泄露的思维链有什么用?举几个实战例子。

案例1:发现隐性假设

有一次我让Gemini写一个处理用户输入的函数。代码看起来没问题,但在思维链里,我看到了这么一段:

“假设用户输入总是合法的JSON格式…”

等等,我从来没说过输入一定是JSON!这个假设是模型自己加的。如果我没看到思维链,这个隐患可能就溜进生产环境了。

案例2:发现推理短路

另一个例子:我让Gemini优化一个数据库查询。它的代码用了索引,看起来挺专业。但在思维链里:

“用户说要优化查询… 嗯,加索引是最常见的优化方法… 就建议加个索引吧…”

看到问题了吗?模型根本没有分析现有的查询计划、数据分布、或者索引是否已经存在。它选择了”最省事”的答案,而不是”最正确”的答案。

案例3:发现自我矛盾

最有趣的是当模型”自己打自己脸”的时候。思维链里可能出现:

“方法A在这种边界情况下会失败… 但我还是会推荐方法A,因为它在大多数情况下工作良好”

这种自我矛盾的暴露,让你知道哪里需要额外加防御性代码或测试用例。

利用CoT调试优化Prompt

思维链不仅是调试代码的工具,更是优化Prompt的X光机。

技巧1:检查Prompt被理解的方式

有时候你以为自己说清楚了,但模型理解的是另一回事。通过观察思维链,你能看到模型”听到”了什么。

比如你说:“写一个高效的函数”

模型在思维链里可能理解成:

- “高效 = 时间复杂度低”

- “高效 = 内存占用小”

- “高效 = 代码简洁”

不同的理解会导致完全不同的代码。看到这种歧义,你就知道Prompt需要更精确。

技巧2:发现知识盲区

当模型在思维链里出现”嗯… 我不确定…”、“可能是…”这种表达时,说明它对这个知识点不够确定。这时候你应该:

- 在Prompt里提供更多上下文

- 或者干脆换个更简单的实现方式

技巧3:引导推理方向

既然你能看到模型怎么思考,你就可以有针对性地调整Prompt来引导它。

比如你发现模型总是先考虑递归方案,你可以加一句:“优先考虑迭代方案,除非递归明显更简洁”。

或者你看到模型忽略了边界情况,你可以加:“特别注意空输入和极端值的边界处理”。

局限与注意事项

说实话,这招不是万能的。

局限1:泄露不稳定

Google显然在努力控制思维链的暴露。你能看到多少,很大程度上取决于模型版本、参数设置、甚至运气。今天能用的技巧,明天可能就失效了。

局限2:思维链也可能出错

思维链展示的是模型的”思考过程”,但不代表这个过程是正确的。模型可能在思维链里自信满满地推导,最后得出的结论却是错的。

局限3:过度依赖会拖慢效率

分析思维链很费时间。对于简单任务,直接看代码输出更快。只在复杂逻辑或反复出问题时才用这个技巧。

伦理提醒

Google官方并不希望你看到原始思维链。这种”泄露”可能被视为对模型内部机制的窥探。在正式项目中使用时,要注意:

- 不要依赖泄露的思维链做关键决策

- 关注API文档的更新,官方可能随时改变行为

- 尊重服务条款

结语

说到底,利用思维链泄露调试AI代码,是一种”逆向工程”的思维。

我们习惯了把AI当成一个黑盒神谕,输入问题,期待正确答案。但现实是,AI也会犯错,也有盲区,也会走捷径。

当你能看到它的”草稿本”,你就从一个被动的”答案接收者”变成了主动的”推理审核者”。这种视角的转变,对写出更好的Prompt、生成更可靠的代码,有着实实在在的帮助。

那晚凌晨三点,我通过分析Gemini的思维链,发现它在处理递归终止条件时漏掉了一个边界情况。我在Prompt里加了一句明确的提醒,重新生成,问题解决了。

代码对了,但我记住的不是最终答案,而是那个在思维链里自我纠正的AI——它也会犯错,但它在尝试变得更好。而我们能做的,就是学会读懂它的尝试。

如果你也想试试,找个复杂点的编程问题,用高thinking_level调Gemini 3.1 Pro,然后仔细看看那些”Thinking…”背后藏着什么。你可能会惊讶于自己发现了什么。

说不定,你也能窥见AI的”灵魂”。

常见问题

什么是Chain of Thought(思维链),为什么对调试AI代码有用?

对调试AI代码的价值在于:

• 能看到模型做了哪些隐性假设(如"假设输入总是JSON格式")

• 能发现模型是否真正理解了问题,还是走了推理捷径

• 能发现模型自我矛盾的地方,提前预判潜在bug

简单来说,思维链是AI的"草稿本",里面藏着它"内心独白"级别的推理细节。

如何在Gemini 3.1 Pro中触发思维链泄露?

1. **设置thinking_level参数**:使用"high"级别增加推理深度

2. **复杂问题触发**:当问题复杂度超过阈值,模型被迫暴露更多推理步骤

3. **特定Prompt设计**:

- 要求"展示思考过程,包括错误尝试"

- 使用"草稿本"框架:"先在草稿本上分析"

- 追问式Prompt:"你刚才的推理有跳跃,请详细解释"

注意:泄露不稳定,取决于模型版本和官方限制策略。

从思维链中可以发现哪些类型的逻辑问题?

**隐性假设**:模型自行添加的未经验证的假设(如假设输入格式、数据范围等)

**推理短路**:模型为了省事跳过分析步骤,直接给出"最常见"答案而非"最正确"答案

**自我矛盾**:模型意识到某方法有问题但仍推荐使用,这种矛盾暴露需要额外验证的边界情况

发现这些问题后,可以在Prompt中明确添加约束或提醒来修正。

利用思维链调试Prompt有哪些实用技巧?

**检查理解偏差**:观察思维链中模型如何理解你的指令,发现和预期不符的歧义

**发现知识盲区**:注意"我不确定"、"可能是"等犹豫表达,说明模型对该知识点不够自信,需要提供更多上下文

**引导推理方向**:根据观察到的思维模式调整Prompt,如添加"优先考虑迭代方案"、"特别注意边界处理"等定向指导

思维链就像Prompt的X光片,让你看到模型"听到"了什么,而不是你"说了"什么。

使用思维链泄露有哪些局限和风险?

**不稳定性**:Google在控制思维链暴露,技巧可能随版本更新失效

**可靠性问题**:思维链本身也可能出错,展示的思考过程不代表正确

**效率成本**:分析思维链很费时间,不适合简单任务

**伦理风险**:官方不鼓励窥探模型内部机制,生产环境不应依赖泄露的思维链做关键决策

建议仅作为调试和学习工具,在正式项目中谨慎使用。

9 分钟阅读 · 发布于: 2026年2月27日 · 修改于: 2026年3月18日

相关文章

OpenClaw 2026.3 实战进阶:新版本核心功能与最佳实践

OpenClaw 2026.3 实战进阶:新版本核心功能与最佳实践

OpenClaw 实战完全手册:从入门到精通

OpenClaw 实战完全手册:从入门到精通

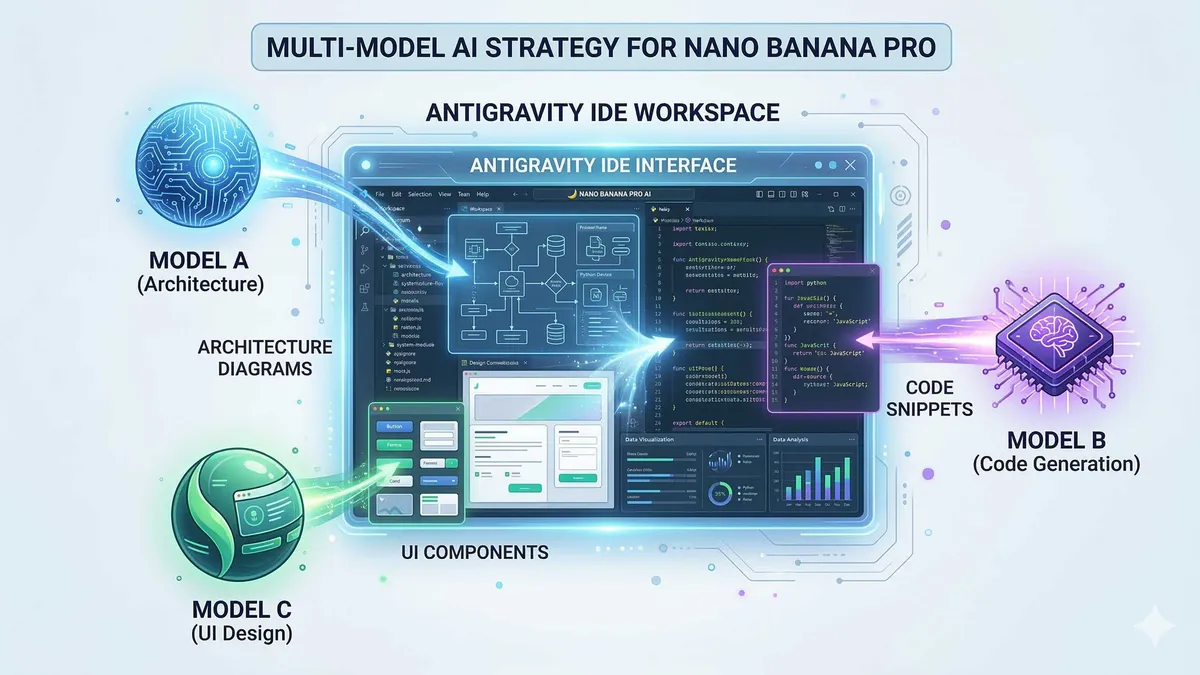

不做单一模型的囚徒:在 Antigravity 中灵活切换 Gemini 3、Claude 4.5 与 GPT-OSS

评论

使用 GitHub 账号登录后即可评论