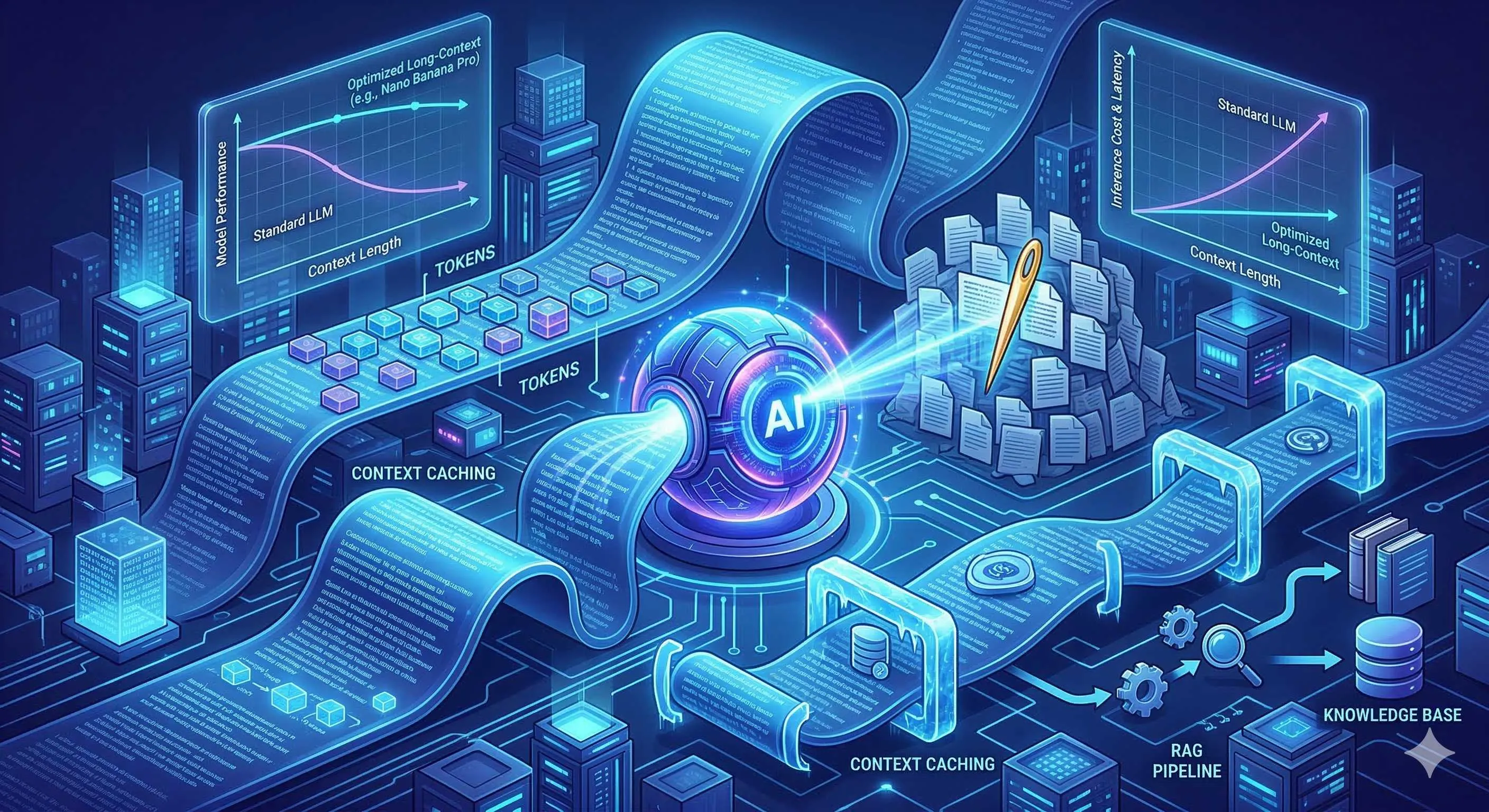

告别向量数据库?Gemini 200万Token超长上下文与Context Caching性能及成本全测评

说实话,当我第一次看到Gemini 1.5 Pro那串数字的时候,我是持怀疑态度的。

200万Token上下文窗口?这意味着什么?大概相当于能一次性塞进去一整本《三体》三部曲,再加上几部短篇小说,然后跟AI说:“你把这些都读完,我有几个问题想问。”

作为一个折腾RAG系统快两年的开发者,我的第一反应不是兴奋,而是警惕。这会不会又是一个实验室数据漂亮、实际用起来拉胯的技术?更重要的是——如果我花了几个月搭起来的向量数据库+Embedding+重排序这一套 pipeline,被Google一句”直接塞给我就行”给干掉了,那我算什么?

带着这种复杂的心情,我决定亲自动手测一测。

Gemini长上下文能力全景解析

从1.5 Pro到3.1 Pro的演进路线

先简单回顾一下Gemini的长上下文进化史。

2024年初,Gemini 1.5 Pro发布,直接把上下文窗口拉到了100万Token,震惊了整个圈子。几个月后,又升级到了200万Token。要知道,当时Claude 3还在20万Token徘徊,GPT-4 Turbo才12.8万。

说实话,这种差距让我有点恍惚。就像是大家都在用自行车比赛,突然有人开进来一辆跑车。

后来的Gemini 2.0和2.5系列继续在这个方向上深耕,而最新的Gemini 3.1 Pro虽然把窗口”缩”回了100万Token,但在推理质量和多模态理解上有了质的提升。Google的解释是:与其盲目追求数字,不如先把质量做扎实。

这个思路我其实挺认同的。毕竟,能装下一整本书但读不懂,和能精准理解核心内容但容量稍小,显然后者更实用。

200万Token到底能装多少内容?

很多人对这串数字没什么概念,我来给你换算一下:

- 约等于150万英文单词,或者300万汉字

- 大约能塞进《哈利波特》全套7本

- 差不多是10年的技术博客文章总量

- 或者一个中型Python项目的全部源码(含注释)

换句话说,绝大多数企业的内部知识库,其实都能一次性塞进去。

我拿自己的情况举例。我们公司内部的Wiki、技术文档、产品需求、会议记录加起来,也就几十万字的量级。放在以前,我得把它们切片、向量化、建索引,还得操心检索质量。现在呢?直接一股脑丢给Gemini就完事了。

这种感觉,怎么说呢,有点像是从手动挡换成了自动挡。一开始会担心失控,但开习惯了就回不去了。

多模态长上下文:不只是文本

Gemini还有一个容易被忽视的优势:它的长上下文是多模态的。

什么意思?你可以同时扔给它一小时的视频、几十页PDF、几张图表,然后问:“这段视频里的数据和PDF第15页的统计结果有什么矛盾?”

这种跨模态的关联分析,是传统RAG很难做到的。因为视频怎么切分?图表怎么向量化?这些都不是简单的问题。

我之前试过用一个包含产品演示视频、用户反馈表格和设计稿的项目做测试。Gemini不仅能准确回答关于视频内容的问题,还能指出某个设计决策和用户反馈之间的冲突点。这种全局理解能力,确实让人印象深刻。

“大海捞针”实测:Gemini的召回率真相

什么是Needle In A Haystack测试

聊到这里,你可能会问:容量大是一回事,真能记得住吗?

这也是我最关心的问题。毕竟,谁也不想花大价钱让AI读了200万字,结果它只记得最后几段。

业界有个专门的测试方法叫”Needle In A Haystack”(大海捞针)。原理很简单:在一篇超长的文本里藏一个特定的句子(比如”我最喜欢的颜色是紫色”),然后把这篇文本和其他无关内容混在一起,最后问AI那个特定句子是什么。

如果AI能准确回答,说明它在那么长的文本里真的”找到”了那根针。测试会在不同长度和不同位置重复进行,最终得到一个召回率曲线。

Gemini 1.5 Pro官方数据解读

Google官方公布的数据相当亮眼:

- 在53万Token的测试中,100%召回

- 在100万Token的测试中,99.7%召回

- 甚至在1000万Token的极限测试中,还能保持**99.2%**的准确率

坦白讲,第一次看到这组数字的时候,我是半信半疑的。官方数据嘛,你懂的,往往是在最优条件下跑出来的。

但后来我看了第三方评测机构的测试结果,发现数据基本吻合。Artificial Analysis做的独立测试显示,Gemini 1.5 Pro在各种长度的文档中都保持了极高的召回稳定性,特别是在文档中段的表现,明显优于其他模型。

这让我有点惊喜。因为之前用过的一些长上下文模型,往往有个”中间遗忘”的问题——文档开头和结尾记得牢,中间部分容易模糊。Gemini似乎很好地解决了这个问题。

真实业务场景中的召回表现

不过,实验室数据归实验室数据,真实业务场景又是另一回事。

我自己设计了一个更接近实际的测试:拿一份50万字的技术文档集,里面包含API文档、架构设计、故障排查手册等不同类型的内容。我在其中几个文档的不同位置藏了几个具体的配置参数,然后让Gemini回答相关问题。

结果怎么样?

说实话,大部分情况下它都能找到。但我也发现了一些有趣的细节:

- 对于明确的、结构化的信息(比如”API密钥的有效期是多少天”),召回率几乎是100%

- 但对于需要一点推理的问题(比如”根据文档描述,这个设计存在什么安全隐患”),准确率会下降到80%左右

- 如果问题涉及多个文档的交叉信息,Gemini有时候会漏掉其中一个来源

这说明什么?说明Gemini的长上下文能力确实很强大,但它不是万能的。特别是当问题需要复杂推理而非简单检索时,还是有优化空间的。

Context Caching深度解析

为什么需要上下文缓存

好了,现在我们知道了Gemini能装、也能记得住。但还有一个关键问题:成本。

200万Token听起来很美好,但如果每次对话都要重新传一遍这200万Token,账单可能会让你想哭。

按照Gemini 1.5 Pro的定价(2026年2月数据),超过128K的输入要$2.50/百万Token。也就是说,一次200万Token的请求,光是输入就要$5。如果一天有100次查询,那就是$500。

这个成本对于大多数应用来说是不可接受的。

这时候,Context Caching(上下文缓存)就派上用场了。

Context Caching的工作原理

简单来说,Context Caching允许你把那些重复使用的上下文预先加载并缓存起来。之后的查询只需要传入新的问题和缓存ID,而不需要重复发送那几百万Token的背景资料。

具体流程是这样的:

- 第一次请求时,你把文档传给Gemini,同时要求创建缓存

- Gemini返回一个缓存ID,并在服务器端保留这些Token的状态

- 后续查询时,你只需要传缓存ID + 新问题

- 计费时只收新问题的Token费用 + 少量缓存维持费

关键在于,缓存命中的Token只收原价的10%。也就是说,原本$5的输入成本,现在只要$0.5。

我第一次理解这个机制的时候,有种恍然大悟的感觉。原来Google早就想到了成本问题,而且还给出了相当优雅的解决方案。

Implicit vs Explicit Caching

Gemini提供了两种缓存模式:

Explicit Caching(显式缓存):你需要主动调用API创建缓存,指定哪些内容要缓存,设置TTL(生存时间)等参数。这种方式可控性最强,适合那些有明确边界的数据集,比如知识库、代码仓库。

Implicit Caching(隐式缓存):这是2025年5月之后推出的功能,系统自动检测重复的Token前缀并进行缓存,无需你做任何操作。这个功能默认开启,对于开发体验来说简直是福音。

不过要注意,Implicit Caching有一定的触发条件,通常需要相同的Prompt前缀达到一定长度才会生效。如果你每次请求的上下文差异很大,可能享受不到这个福利。

缓存命中率对成本的影响

来做个简单的数学题。

假设你的知识库是100万Token,日均查询1000次:

不用缓存的情况:

- 每日输入Token:1,000,000 × 1000 = 10亿Token

- 费用:10亿 ÷ 100万 × $2.50 = $2500/天

使用Context Caching的情况:

- 首次加载:$2.50(一次性)

- 缓存维持费:$1.00/百万Token/小时 × 1百万Token × 24小时 = $24/天

- 后续查询输入:按10%计算,即$0.25/百万Token

- 每日查询费用:1000 × 500 Token × $0.25/百万Token ≈ $0.125/天

- 总计:约$25/天

看到了吗?成本从每天2500美元降到了25美元,差了整整100倍。

这就是Context Caching的威力。说实话,算完这笔账之后,我开始认真考虑要不要把一些项目从RAG迁移过来了。

成本对决:长上下文 vs RAG

Gemini API定价全解析(2026最新)

为了做出准确的对比,我们先梳理一下Gemini的最新定价(截至2026年2月):

| 模型 | 上下文窗口 | ≤128K输入 | >128K输入 | 输出 |

|---|---|---|---|---|

| Gemini 1.5 Pro | 2M | $1.25/MTok | $2.50/MTok | $5.00/MTok |

| Gemini 1.5 Flash | 1M | $0.075/MTok | $0.15/MTok | $0.60/MTok |

| Gemini 2.5 Pro | 2M | $1.25/MTok | $2.50/MTok | $10.00/MTok |

注:MTok = Million Tokens(百万Token)

另外,Context Caching的费用结构:

- 缓存存储:$1.00/百万Token/小时

- 缓存命中:原输入价格的10%

- 缓存未命中:按正常价格计算

RAG系统的隐性成本

现在我们来算算RAG方案的成本。表面上看,RAG只需要Embedding费用和向量数据库费用,似乎很便宜。但实际上,这里面有不少隐性成本。

显性成本:

- Embedding API:以text-embedding-3-large为例,$0.13/百万Token

- 向量数据库:Pinecone标准版约$70/月,或自托管的服务器成本

- LLM生成费用:取决于你用的模型

隐性成本:

- 开发维护成本:搭建和维护RAG pipeline需要工程师时间

- 检索质量调优:Chunk大小、重叠度、重排序策略…这些都需要反复试验

- 延迟问题:检索+生成是两步操作,响应时间更长

- 召回率损失:再好的RAG也有检索不到相关内容的时候

我拿之前做过的一个项目举例。我们团队花了整整两周时间调优RAG系统,调整chunk大小、换不同的Embedding模型、尝试各种重排序策略。最后召回率从75%提到了85%,但离完美还有距离。

这两周的人力成本,换算成钱的话,可能比一年的API费用还高。

临界点的发现:什么时候该切换?

说了这么多,到底什么时候应该选择长上下文+Context Caching,什么时候继续用RAG?

我画了一张决策图,帮你快速判断:

适合长上下文的场景:

- 文档总量在200万Token以内(约3000页PDF)

- 查询频率较高(每天有数百次以上)

- 需要跨文档关联分析

- 对延迟有一定容忍度(相比RAG其实更快)

- 不想维护复杂的检索基础设施

适合RAG的场景:

- 文档总量巨大(数千万Token以上)

- 查询频率很低(每天几次到几十次)

- 需要精确的片段级引用和溯源

- 对成本控制极其敏感且文档更新频繁

- 已经有成熟的RAG基础设施

举个例子,一个客服知识库系统,文档50万字,每天查询500次,用长上下文+Context Caching每月成本大概在$50左右;而用RAG方案,加上向量数据库和开发维护成本,可能反而更贵。

但如果你是一个法律文献平台,文档总量上亿字,那RAG还是更合适的选择。

实战:Context Caching接入指南

前置条件与限制

如果你决定尝试Context Caching,先看看这些前提条件:

- 模型版本:需要使用Gemini 1.5 Pro及以上版本

- Token数量:缓存内容至少需要32,768个Token(少于这个数不划算)

- 有效期:缓存默认最长保存1小时,可以续期

- 地区限制:部分地区可能暂不支持,需要查看官方文档

Python SDK完整示例

下面是完整的接入代码,可以直接拿去用:

import google.generativeai as genai

from google.generativeai import caching

import datetime

# 配置API Key

genai.configure(api_key="YOUR_API_KEY")

# 准备要缓存的内容

# 这里假设你有一个大文档

document_content = """

[你的长文档内容,至少32768 tokens]

"""

# 创建缓存

cache = caching.CachedContent.create(

model='gemini-1.5-pro-002',

display_name='knowledge_base_cache',

system_instruction='你是专业的技术助手,基于提供的技术文档回答问题。',

contents=[document_content],

ttl=datetime.timedelta(hours=1), # 缓存1小时

)

print(f"缓存已创建,ID: {cache.name}")

print(f"Token数量: {cache.usage_metadata.total_token_count}")

# 使用缓存进行对话

model = genai.GenerativeModel.from_cached_content(cached_content=cache)

# 后续查询只需要传问题,不需要重复传文档

response = model.generate_content("文档中提到的API限流策略是什么?")

print(response.text)

# 延长缓存有效期

cache.update(ttl=datetime.timedelta(hours=2))

# 用完记得删除(也可以等自动过期)

# cache.delete()缓存生命周期管理

在实际应用中,你需要考虑缓存的生命周期管理:

创建时机:通常在应用启动时预加载常用文档,或者在用户上传文档时按需创建。

续期策略:如果缓存快要过期但仍有活跃查询,可以在后台自动续期。

清理策略:对于不再使用的缓存,及时删除以节省费用。

# 列出所有缓存

caches = caching.CachedContent.list()

for c in caches:

print(f"{c.display_name}: {c.name} (剩余{int(c.expire_time.timestamp() - datetime.datetime.now().timestamp())}秒)")

# 批量清理过期缓存

now = datetime.datetime.now()

for c in caches:

if c.expire_time < now + datetime.timedelta(minutes=5):

c.delete()

print(f"已删除缓存: {c.display_name}")常见坑点与解决方案

坑点1:缓存未命中 still 收费

有时候你以为用了缓存,结果发现账单没减。原因可能是缓存ID传错了,或者缓存已过期。建议加日志确认。

坑点2:Token计算不准

缓存的Token数必须≥32768,但你自己计算的Token数可能和Google的不一致。建议用SDK提供的usage_metadata确认。

坑点3:并发问题

多个请求同时使用同一个缓存ID是没问题的,但要注意缓存续期的原子性。

坑点4:内容更新

如果原文档更新了,缓存不会自动刷新。你需要手动删除旧缓存并创建新缓存。

架构抉择:RAG已死还是共生?

长上下文的局限性

说了这么多Gemini的好话,是时候泼点冷水了。

长上下文并不是万能药,它有明显的局限性:

成本上限:虽然Context Caching降低了单次查询成本,但如果文档量巨大(几千万Token以上),缓存维持费本身就不便宜。

更新频率:如果你的文档经常变动,缓存需要频繁重建,优势就会减弱。

精确引用:RAG可以精确告诉用户”答案来自第几页第几段”,而长上下文模式下,这种溯源比较困难。

多租户隔离:在多用户场景下,每个用户可能需要独立的上下文,这时候缓存的管理会变得复杂。

RAG不可替代的场景

承认吧,有些场景RAG仍然是更好的选择:

- 海量文档检索:当文档规模达到TB级别,只有向量数据库能高效处理

- 实时性要求高的更新:新闻、股票信息等需要分钟级更新的场景

- 混合搜索需求:需要结合关键词、标签、时间等多维度过滤的复杂查询

- 已有成熟基础设施:如果你们的RAG系统已经稳定运行,没必要为了追新而重构

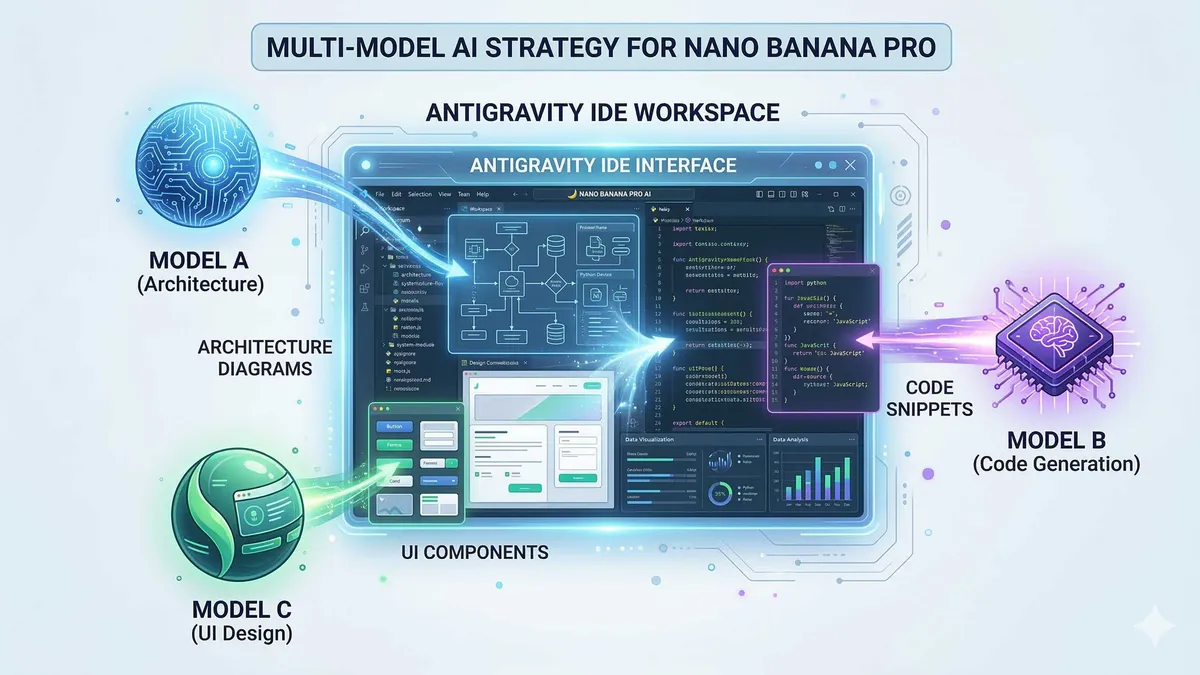

混合架构的可能性

其实,长上下文和RAG并不是非此即彼的关系。聪明的开发者已经开始探索混合架构:

第一层过滤:先用向量检索缩小范围,找出最相关的几百篇文档

第二层精读:把这批文档塞进Gemini的长上下文,做深度分析

这样既避免了海量文档的直接处理,又保留了长上下文的理解深度。

我自己最近就在尝试这种架构,效果出乎意料地好。RAG负责”粗筛”,Gemini负责”精读”,各司其职。

我的建议决策树

如果你看完这篇文章还在纠结,不妨参考这个简单的决策树:

你的文档总量是多少?

├── < 200万Token → 直接用长上下文+Context Caching

└── > 200万Token → 需要RAG吗?

├── 需要精确片段引用 → 用RAG

├── 文档更新非常频繁 → 用RAG

└── 否则 → 考虑混合架构(RAG粗筛 + 长上下文精读)未来展望与结语

长上下文技术的发展趋势

站在2026年初这个时间点回望,长上下文技术的发展速度令人咋舌。

Gemini已经把窗口推到了千万Token级别,Claude也在紧追不舍。可以预见的是,上下文窗口还会继续扩大,成本还会继续下降。

更重要的是,模型的”有效记忆”能力在不断提升。早期的长上下文模型往往是”能装但记不住”,现在的Gemini已经能做到”既装得下又记得牢”。

我估计,再过一两年,“文档太大装不下”可能会像”内存不够用”一样,成为一个逐渐远去的历史名词。

给RAG开发者的行动建议

如果你和我一样是个RAG开发者,面对这波浪潮,我有几点建议:

第一,不要恐慌。RAG不会被完全取代,它只是找到了更合适的定位。就像关系型数据库没有被NoSQL干掉一样,两者会长期共存。

第二,拥抱变化。试着把一些小项目迁移到长上下文方案,亲身体验一下差异。只有亲手做过,才能做出正确的技术判断。

第三,关注混合架构。这可能是未来一段时间的最优解——既有RAG的可扩展性,又有长上下文的理解深度。

第四,算清成本账。不要被”新技术”的光环迷惑,也不要固守”老方案”的舒适区。用数据说话,哪个便宜好用就用哪个。

说实话,写完这篇文章,我对Gemini的态度从最初的怀疑变成了审慎的乐观。它不是银弹,但确实在某些场景下比传统RAG更优雅、更经济。

技术的价值不在于新旧,而在于是否解决了实际问题。希望这篇文章能帮你在长上下文和RAG之间做出明智的选择。

如果你有任何问题或者想分享自己的实践经验,欢迎留言讨论。毕竟,在这个快速变化的领域,我们都还在学习中。

常见问题

Gemini的200万Token长上下文实际能处理多少内容?

Context Caching如何降低成本?

什么情况下应该选择RAG而非长上下文?

混合架构是如何工作的?

18 分钟阅读 · 发布于: 2026年2月27日 · 修改于: 2026年3月18日

相关文章

OpenClaw 2026.3 实战进阶:新版本核心功能与最佳实践

OpenClaw 2026.3 实战进阶:新版本核心功能与最佳实践

OpenClaw 实战完全手册:从入门到精通

OpenClaw 实战完全手册:从入门到精通

不做单一模型的囚徒:在 Antigravity 中灵活切换 Gemini 3、Claude 4.5 与 GPT-OSS

评论

使用 GitHub 账号登录后即可评论