Docker 镜像优化实战:从 1GB 到 100MB 的瘦身之旅

周一早上九点,CI/CD 流水线红灯闪烁。我盯着屏幕上已经跑了 8 分钟的构建任务,心里那个急啊。这次部署只是改了几行代码,但镜像上传就要 5 分钟——因为镜像足足有 1.2GB。

老板在群里问:“为什么还不上线?”

我截图发了过去:镜像正在上传,进度 23%。

那一刻我下定决心:这事儿不能再忍了。

后来我对这个 Node.js 应用的 Docker 镜像做了一系列优化。最后?98MB。构建时间从 8 分钟降到 2 分钟。这中间差了整整 10 倍。

这篇文章,我想把这些实战经验分享给你。不讲虚的,每一步都有数据对比,每一段代码都能直接拿来用。

为什么你的镜像这么大?

说实话,当我第一次用 docker history 查看那个 1.2GB 的镜像时,我是有点懵的。

docker history my-app:latest输出大概长这样:

IMAGE CREATED SIZE

abc123def456 2 hours ago 850MB # npm install 的产物

def456abc123 2 hours ago 180MB # 基础镜像 node:18

...850MB 就在 npm install 这一层。我愣了一下——这玩意儿怎么这么大?

镜像膨胀的四个元凶

第一个问题:基础镜像选错了。

我的 Dockerfile 第一行是这样写的:

FROM node:18node:18 这个镜像基于 Debian,自带了大量我不需要的东西:包管理器、系统工具、开发库。光基础镜像就 900MB。

来看看官方镜像的大小对比:

| 镜像 | 大小 |

|---|---|

| node:18 | ~900MB |

| node:18-slim | ~230MB |

| node:18-alpine | ~170MB |

| alpine:3.18 | ~5.5MB |

| distroless/static | ~2MB |

看到没?一个 node:18-alpine 就能省下 730MB。

第二个问题:构建工具没清理。

我在镜像里装了 gcc、make、python,因为有些 npm 包需要编译。但问题是——编译完我就不管了,这些工具还躺在镜像里吃空间。

第三个问题:层叠加效应。

每个 RUN 指令都会创建新的一层。我的 Dockerfile 里有十几个 RUN,每一层都带着前面层的所有文件。删了的东西其实还在,只是被”盖住”了。

第四个问题:缓存没优化。

我把 COPY . . 放在了最前面,这意味着——每次改一行代码,整个镜像都要重新构建。npm install 每次都重新跑,下载一堆依赖。

用 dive 工具看个明白

光靠 docker history 还不够直观。我推荐一个工具叫 dive,能把镜像的每一层”剥开”看。

安装很简单:

# macOS

brew install dive

# Linux

wget https://github.com/wagoodman/dive/releases/download/v0.12.0/dive_0.12.0_linux_amd64.deb

sudo dpkg -i dive_0.12.0_linux_amd64.deb然后用它分析你的镜像:

dive my-app:latest你会看到一个交互式界面,左边是每一层,右边是文件变化。按上下键切换层,能清楚看到每层新增、删除、修改了哪些文件。

我第一次用的时候发现:node_modules 竟然出现了两次——一次在 /app/node_modules,一次在构建阶段的临时目录里。这得多占多少空间?

5 步优化框架

好了,问题找完了。接下来是解决方案。

我把这些方法整理成了一个 5 步框架,每一步都有具体的效果数据。

第 1 步:选择轻量级基础镜像

这是最简单的一步,改一行代码就能见效。

# 改之前

FROM node:18

# 改之后

FROM node:18-alpine效果?900MB → 170MB。省了 730MB,就换了个基础镜像。

三种轻量镜像怎么选?

| 镜像类型 | 适用场景 | 优缺点 |

|---|---|---|

| Alpine | 通用选择 | 小、包管理丰富,但用 musl 可能遇到兼容问题 |

| Distroless | 安全性优先 | 极小、无 shell,但调试困难 |

| Scratch | 静态编译语言(Go、Rust) | 最小(0MB),需要静态编译 |

大多数情况下,Alpine 是个不错的选择。如果你用的是 Node.js 官方的 -alpine 镜像,glibc 兼容性问题基本已经解决了。

第 2 步:使用多阶段构建

这步是降维打击。原理很简单:构建环境和运行环境分开,最终镜像只保留运行需要的东西。

# 构建阶段

FROM node:18 AS builder

WORKDIR /app

COPY package*.json ./

RUN npm install

COPY . .

RUN npm run build

# 运行阶段

FROM node:18-alpine

WORKDIR /app

COPY --from=builder /app/dist ./dist

COPY --from=builder /app/node_modules ./node_modules

CMD ["node", "dist/main.js"]关键在 COPY --from=builder 这行,它只从 builder 阶段”偷”你需要的文件。

我那个 1.2GB 的镜像,加了多阶段构建后直接变成了 200MB。构建阶段的 850MB node_modules 和各种工具,全部被丢弃了。

第 3 步:优化层缓存

Docker 的层缓存机制是这样的:如果某层没变,就用缓存。

问题是,我的 Dockerfile 顺序写反了:

# 错误示范

COPY . . # 先复制所有文件

RUN npm install # 再安装依赖这样写的话,改一行代码 → COPY . . 变化 → 缓存失效 → npm install 重新跑。

正确姿势:

# 正确示范

COPY package*.json ./ # 先只复制依赖描述文件

RUN npm install # 安装依赖(依赖不变就复用缓存)

COPY . . # 最后复制源码(源码常变,放最后)改动后,只要 package.json 不变,npm install 就会直接用缓存。构建时间从 3 分钟降到 30 秒。

还有一个技巧:合并 RUN 指令。

# 改之前(4 层)

RUN apt-get update

RUN apt-get install -y curl

RUN apt-get clean

RUN rm -rf /var/lib/apt/lists/*

# 改之后(1 层)

RUN apt-get update && \

apt-get install -y --no-install-recommends curl && \

apt-get clean && \

rm -rf /var/lib/apt/lists/*为什么?因为每个 RUN 是一层。你”删”的文件其实还在前面层里。合并成一条指令,中间文件就不会进入镜像。

第 4 步:配置 .dockerignore

这步很多人会漏掉。docker build 的时候,Docker 会把整个目录打包发给 daemon。如果你有 500MB 的 node_modules 在本地,它会被全部打包进去。

在项目根目录创建 .dockerignore:

.git

node_modules

*.log

.env

docker-compose.yml

README.md

.vscode

tests

coverage效果?构建上下文从 500MB 降到 50MB。docker build 命令执行快了一大截。

第 5 步:清理不必要文件

如果你必须用 apt 装包,记得清理:

RUN apt-get update && \

apt-get install -y --no-install-recommends \

curl \

ca-certificates && \

apt-get clean && \

rm -rf /var/lib/apt/lists/* /tmp/* /var/tmp/*几个要点:

--no-install-recommends不装”推荐”包,能省不少空间apt-get clean清理 apt 缓存rm -rf /var/lib/apt/lists/*删除包列表

这步做完,又能省下 50-100MB。

实战案例:3 种语言镜像优化全流程

光说不练假把式。我准备了三个语言的完整 Dockerfile,都是可以直接复制运行的。

Node.js 应用

初始状态:node:18 基础镜像,900MB

# 优化后的完整 Dockerfile

FROM node:18-alpine AS builder

WORKDIR /app

COPY package*.json ./

RUN npm ci --only=production

COPY . .

RUN npm run build

FROM node:18-alpine

WORKDIR /app

COPY --from=builder /app/dist ./dist

COPY --from=builder /app/node_modules ./node_modules

USER node

CMD ["node", "dist/main.js"]优化路径:

- 切换到 alpine:900MB → 170MB

- 多阶段构建:170MB → 120MB

- 只装生产依赖(

npm ci --only=production):120MB → 98MB

Go 应用

Go 是静态编译语言,天生适合 Docker 优化。

# 构建阶段

FROM golang:1.22-alpine AS builder

WORKDIR /app

COPY go.* ./

RUN go mod download

COPY . .

RUN CGO_ENABLED=0 GOOS=linux go build -a -installsuffix cgo -o main .

# 运行阶段(使用 scratch 空镜像)

FROM scratch

COPY --from=builder /app/main /main

ENTRYPOINT ["/main"]效果:800MB → 10MB 以下。

你没看错。scratch 是个空镜像,里面只有你编译的二进制文件。Go 静态编译后不依赖任何动态库,直接跑。

Python 应用

Python 稍微复杂点,因为 Alpine 用的是 musl 而不是 glibc,有些包会出问题。

FROM python:3.11-alpine AS builder

WORKDIR /app

COPY requirements.txt .

RUN pip install --user -r requirements.txt

COPY . .

FROM python:3.11-alpine

WORKDIR /app

COPY --from=builder /root/.local /root/.local

COPY --from=builder /app .

ENV PATH=/root/.local/bin:$PATH

CMD ["python", "main.py"]注意事项:

- 如果遇到

pip install报错,可能需要装musl-dev和gcc - 某些科学计算包(numpy、pandas)在 Alpine 上可能有性能问题

- 稳妥起见可以用

python:3.11-slim(基于 Debian)

常见坑点与解决方案

优化路上,我也踩过不少坑。提前告诉你,免得你也掉进去。

坑点 1:Alpine 的 musl 兼容性问题

现象:某个 npm 包安装失败,报错找不到 glibc。

原因:Alpine 用 musl libc,不是标准的 glibc。有些包依赖 glibc。

解决方案:

- 对于 Node.js:用官方

node:18-alpine镜像,大部分问题已处理 - 对于 Python:装不上就用

debian:slim - 如果必须用 Alpine:试试

apk add gcompat兼容层

坑点 2:Scratch 镜像没法调试

现象:docker exec -it container sh 报错,因为 scratch 里没有 shell。

解决方案:

- 生产用 scratch,调试阶段用 alpine

- 或者单独打一个调试镜像:

FROM alpine COPY --from=production /app /app CMD ["sh"]

坑点 3:CI/CD 缓存丢失

现象:本地构建很快,CI 上每次都从零开始。

原因:CI 环境不保留 Docker 缓存。

解决方案:用 BuildKit 的缓存挂载:

# syntax=docker/dockerfile:1

FROM node:18-alpine

WORKDIR /app

COPY package*.json ./

RUN --mount=type=cache,target=/root/.npm \

npm install这样 npm 缓存会持久化,CI 上也能复用。

坑点 4:.dockerignore 排除过度

现象:构建报错,提示找不到某个文件。

原因:.dockerignore 把需要的文件也排除了。

解决方案:

- 渐进式排除,先排除明显的(node_modules、.git)

- 用

docker build --no-cache验证干净构建 - 需要例外用

!:tests !tests/fixtures

优化效果验证与持续改进

优化做完了,怎么验证效果?

验证方法

1. 查看镜像大小

docker images my-app2. 查看层详情

docker history my-app:latest --no-trunc3. 可视化分析

dive my-app:latest性能权衡

镜像小了,运行时会不会有问题?

Alpine 的 musl vs glibc:

- musl 更轻量,但某些场景下性能略差

- 如果你的应用大量使用系统调用,建议压测对比

Scratch 的安全性:

- 最小攻击面,最安全

- 但出问题没法进容器排查

我的建议:从安全角度,能用 scratch 就用 scratch。调试阶段切 alpine。CI 里两个镜像都打,带 -debug 后缀的是调试版。

持续改进建议

- 定期更新基础镜像:每月检查一次,安全漏洞修了不少

- 监控镜像大小:在 CI 里加个检查,超过 100MB 就告警

- 使用 hadolint:Dockerfile 静态检查工具,提前发现问题

docker run --rm -i hadolint/hadolint < Dockerfile

推荐工具

| 工具 | 用途 | 安装 |

|---|---|---|

| dive | 镜像分析 | brew install dive |

| hadolint | Dockerfile 检查 | brew install hadolint |

| docker-slim | 自动瘦身 | brew install docker-slim |

docker-slim 挺有意思的,它会分析你的镜像运行时实际用了哪些文件,然后把没用到的都删掉。不过建议在测试环境先跑一遍,别把生产环境搞崩了。

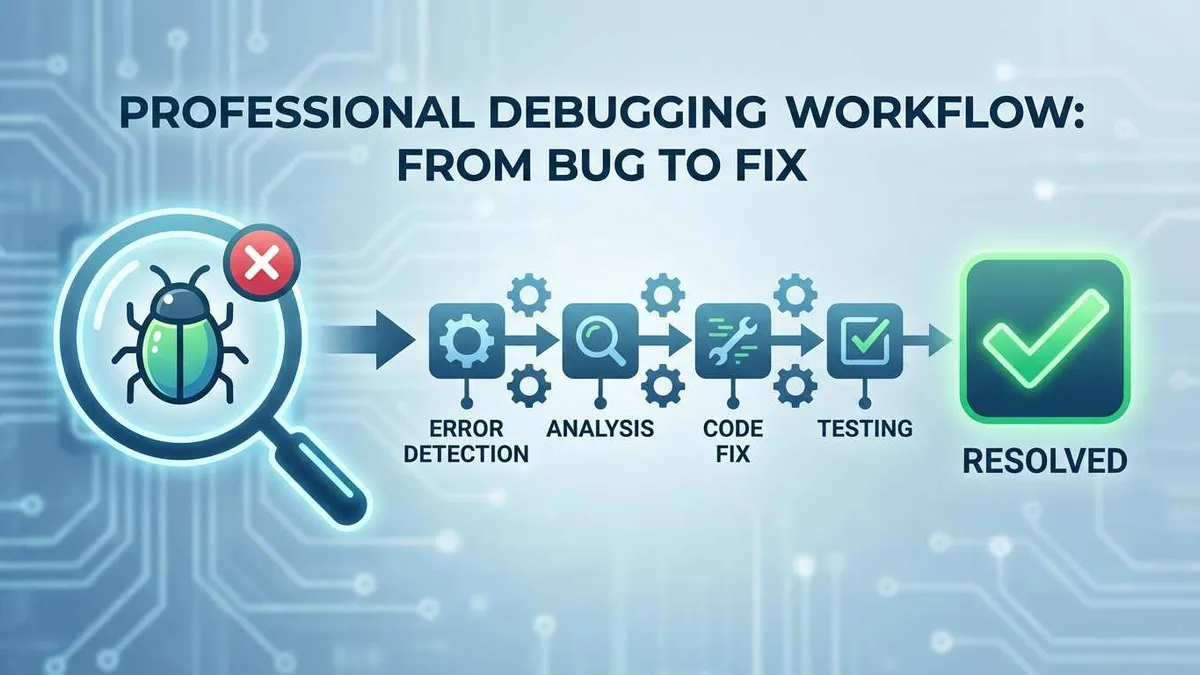

Docker 镜像优化 5 步法

从分析到验证的完整优化流程,帮助开发者将 Docker 镜像从 1GB 优化到 100MB

⏱️ 预计耗时: 30 分钟

- 1

步骤1: 选择轻量级基础镜像

将基础镜像从完整版切换到精简版:

• node:18 → node:18-alpine(900MB → 170MB)

• golang:1.22 → golang:1.22-alpine

• python:3.11 → python:3.11-alpine

注意:Alpine 使用 musl libc,某些依赖 glibc 的包可能需要额外处理 - 2

步骤2: 使用多阶段构建

将构建环境和运行环境分离:

• 构建阶段:安装编译工具、构建依赖

• 运行阶段:只复制构建产物和运行时依赖

• 使用 FROM ... AS builder 定义构建阶段

• 使用 COPY --from=builder 复制构建产物 - 3

步骤3: 优化层缓存顺序

调整 Dockerfile 指令顺序最大化缓存复用:

• 先复制依赖描述文件(package.json、requirements.txt)

• 然后安装依赖(npm install、pip install)

• 最后复制源码(COPY . .)

合并多个 RUN 指令,避免中间文件残留 - 4

步骤4: 配置 .dockerignore

在项目根目录创建 .dockerignore 文件排除不需要的文件:

• .git、node_modules、*.log

• .env、.vscode、tests

• docker-compose.yml、README.md

这样可以大幅减小构建上下文,提升构建速度 - 5

步骤5: 清理不必要文件

在 RUN 指令中清理缓存和临时文件:

• 使用 --no-install-recommends 避免安装推荐包

• 使用 apt-get clean 清理包缓存

• 使用 rm -rf /var/lib/apt/lists/* 删除包列表

• 清理 /tmp/* 和 /var/tmp/*

总结

说了这么多,核心就 5 步:

- 选对基础镜像:能用 alpine 就用,静态编译用 scratch

- 多阶段构建:构建和运行分开,只留需要的

- 优化层缓存:依赖描述文件放前面,源码放后面

- 配置 .dockerignore:排除不需要的文件

- 清理残余文件:apt 缓存、临时文件都删掉

现在就去检查你的 Docker 镜像。用 docker history 看看哪一层最占空间,然后按本文的方法试一试。

评论区见,告诉我你的优化成果:从多少 MB 减到了多少 MB?

常见问题

Alpine 和 Debian 基础镜像有什么区别?

多阶段构建会影响构建速度吗?

Scratch 镜像适合什么场景?

如何解决 Alpine 的 glibc 兼容性问题?

CI/CD 环境中如何保留 Docker 缓存?

10 分钟阅读 · 发布于: 2026年3月20日 · 修改于: 2026年3月20日

评论

使用 GitHub 账号登录后即可评论