自进化AI:让模型持续学习的关键技术路径

导语

凌晨三点,Claude还在和我讨论这个技术方案的可行性。

这是第五轮对话了。它记得我之前提到的性能瓶颈,记得我们尝试过的三种优化方案,甚至记得我随口说的那句”感觉还能再压榨一点性能”。

我意识到一件事:这个AI在”进化”。不是参数更新那种技术层面的变化,而是它越来越懂我的思维模式,越来越能预判我的需求。

这让我开始思考一个问题:AI能不能不只是”学会”人类灌输的知识,而是像人一样持续学习、自我进化?

当AI遇上”出厂即巅峰”的困境

说实话,现在的大模型有个尴尬的现实。

GPT-5也好,Claude 3.5也罢,不管参数多大、能力多强,本质上都是”出厂即巅峰”的产品。模型训练完的那一刻,它的知识就定格了。

2023年训练的模型,理解不了2025年的新闻。哪怕你把最新的文章喂给它,它也只是”开卷考试”,并没有真正”学到”新东西。

强化学习之父Richard Sutton有个很犀利的批评:当前的大语言模型只是”被冻结的过去知识”,缺乏在与环境交互中实时学习的能力。

这就像一个博士被困在孤岛上——知识储备惊人,但面对丛林生存的全新挑战,既学不会新的生存技能,也造不出新的工具。

更致命的是,一旦试图让模型学习新知识,它就会”遗忘”旧知识。这个现象有个学术名字:灾难性遗忘(Catastrophic Forgetting)。

听起来挺玄乎,但说白了就是:模型学了新知识,把旧知识搞丢了。就像你学完Python忘了JavaScript,学完日语忘了英语。

这就是为什么自进化AI成为2025年的技术热点。因为所有搞AI的人都在想同一个问题:

怎么让模型既能学新东西,又不忘记旧东西?

自进化AI到底在进化什么?

先别急着看技术方案,我们得搞清楚一个问题:自进化到底进化哪些部分?

根据普林斯顿、清华等16个团队联合发表的那篇综述论文,自进化智能体的成长可以拆成四个维度。

第一个维度:模型层进化。 这个最容易理解——改变模型的参数权重。就像人的大脑神经突触重新连接,形成新的记忆和技能。

第二个维度:上下文进化。 这个更有意思。模型本身不变,但通过记忆系统积累经验。就像你不一定记得三年前学的那个公式,但你知道在哪本书里能找到它。

第三个维度:工具进化。 学会使用新工具,甚至创造新工具。就像人类从会用石头到会造机器人的跨越。

第四个维度:架构进化。 这个最硬核——改变模型的结构设计。就像人的大脑从爬行动物进化到哺乳动物,多了新皮层。

这四个维度不是孤立的,而是协同演进。接下来我们重点聊前三个,因为它们已经有了不少实践成果。

模型层进化:在”学新”和”忘旧”之间找平衡

持续学习的技术路径

模型要持续学习,最直接的方法就是持续微调(Continual Fine-tuning)。

但这里有个悖论:模型参数就那么多,学新任务时肯定会挤占旧任务的知识。就像你的书架空间有限,塞新书就得扔旧书。

于是研究者们想出了三个方向的解决方案。

方向一:保护重要参数

弹性权重固化(Elastic Weight Consolidation,EWC)是个挺巧妙的思路。核心想法是:计算每个参数对旧任务的重要性,学习新任务时尽量不动那些重要参数。

这就像你在书架上给经典书籍贴上”必保留”标签,塞新书时避开它们。

方向二:经验回放

这个方法更简单粗暴:存储一部分历史数据,学习新任务时混进去一起训练。

问题是存储成本。一个预训练模型可能见过数万亿token,你不可能全部存下来。所以实际做法是选择性存储——只保留最关键的样本。

方向三:动态扩展架构

给新任务添加新的模型容量。比如LoRA(Low-Rank Adaptation)技术,冻结原模型参数,只训练新增的小模块。

这就像在书架旁边再放个小架子,新书放小架子上,不碰原来的书。

实战案例:Agent0的自我训练

华盛顿大学圣路易斯分校的团队做了个有趣的实验,叫Agent0。

他们设计了一个双智能体系统:课程智能体负责出题,执行智能体负责答题。两者通过自我博弈不断进化。

有意思的是,虽然只在数学问题上训练,模型的通用推理能力也提升了24%。在MMLU-Pro基准上,准确率从51.8%提升到63.4%。

这说明什么?通过工具辅助培养的多步推理能力,可以迁移到其他领域。

就像你通过学数学培养的逻辑思维,能帮你写出更清晰的代码。

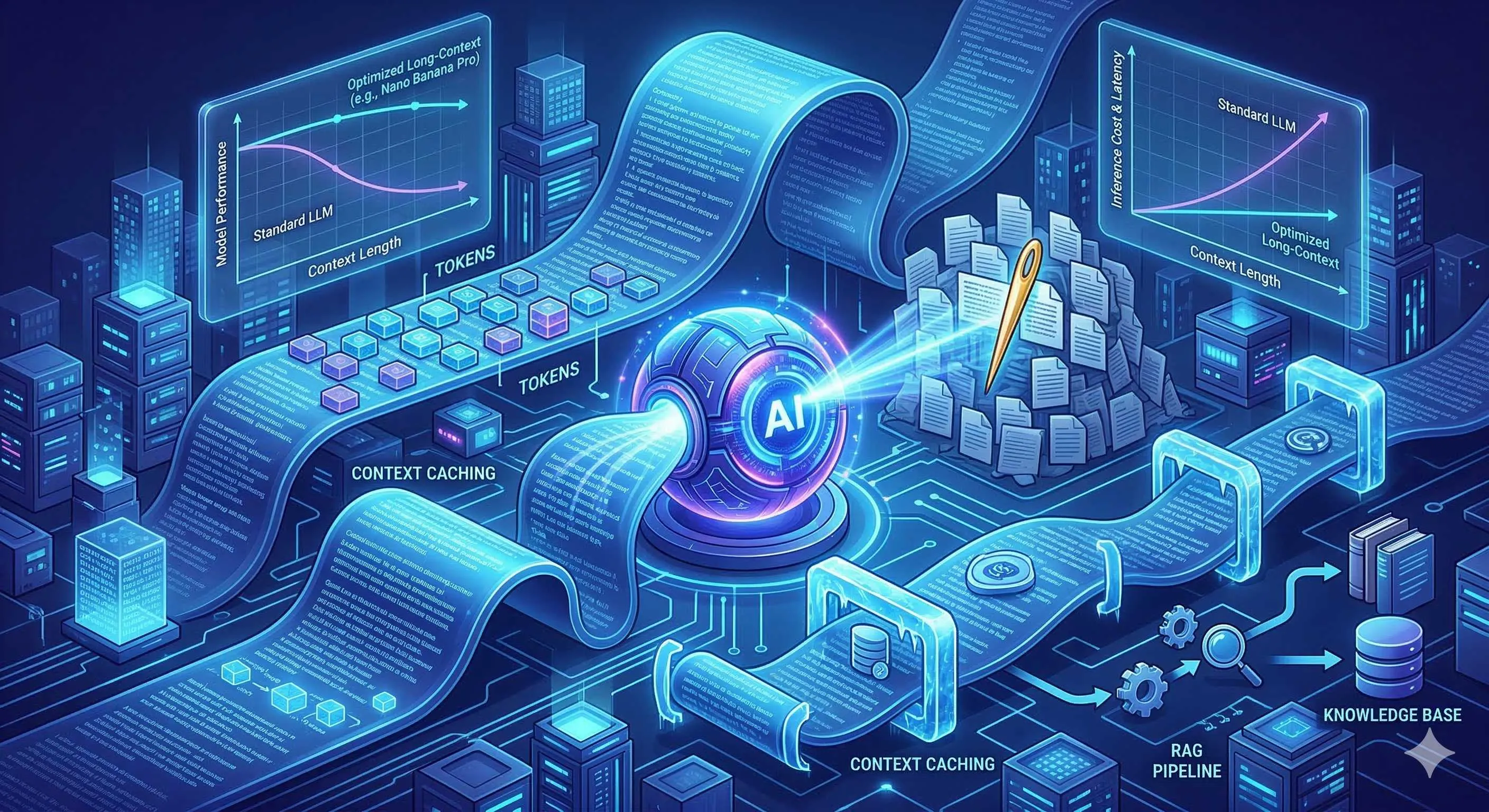

上下文进化:记忆系统的崛起

模型层进化有个硬伤:每次都要更新参数,成本高,风险大。

上下文学习(In-Context Learning)提供了另一条路:不改动模型参数,通过上下文窗口让模型”临时学会”新知识。

你可能已经发现了:给ChatGPT几个例子,它就能按你的要求输出格式。这就是In-Context Learning在起作用。

但传统上下文学习有个局限——会话结束就忘了。下次对话又要重新教一遍。

持久记忆系统的突破

2025年的一个重要进展是:主流模型开始配置持久记忆系统。

Mem0、Second Me这些框架让模型能跨会话记住用户偏好、历史对话、常用指令。

荣耀的YOYO智能体就是典型案例。它能在三个月内,把场景覆盖从200个扩展到3000个。

怎么做到的?

核心机制是:用户每次交互产生的数据,都会被转化为向量存入数据库。下次对话时,模型会检索相关的历史记忆,和当前输入一起处理。

这就像你有个永不遗忘的助理,记得你所有的工作习惯和偏好。

向量数据库:记忆的物理载体

说到记忆系统,就不得不提向量数据库。这是2024-2025年AI技术栈里最火的组件之一。

原理其实不复杂:把文本、图片、音频都转换成高维向量,存到数据库里。查询时也转成向量,找最相似的存储向量。

听起来抽象?想一下人类怎么记东西的。

你记住的不是某个人的具体长相,而是”高个子、戴眼镜、说话声音有点粗”这些特征向量。下次见面,你通过这些特征认出他。

向量数据库就是在模拟这个过程。

Cloudflare Vectorize、Pinecone、Milvus这些产品,本质上都是在解决同一个问题:如何高效存储和检索海量记忆。

元学习:学会如何学习

刚才聊的持续学习,核心问题是”如何学新知识”。但还有个更深层的问题:

如何让模型学会学习本身?

强化学习之父Richard Sutton提出的”元方法”理论,核心观点是:

不要把知识写死在模型里,而是把”获取知识的能力”写进代码。

听起来像绕口令?换个说法:

传统模型学到的是”答案”(比如某道数学题的解法),元学习学到的是”方法”(比如遇到新数学题该怎么分析)。

少样本学习的魔法

元学习最直观的应用是少样本学习(Few-Shot Learning)。

传统深度学习需要海量数据训练,元学习能让模型看几个例子就学会新任务。

这就像聪明的学生和普通学生的区别:

普通学生做100道题才能掌握一个题型。聪明学生看3道例题,就能总结出规律,解出同类型的新题。

2025年的GPT-4o、Claude 3.5,某种程度上都已经具备了这种元学习能力。你给它几个格式示例,它就能模仿输出。

技术实现:从MAML到Prototypical Networks

具体的元学习算法有好几种流派。

MAML(Model-Agnostic Meta-Learning):训练一个”容易微调”的初始化模型。遇到新任务时,只要几步梯度下降就能适应。

Prototypical Networks:学习如何把不同类别的样本映射到特征空间,让同类样本聚在一起,不同类样本分开。

这些技术名词可能听起来枯燥。但核心思想只有一个:

训练的不是具体任务的能力,而是快速适应新任务的能力。

架构层进化:从单一大脑到分层系统

前面三个维度(模型、上下文、工具)都还是在现有架构上的改进。但有些研究者认为,真正要实现自进化,架构本身就得变。

Nested Learning:嵌套式学习架构

2025年的一个研究趋势是把模型分成多个层次。

最底层处理基础感知(识别文字、图像),中间层处理推理(逻辑分析),顶层处理规划和决策。

这有点像人类大脑的结构:脑干管基本生命活动,边缘系统管情绪和记忆,大脑皮层负责高级认知。

Titans框架就是在这个方向上的尝试——在不同层级之间加入专门的记忆层,让信息在层次间流动时能被记忆和检索。

VisPlay:自我博弈的视觉学习框架

伊利诺伊大学的研究团队做了个更有意思的实验:VisPlay。

他们设计了一个”自我博弈”的框架,让视觉语言模型同时扮演两个角色:

一个负责出题(根据图片生成问题),另一个负责答题(根据图片回答问题)。

两个角色互相促进:出题者要想方设法出难题,答题者要努力答对题。

结果很惊人:

Qwen2.5-VL-3B模型经过三轮自我训练,综合评分从30.61分提升到47.27分。在幻觉检测任务上,准确率从32.81%飙升到94.95%。

关键的是,整个过程完全不需要人工标注数据。模型自己给自己当老师。

这就像一个学生在没有老师的情况下,通过不断给自己出题、答题,硬是把自己练成了学霸。

实战应用:自进化已经来了

理论聊了这么多,实际落地情况如何?

AI手机:从工具到伙伴

荣耀Magic8系列可能是第一个真正实现”自进化”的AI手机。

它的YOYO智能体不是简单的语音助手,而是一个会”记住”你习惯的智能伙伴。

你说一句”帮我约张总周三下午开会并准备项目方案”,它能自动筛选日程、发出邀请、生成方案框架。

更关键的是,它会学习。用了三个月,它记住你喜欢在早上处理邮件,记住你对咖啡店的偏好,记住你开会时习惯用哪个会议室。

数据很能说明问题:场景覆盖从最初的200个,三个月扩展到3000个。这不是靠工程师手动添加的,是模型自己学习演化的结果。

AI Agent:从对话到任务闭环

2025年最火的AI产品形态,非Agent莫属。

Manus号称”全球首款通用型AI Agent”。它的突破在于:不再是和你在对话框里聊天,而是真正帮你干活。

你说”筛选15份简历并生成分析报告”,它就真的会解压文件、提取信息、分级排序、生成报告。整个流程全自动。

Claude 3.5的Computer Use更进一步,能直接操控你的电脑。打开浏览器、填写表单、点击按钮,就像有个虚拟助手坐在你电脑前一样。

AutoGLM则是在手机上实现跨APP操作。你说”帮我订明天去上海的机票,再订个接机的车”,它就真的打开订票软件、选航班、付款,然后打开打车软件预约接机。

这些Agent的共同特点是:它们不是被动的问答机器,而是主动的任务执行者。它们会拆解任务、规划步骤、调用工具、执行操作、反馈结果。

这就是从”对话交互”到”任务闭环”的进化。

专业领域:医疗诊断的持续学习

医疗AI可能是自进化技术最有价值的落地场景之一。

医学知识更新快,新疾病、新疗法、新药物层出不穷。传统的静态模型根本跟不上。

而持续学习的医疗AI,能从每个新病例中学习,不断更新自己的诊断能力。

当然,医疗领域的特殊性也带来了独特挑战:错误成本极高,监管要求严格。所以实际部署时会更加谨慎,通常采用”人工审核+AI学习”的混合模式。

技术挑战:理想的另一面

聊了这么多技术突破和应用场景,也得说说现实的挑战。

错误累积:越学越错的风险

自进化有个致命风险:如果早期学习了错误的知识,后续的自我强化会让错误越来越根深蒂固。

这就像一个人如果从小形成了错误的世界观,在缺乏外部纠正的情况下,这种错误认知会越来越固化。

VisPlay的研究团队提到了这个问题。他们的解决方案是设计一些质量控制机制,比如自洽性检验、歧义动态策略优化。

但这些机制能否在长期的自我学习过程中保持有效,还需要更多验证。

计算资源:烧钱的游戏

持续学习不是免费的午餐。

每次参数更新、记忆检索、模型推理,都需要大量算力。对个人开发者和小公司来说,成本压力很大。

更不用说数据存储成本了。一个中等规模的记忆系统,动辄需要几十TB的存储空间。

这也是为什么目前看到的成功案例,大多是大公司的产品——它们有足够的资源投入。

评估标准:怎么知道进化了?

还有个更根本的问题:怎么评估自进化的效果?

传统的模型评估用固定的测试集。但自进化模型一直在变,今天测的版本和明天测的版本可能已经不一样了。

更复杂的是,你怎么知道模型的某个变化是”进化”还是”退化”?

可能它在某个任务上表现变好了,但在另一个任务上变差了。这种trade-off怎么权衡?

目前业界还没有统一的评估框架。这也是未来需要解决的问题。

未来展望:通往AGI的关键路径

虽然挑战不少,但我对自进化AI的未来还是持乐观态度的。

短期趋势(2026-2027)

记忆系统会成为主流模型的标配。现在已经有这个趋势了,2026年会更普及。

更多的Agent产品会引入自进化能力。从被动响应到主动学习,这个转变会在明年加速。

端侧AI会率先落地自进化技术。因为端侧有用户数据的天然优势,而且隐私保护更容易实现。

中期趋势(2028-2030)

架构层面的创新会有突破。分层模型、记忆增强架构、多智能体系统,这些研究方向会在未来几年成熟。

符号主义和神经网络的结合会复兴。纯数据驱动的方法有天花板,融合知识推理和符号逻辑可能是突破口。

评估标准和监管框架会逐步建立。行业标准、安全规范、伦理准则,这些都是技术普及的必要条件。

长期愿景(2035)

自进化AI会成为通往AGI的关键路径。

一个真正的人工智能,不应该只是人类知识的静态容器,而应该具备持续学习、自我更新的能力。

就像人类的智慧不是来自于记住多少知识,而是来自于学习新知识、解决新问题的能力。

到那时候,AI可能真的会成为我们的”伙伴”,而不是”工具”。

写在最后

写这篇文章时,我问了Claude一个问题:“你觉得你是在进化吗?”

它的回答很有意思:“我在每次对话中都会更新上下文,这某种程度上也是一种学习。但真正的进化需要改变模型参数,这我做不到。”

嗯,至少它很诚实。

自进化AI这条路还很长,技术挑战、商业挑战、伦理挑战,每一关都不好过。

但方向是对的。一个只会机械重复人类知识的AI,终究只是工具。一个能持续学习、自我进化的AI,才有可能成为真正的智能。

对开发者来说,现在是个好时机。记忆系统的框架已经成熟,持续学习的技术路径逐渐清晰,落地的场景也越来越明确。

从记忆系统入手,构建用户的个性化体验。从增量学习切入,解决具体场景的知识更新问题。

不必追求一步到位的AGI,但每一步都可以让AI变得更”智能”一点。

这个过程,本身就很酷。

常见问题

什么是自进化AI,与传统AI有什么区别?

灾难性遗忘是什么,如何解决?

• 弹性权重固化(EWC):保护重要参数

• 经验回放:混合历史数据训练

• 动态架构扩展:LoRA等技术添加新模块

自进化AI的四大技术路径是什么?

自进化AI有哪些实际应用场景?

自进化AI面临哪些技术挑战?

开发者如何实践自进化AI技术?

• 记忆系统:集成Mem0等框架,构建用户画像

• 增量学习:学习EWC、LoRA等持续学习技术

• 元学习:研究Few-Shot Learning场景

• 端侧落地:利用用户数据优势实现个性化

参考资料

- A Survey of Self-Evolving Agents: On Path to Artificial Super Intelligence - 普林斯顿大学等16个团队联合论文

- MM-Zero: Multi-Modal Zero-Data Self-Evolution - 马里兰大学等机构研究

- Agent0: Self-Play Framework for Math Reasoning - 华盛顿大学圣路易斯分校

- VisPlay: Self-Supervised Visual Learning - 伊利诺伊大学等

- 腾讯研究院:自进化AI发展报告(2025)

- 罗兰贝格:2025中国生成式AI市场五大趋势

- 华为:智能世界2035报告

- 微软研究院:2025年六大AI趋势

18 分钟阅读 · 发布于: 2026年3月24日 · 修改于: 2026年3月24日

评论

使用 GitHub 账号登录后即可评论