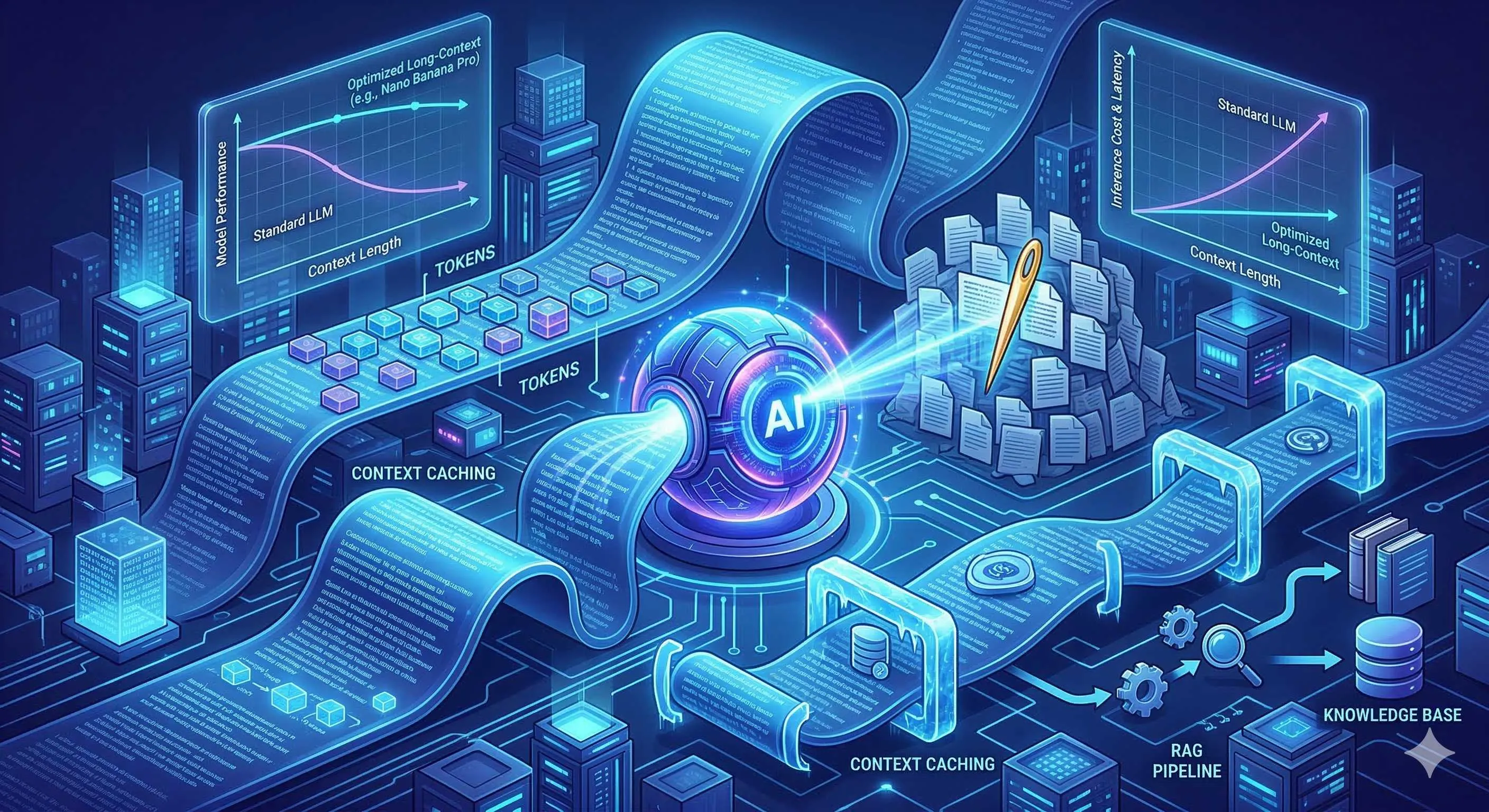

ベクトルデータベースはもう不要? Gemini 200万トークン超長文コンテキストと Context Caching の性能・コスト完全検証

正直なところ、Gemini 1.5 Pro のあの数字を初めて見たとき、私は懐疑的でした。

200万トークンのコンテキストウィンドウ? それが何を意味するか分かりますか? 例えば、『三体』三部作を一気に流し込み、さらに短編小説をいくつか加えた後で AI に「全部読んだよね、いくつか質問があるんだ」と言うようなものです。

RAG(検索拡張生成)システムと2年近く格闘してきた開発者として、私の第一反応は興奮ではなく警戒でした。「これはまたラボのデータだけが綺麗で、実際には使い物にならない技術ではないか?」、そしてさらに重要なのは、「もし数ヶ月かけて構築したベクトルデータベース + Embedding + リランキングという一連のパイプラインが、Google の『全部そのまま送るだけでいい』という一言で無に帰すとしたら、私の努力は何だったのか?」ということです。

そんな複雑な心境を抱えつつ、私は自ら検証してみることにしました。

Gemini 長文コンテキスト能力の全景解析

1.5 Pro から 3.1 Pro への進化の系譜

Gemini の長文コンテキストの進化を簡単に振り返ってみましょう。

2024年初頭、Gemini 1.5 Pro が発表され、コンテキストウィンドウを一気に100万トークンまで広げたことで業界に衝撃を与えました。その数ヶ月後には200万トークンへとアップグレード。当時、Claude 3 が20万トークン前後で、GPT-4 Turbo が12.8万トークンだったことを考えると、その差は歴然でした。

正直なところ、この差には呆気に取られました。まるで自転車レースをしていたところに、突然スポーツカーが乱入してきたような感覚です。

その後の Gemini 2.0 および 2.5 シリーズはこの方向性をさらに突き詰め、最新の Gemini 3.1 Pro ではウィンドウサイズをあえて100万トークンへと「縮小」させつつも、推論の質とマルチモーダルな理解力を質的に向上させました。Google の説明によれば、「単なる数字の追求よりも、まずは質を盤石にすること」を優先したとのことです。

この考え方には私も賛成です。何冊分もの本を読み込めても中身を理解できていないよりは、核心を正確に捉えつつ容量も十分にある方が、明らかに実用的だからです。

200万トークンにはどれくらいの内容が入るのか?

この数字の意味がピンとこない方のために、換算してみましょう。

- 英語で約150万語、日本語であれば約300万〜400万文字程度

- 『ハリー・ポッター』全7巻が収まる

- 技術ブログ記事の約10年分に相当

- あるいは、中規模な Python プロジェクトの全ソースコード(コメント含む)

言い換えれば、ほとんどの企業の内部ナレッジベースは、これ一つに丸ごと収まることになります。

私の例を挙げると、自社の Wiki、技術ドキュメント、製品要件、会議録をすべて合わせても数十万文字程度です。以前なら、それらを小さく切り分け(チャンク化)、ベクトル化し、インデックスを貼り、検索精度に頭を悩ませていました。しかし今はどうでしょう。すべてを Gemini に放り込むだけで済むのです。

この感覚は、マニュアル車からオートマ車に乗り換えたようなものです。最初はコントロールを失うのではないかと不安になりますが、一度慣れてしまうともう元には戻れません。

マルチモーダル長文コンテキスト:テキストだけではない

Gemini には、見落とされがちなもう一つの強みがあります。長文コンテキストがマルチモーダルであるという点です。

つまり、1時間の動画、数十ページの PDF、数枚の図表を一度に渡し、「この動画の内容と PDF 15ページの統計結果に矛盾はあるか?」と問いかけることができます。

このようなモーダルを跨いだ関連性分析は、従来の RAG では実現が困難でした。動画をどう切り分けるか? 図表をどうベクトル化するか? これらは一筋縄ではいかない問題だからです。

以前、製品のデモ動画、ユーザーのフィードバック・シート、デザイン案を含むプロジェクトでテストを行いました。Gemini は動画の内容に関する質問に正確に答えただけでなく、あるデザイン上の決定がユーザーのフィードバックと衝突している点まで指摘しました。この俯瞰的な理解力には、深く感銘を受けました。

「大海撈針」実測:Gemini の再現率(Recall)の真実

Needle In A Haystack テストとは

「容量が大きいのは分かったが、本当に記憶できているのか?」という疑問が出るでしょう。

これは私が最も懸念していた点です。AI に200万文字を読ませるために高額な費用を払った結果、最後の方の数段落しか覚えていない、などという事態は避けたいからです。

業界には「Needle In A Haystack(大海の中の針)」と呼ばれるテスト方法があります。原理はシンプルです。超長文のテキストの中に特定の文章(例:「私の好きな色は紫です」)を一箇所だけ隠し、無関係な内容と混ぜ合わせます。そして AI にその特定の文章の内容を問います。

AI が正確に回答できれば、膨大なテキストの中からその「針」を見つけ出したことを意味します。このテストを異なる長さや位置で繰り返し行い、再現率(Recall)の曲線を算出します。

Gemini 1.5 Pro 公式データの読み解き

Google が公表しているデータは驚異的です。

- 53万トークンのテストで、再現率 100%

- 100万トークンのテストで、再現率 99.7%

- 1000万トークンという極限テストにおいても、99.2% の精度を維持

正直、この数字を初めて見た時は半信半疑でした。公式データは、往々にして最適な条件下で測定されるものだからです。

しかしその後、第三者機関による評価結果を確認したところ、データはほぼ一致していました。Artificial Analysis による独立テストでは、Gemini 1.5 Pro はあらゆるドキュメント長において極めて高い安定性を示し、特にドキュメントの中盤部分の記憶力が他のモデルよりも明らかに優れていることが示されました。

これには驚きました。以前の長文コンテキストモデルでは、ドキュメントの最初と最後は覚えているが中間がぼやけてしまう「中間忘却(Lost in the Middle)」問題がよく見られたからです。Gemini はこの問題をうまく解決しているようです。

実際のビジネスシーンにおける再現率

ただし、ラボのデータと実際の業務シーンは別物です。

私はより実務に近いテストを設計しました。約50万文字の技術ドキュメント集(API リファレンス、アーキテクチャ設計、トラブルシューティング・マニュアルなど)を用意し、その中の異なるドキュメントの異なる位置に、特定の構成パラメータをいくつか隠しました。そして Gemini に関連する質問をしました。

結果はどうだったでしょうか。

ほとんどのケースで見つけ出すことができました。しかし、いくつか興味深い点も見つかりました。

- 明確で構造化された情報(例:「API キーの有効期限は何日か」)については、再現率はほぼ 100% でした。

- しかし、少し推論が必要な質問(例:「ドキュメントの記述に基づき、この設計にどのようなセキュリティ上の懸念があるか」)では、精度は 80% 程度に低下しました。

- 質問が複数のドキュメントを跨ぐクロスリファレンスを必要とする場合、Gemini は稀にソースの一つを見落とすことがありました。

つまり、Gemini の長文コンテキスト能力は非常に強力ですが、万能ではないということです。特に単純な検索ではなく複雑な推論が必要な場合には、依然として最適化の余地があります。

Context Caching の徹底解説

なぜコンテキスト・キャッシュが必要なのか

Gemini が大容量を保持でき、記憶力も良いことが分かりました。しかし、ここで大きな問題が立ちはだかります。「コスト」です。

200万トークンというのは魅力的ですが、対話のたびにその200万トークンを再送信していたら、請求額を見て泣きたくなるでしょう。

Gemini 1.5 Pro の価格設定(2026年2月時点)では、128K を超える入力に対して 100万トークンあたり 2.50ドルかかります。つまり、200万トークンのリクエストを1回送るだけで、入力だけで 5ドルかかる計算です。1日に100回のクエリがあれば 500ドルです。

このコストは、ほとんどのアプリケーションにおいて許容できるものではありません。

そこで登場するのが、Context Caching(コンテキスト・キャッシュ) です。

Context Caching の仕組み

簡単に言うと、Context Caching は、繰り返し使用されるコンテキストをあらかじめロードしてキャッシュしておく仕組みです。以後のクエリでは、新しい質問とキャッシュ ID を送るだけで済み、数百万トークンの背景資料を繰り返し送る必要がなくなります。

具体的なフローは以下の通りです。

- 初回のエンジニアリングリクエスト時にドキュメントを Gemini に送り、同時にキャッシュの作成を要求します。

- Gemini はキャッシュ ID を返し、サーバー側でこれらのトークンの状態を保持します。

- 以後のクエリでは、キャッシュ ID と新しい質問のみを送信します。

- 課金は、新しい質問のトークン費用 + 少額のキャッシュ維持費のみとなります。

重要なのは、キャッシュにヒットしたトークンの料金は、通常価格のわずか 10% になるという点です。つまり、本来 5ドルかかっていた入力コストが 0.5ドルで済むのです。

この仕組みを理解したとき、Google はコストの問題をしっかり想定した上で、非常にエレガントな解決策を用意していたのだと感心しました。

Explicit Caching(明示的キャッシュ) vs Implicit Caching(暗黙的キャッシュ)

Gemini は2つのキャッシュモードを提供しています。

Explicit Caching(明示的キャッシュ):明示的に API を呼び出してキャッシュを作成し、どの内容をキャッシュするか、TTL(有効期限)などを手動で設定します。コントロール性が高く、ナレッジベースやコードリポジトリなど、境界が明確なデータセットに適しています。

Implicit Caching(暗黙的キャッシュ):2025年5月以降に導入された機能で、システムが重複するトークンプレフィックスを自動的に検出し、キャッシュを行います。開発者側での操作は不要であり、開発体験(DX)としてはまさに神機能です。

ただし、Implicit Caching はトリガー条件(通常、同一のプロンプトプレフィックスが一定の長さに達する必要がある)があります。毎回のクエリでコンテキストが大幅に異なる場合は、この恩恵を受けられません。

キャッシュヒット率がコストに与える影響

簡単な計算をしてみましょう。

ナレッジベースが 100万トークンで、1日あたり平均 1000回のクエリがあると仮定します。

キャッシュを使わない場合:

- 1日の入力トークン:1,000,000 × 1000 = 10億トークン

- 費用:10億 ÷ 100万 × 2.50ドル = 2500ドル/日

Context Caching を使う場合:

- 初回ロード:2.50ドル(一度きり)

- キャッシュ維持費:1.00ドル/100万トークン/時 × 100万トークン × 24時間 = 24ドル/日

- 以後のクエリ入力(10%として計算):0.25ドル/100万トークン

- 1日のクエリ費用:1000 × 500トークン × 0.25ドル/100万トークン ≈ 0.125ドル/日

- 合計:約 25ドル/日

コストが1日 2500ドルから 25ドルへと、実質的に 100分の1 にまで下がりました。

これが Context Caching の威力です。この計算結果を見てから、私はいくつかのプロジェクトを RAG から移行すべきかどうか真剣に検討し始めました。

コスト対決:長文コンテキスト vs RAG

Gemini API 料金体系(2026年最新)

正確な比較のために、Gemini の最新料金(2026年2月時点)を整理します。

| モデル | コンテキスト窓 | ≤128K 入力 | >128K 入力 | 出力 |

|---|---|---|---|---|

| Gemini 1.5 Pro | 2M | $1.25/MTok | $2.50/MTok | $5.00/MTok |

| Gemini 1.5 Flash | 1M | $0.075/MTok | $0.15/MTok | $0.60/MTok |

| Gemini 2.5 Pro | 2M | $1.25/MTok | $2.50/MTok | $10.00/MTok |

※MTok = Million Tokens(100万トークン)

Context Caching の料金構造:

- キャッシュストレージ:$1.00/100万トークン/時

- キャッシュヒット:元の入力価格の 10%

- キャッシュミス:通常価格

RAG システムの隠れたコスト

一方、RAG 構成のコストを考えてみましょう。表面上は Embedding 費用とベクトルデータベース費用だけで済むため、安く見えます。しかし、実際には多くの隠れたコストが存在します。

顕在的コスト:

- Embedding API:text-embedding-3-large の場合、100万トークンあたり 0.13ドル

- ベクトルデータベース:Pinecone 標準プランで約 70ドル/月、またはセルフホストのサーバー費用

- LLM 生成費用:使用するモデルに依存

隠れたコスト:

- 開発・保守コスト:RAG パイプラインの構築と維持にはエンジニアの工数が必要

- 検索精度のチューニング:チャンクサイズ、オーバーラップ、リランキング戦略など、試行錯誤の連続

- 遅延問題:検索 + 生成の2ステップ操作により、レスポンス時間が長くなる

- 再現率の損失:どれほど優れた RAG でも、関連内容を検索しきれない場合がある

以前携わったプロジェクトでは、チームで丸2週間を RAG システムのチューニングに費やしました。チャンクサイズの調整、Embedding モデルの変更、リランキング戦略の試行。その結果、再現率は 75% から 85% まで向上しましたが、完璧には程遠い状態でした。

この2週間の人件費を金額に換算すると、1年分の API 費用を軽く超えてしまいます。

臨界点の発見:いつ切り替えるべきか

結局のところ、いつ長文コンテキスト + Context Caching を選び、いつ RAG を使い続けるべきなのでしょうか。

判断のための基準を整理しました。

長文コンテキストが適しているケース:

- ドキュメント総量が 200万トークン以内(約3000ページの PDF に相当)

- クエリ頻度が高い(1日数百回以上)

- ドキュメント間の横断的な関連分析が必要

- 多少の初期遅延(RAG と比較しても実際にはこちらの方が速い場合が多い)を許容できる

- 複雑な検索インフラを維持したくない

RAG が適しているケース:

- ドキュメント総量が膨大(数千万トークン以上)

- クエリ頻度が非常に低い(1日数回〜数十回)

- 正確なパーツ単位の引用(ソースの明示)が求められる

- コスト管理に極めて敏感で、かつドキュメントが頻繁に更新される

- すでに成熟した RAG インフラを所有している

例えば、50万文字程度のドキュメントを持つカスタマーサポート・ナレッジシステムで、1日 500回のクエリがある場合、長文コンテキスト + Context Caching の月額コストは約 50ドル程度です。一方、RAG 構成ではベクトルデータベース代や保守工数を考えると、むしろ高くつく可能性があります。

しかし、もし数億文字に及ぶ法律文献プラットフォームを構築するのであれば、依然として RAG が最適な選択肢となります。

実戦:Context Caching 導入ガイド

前提条件と制限事項

Context Caching を試す前に、以下の条件を確認してください。

- モデルバージョン:Gemini 1.5 Pro 以上のモデルを使用する必要があります。

- トークン数:キャッシュする内容は少なくとも 32,768 トークン以上である必要があります(これ未満ではコストメリットが出ません)。

- 有効期限:デフォルトのキャッシュ保存期間は1時間です(延長可能)。

- リージョン制限:一部の地域ではサポートされていない場合があるため、公式ドキュメントを確認してください。

Python SDK 実装例

以下は、そのまま利用できる実装コードの抜粋です。

import google.generativeai as genai

from google.generativeai import caching

import datetime

# API キーの設定

genai.configure(api_key="YOUR_API_KEY")

# キャッシュする内容の準備

# ここでは大きなドキュメントを想定します

document_content = """

[あなたの長文ドキュメント内容。少なくとも 32,768 トークン以上]

"""

# キャッシュの作成

cache = caching.CachedContent.create(

model='gemini-1.5-pro-002',

display_name='knowledge_base_cache',

system_instruction='あなたは専門的なテクニカルアシスタントです。提供されたドキュメントに基づき回答してください。',

contents=[document_content],

ttl=datetime.timedelta(hours=1), # 1時間キャッシュ

)

print(f"キャッシュ作成完了。ID: {cache.name}")

print(f"トークン数: {cache.usage_metadata.total_token_count}")

# キャッシュを使用して対話

model = genai.GenerativeModel.from_cached_content(cached_content=cache)

# 以後のクエリでは質問を投げるだけでよく、ドキュメントを繰り返し送る必要はありません

response = model.generate_content("ドキュメントで説明されている API 制限ポリシーについて教えてください。")

print(response.text)

# キャッシュの有効期限を延長

cache.update(ttl=datetime.timedelta(hours=2))

# 使用後は削除(もしくは自動失効を待つ)

# cache.delete()キャッシュのライフサイクル管理

実務では、以下のライフサイクル管理を考慮する必要があります。

作成のタイミング:アプリケーションの起動時に共有ドキュメントをプリロードするか、ユーザーがドキュメントをアップロードした際に必要に応じて作成します。

更新(延長)戦略:キャッシュの期限が迫っており、かつアクティブなクエリがある場合は、バックグラウンドで自動的に延長(update)を行います。

破棄戦略:不要になったキャッシュは速やかに削除し、ストレージ費用を節約します。

# キャッシュ一覧を取得

caches = caching.CachedContent.list()

for c in caches:

print(f"{c.display_name}: {c.name} (残り {int(c.expire_time.timestamp() - datetime.datetime.now().timestamp())} 秒)")

# 期限切れ間近のキャッシュを一括削除

now = datetime.datetime.now()

for c in caches:

if c.expire_time < now + datetime.timedelta(minutes=5):

c.delete()

print(f"キャッシュを削除しました: {c.display_name}")よくある落とし穴と解決策

- キャッシュミスによる想定外の課金:キャッシュ ID の指定ミスや期限切れにより、キャッシュが利用されず通常料金がかかることがあります。ログでキャッシュの利用状況を確認してください。

- トークン計算の不一致:キャッシュの条件である 32,768 トークンを超えているかどうかの判定において、独自の計算と Google 側の計算が異なる場合があります。SDK の

usage_metadataで確認するのが確実です。 - ドキュメントの更新:元のドキュメントが更新されてもキャッシュは自動で更新されません。手動で古いキャッシュを削除し、新しいキャッシュを作成する必要があります。

アーキテクチャの決断:RAG は死んだのか、それとも共生か?

長文コンテキストの限界

Gemini を絶賛してきましたが、ここで少し冷や水を浴びせておきましょう。長文コンテキストは万能薬ではなく、明確な限界があります。

- コストの上限:Context Caching でコストは下がりますが、ドキュメントが数千万トークン以上に及ぶ場合、キャッシュ維持費自体が無視できない額になります。

- 更新頻度:ドキュメントが頻繁に変更される場合、キャッシュの再構築コストがかさみ、メリットが薄れます。

- 精密な引用:RAG は「どのドキュメントの何ページ目」といったソースの特定が得意ですが、長文コンテキストのみではこのトレーサビリティはやや弱くなります。

RAG が不可欠なシーン

認めましょう。依然として RAG がより良い選択肢となるシーンは存在します。

- 膨大なドキュメント検索:ドキュメント規模がテラバイト級に達する場合、ベクトルデータベースなしでは処理できません。

- リアルタイム性の高い更新:ニュースや株価など、分単位での更新が必要なケース。

- 複雑な検索要件:キーワード、タグ、フィルタリングなどを組み合わせた高度な検索が必要な場合。

ハイブリッド・アーキテクチャの可能性

実は、長文コンテキストと RAG は「どちらか一方」という排他的な関係ではありません。賢明な開発者は、すでにハイブリッドな構成を模索し始めています。

- 第1レイヤー(粗い絞り込み):ベクトル検索(RAG)を用いて、膨大なデータから関連性の高い数百のドキュメントを抽出する。

- 第2レイヤー(精読):抽出されたドキュメント群を Gemini の長文コンテキストに流し込み、深い分析を行う。

これにより、膨大なデータへの対応力と、長文コンテキストによる深い理解を両立できます。現在、RAG が「粗引き」、Gemini が「精読」を担当するという役割分担は、最も効果的な構成の一つです。

未来展望と結び

長文コンテキスト技術のトレンド

2026年初頭の現在から振り返ると、長文コンテキスト技術の進化速度には驚かされます。Gemini はすでにウィンドウを1000万トークン級へと押し広げようとしており、他社も追随しています。コンテキストウィンドウのさらなる拡大と、費用の継続的な低下は今後も続くでしょう。

より重要なのは、モデルの「実効的な記憶力」が向上している点です。初期の長文コンテキストは「読み込めるが覚えられない」ものでしたが、現在の Gemini は「読み込めて、かつ正確に記憶できる」レベルに達しています。

あと数年もすれば、「ドキュメントが大きすぎて処理できない」という悩みは、かつての「メモリ不足」と同じように、過去の遺物となっていくかもしれません。

RAG 開発者へのアクション指南

もしあなたが RAG 開発者であれば、この潮流に対して以下のスタンスをお勧めします。

- 慌てないこと:RAG は完全には消えません。役割が明確になっただけです。

- 変化を受け入れること:一部の小規模プロジェクトを長文コンテキスト + キャッシュ構成に移行し、違いを肌で感じてみてください。

- ハイブリッドを視野に入れること:RAG の拡張性と長文コンテキストの理解力を組み合わせるのが、当面の最適解になるでしょう。

- コストを直視すること:新技術への憧れや既存技術への固執を捨て、データに基づいて最も優れた手法を選んでください。

この記事を書き終えて、私の Gemini に対する態度は「懐疑」から「慎重な楽観」へと変わりました。銀の弾丸(万能な解決策)ではありませんが、特定の条件下では、従来の RAG よりもエレガントで経済的な解となり得ることは間違いありません。

技術の価値は新しさではなく、実際に問題を解決できるかどうかにあります。この記事が、長文コンテキストと RAG の間での賢明な選択の一助となれば幸いです。

FAQ

Gemini の 200万トークンというコンテキスト容量は実際どれくらいの内容ですか?

Context Caching は具体的にどのようにコストを削減しますか?

どのような場合に長文コンテキストではなく RAG を選ぶべきですか?

ハイブリッド・アーキテクチャとはどのようなものですか?

9 min read · 公開日: 2026年2月27日 · 更新日: 2026年3月18日

関連記事

OpenClaw 2026.3 実践アドバンス:新バージョンのコア機能とベストプラクティス

OpenClaw 2026.3 実践アドバンス:新バージョンのコア機能とベストプラクティス

OpenClaw 実践完全マニュアル:入門から精通まで

OpenClaw 実践完全マニュアル:入門から精通まで

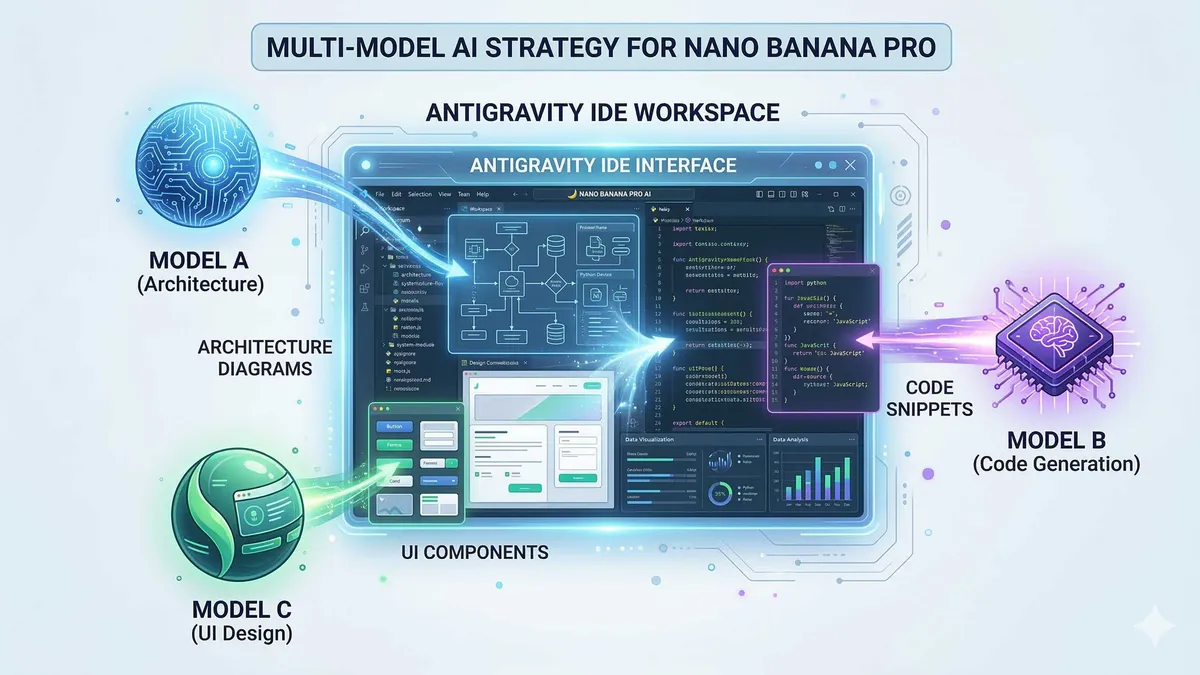

単一モデルの囚人にならない:Antigravity で Gemini 3、Claude 4.5、GPT-OSS を柔軟に使い分ける方法

コメント

GitHubアカウントでログインしてコメントできます