Google AI エコシステムにおけるデータプライバシーとセキュリティ:NotebookLM エンタープライズ版と Antigravity の安全な隔離メカニズム

「主力製品の技術ドキュメントを、あの AI ツールにアップロードして分析しても大丈夫だろうか?」

会議室で CTO がセキュリティ責任者に問いかけます。責任者はメガネのブリッジを押し上げ、3 秒間の沈黙の後、「彼らのデータ処理合意書を確認する必要がありますね」と答えました。

この光景を、私は過去 1 年間の企業向け AI コンサルティングの中で幾度となく目にしてきました。CTO は AI による効率化のチャンスを見ており、CISO(最高情報セキュリティ責任者)はデータ漏洩のリスクを見ています。どちらの言い分も正しく、両者は一つの「答え」を待っています。

正直なところ、この問いに標準的な正解はありません。しかし、NotebookLM エンタープライズ版と Antigravity における Google のセキュリティメカニズムを正しく理解することは、より「情報の備わった(informed)」意思決定のアシストになるはずです。

この記事は、AI を活用したいがセキュリティの底線(デッドライン)は譲れない、という企業の意思決定者向けに書かれています。NotebookLM がどのようにデータを扱うのか、Antigravity のローカル・クラウド・アーキテクチャ、そして VPC-SC などのツールがいかに API 呼び出しを保護するかについて解説します。

宣伝抜きで、技術的事実とコンプライアンス上の考慮事項のみをお伝えします。

NotebookLM エンタープライズ版:データ境界の約束

まずは、企業のナレッジ管理向け AI ツールである NotebookLM についてです。

核心的な懸念:私がアップロードしたドキュメントは、Google によってモデルの学習に使用されるのか? 人的なレビューは行われるのか? 他のユーザーに漏洩することはないのか?

公式の約束(Workspace Enterprise 版)

Google Workspace 管理ヘルプのドキュメントによれば、エンタープライズユーザーに対して以下のことが保証されています。

- モデル学習に使用しない:アップロードされたコンテンツ、クエリ、およびモデルの応答が、生成 AI モデルの学習に使用されることはありません。

- 人的レビューなし:人間のレビュアーによってコンテンツが閲覧されることはありません。

- エンタープライズレベルのデータ保護:NotebookLM は 2025 年 2 月に Google Workspace のコアサービスとなり、Workspace のエンタープライズ向けデータ保護条項の適用対象となりました。

これは個人版とは決定的な違いがあります。個人版の条項には、「フィードバックを提供した場合、人間のレビュアーがあなたのクエリ、アップロード内容、およびモデルの応答を閲覧することがある」と明記されています。企業にとって、これは許容できないリスクです。

データの保存場所

Bay Tech Consulting の解析によると、NotebookLM エンタープライズ版のデータは Google Workspace のインフラストラクチャ内に保存され、顧客と締結した契約条項に従います。つまり、データのレジデンシー(所在)とコンプライアンスは、Workspace のエンタープライズ合意書によってカバーされます。

データの保持

- クエリ(質問内容)は保存されません。

- アップロードされた資料、保存されたノート、オーディオ・オーバービューは、ユーザーが明示的に削除するまで保存されます。

- 削除後は、Google Workspace の標準的な削除プロセスに従います。

実務上の意味

金融、医療、法律などの機密情報を扱う業界にとって、これは「Workspace Enterprise 版を使用している限り」、比較的安心して内部ドキュメントを NotebookLM に処理させることができることを意味します。

ただし、「比較的安心」は「絶対安全」とイコールではありません。法律上の要求、セキュリティ上の必要性、あるいはサービス品質改善のために Google がデータにアクセスする可能性は依然として存在しますが、それらのアクセスは厳格に制御され、監査の対象となります。

Gemini API のデータガバナンス

NotebookLM のバックエンドでは Gemini モデルが動いています。Gemini API のデータ処理ロジックを知ることは、リスク評価において非常に重要です。

データ利用の 3 つのレイヤー

1. 消費者版(Consumer):

- データはセキュリティ、監視、QA、不正防止のために記録・保存される可能性があります。

- 人的なレビューが行われる可能性があります。

- データがサービスの改善に使用される可能性があります。

2. Workspace 版:

- Workspace データ処理合意書(DPA)に従います。

- モデル学習には使用されません。

- 人的レビューは、不正調査などの特定の場合にのみ発生します。

3. エンタープライズ版(Gemini Enterprise/Cloud):

- 最も厳格なデータ分離が行われます。

- データレジデンシー(指定地域内保存)のコミットメントがサポートされます。

- 顧客管理暗号鍵(CMEK)がサポートされます。

- VPC Service Controls がサポートされます。

GDPR コンプライアンス

欧州のユーザー向けに、Gemini はリージョン内でのデータレジデンシー保証をサポートしています。静止状態のデータは指定されたリージョン内に配置され、GDPR の要件に準拠します。ただし、現在の技術的制約により、モデルの推論処理(Inference)自体はリージョンを跨いで行われる可能性がある点には注意が必要です。

キー・アドバイス

厳格なコンプライアンス要件がある企業は、無料の消費者版をビジネス目的で使用すべきではありません。少なくとも Workspace Enterprise を、可能であれば Gemini Enterprise Cloud 版を使用してください。

Antigravity のローカル・クラウド・アーキテクチャ

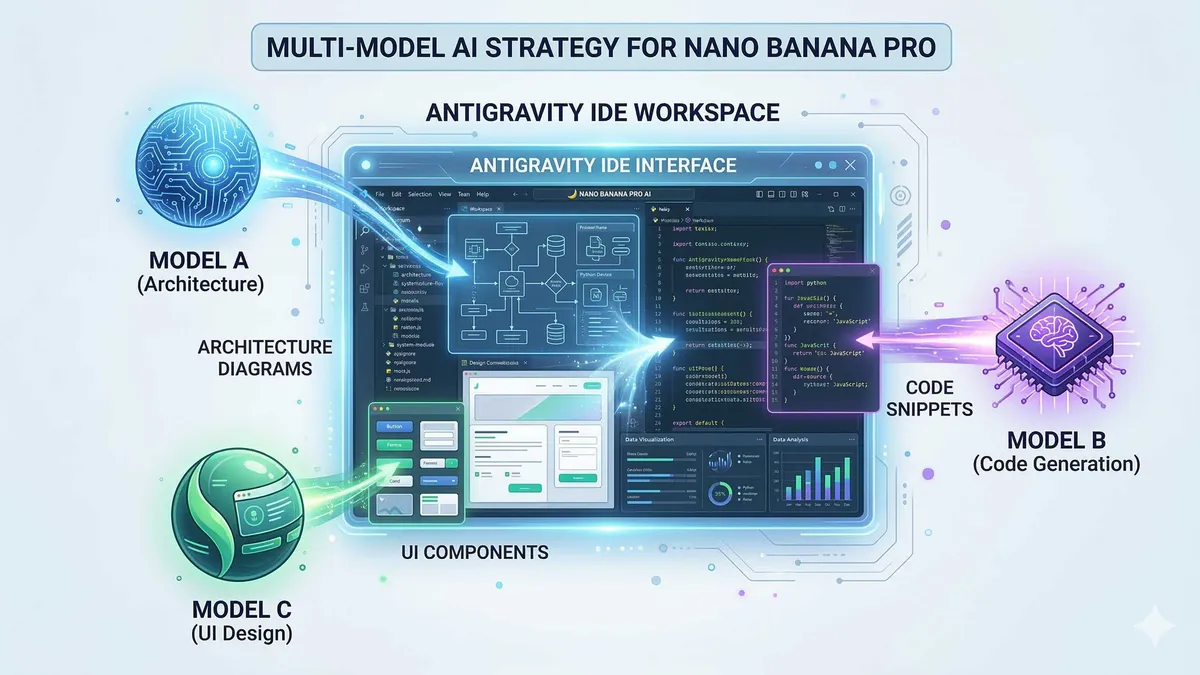

Google のエージェント優先型 IDE である Antigravity は、NotebookLM とは少し異なるセキュリティアーキテクチャを持っています。

実行モデル

Google Codelabs の記述によれば、Antigravity はハイブリッドアーキテクチャを採用しています。

- ローカル実行: コード編集、ファイル操作、ローカルスクリプトの実行は、ユーザーのローカルマシン上で行われます。

- クラウド推論: AI モデルの呼び出し(Gemini 3)は、Google のサーバーへ送信されて処理されます。

- オプションのセルフホスト: エンタープライズ版は、VPC(仮想プライベートクラウド)内で一部のコンポーネントを動かす構成にも対応しています。

これが意味すること

あなたのソースコードは、デフォルトの状態ではクラウドへ送信されることはありません——ただし、エージェントに対してクラウド型モデルを必要とするタスクを実行するよう明示的に要求した場合を除きます。例えば:

- ローカルでのコード補完? → ローカルで処理

- Gemini 3 を呼び出してコードを生成? → クラウドへ送信

- エージェントにコードベース全体を分析させる? → 一部のメタデータがアップロードされる可能性があります

コードセキュリティ戦略

企業で Antigravity を導入する際は、以下の戦略を推奨します。

- 機密コードベースの隔離: 核心的なアルゴリズムやシークレット(鍵)管理コードは、Antigravity の管理下に置かない。

- ネットワークの隔離: VPC-SC(後述)を使用して、エージェントがアクセス可能な外部サービスを制限する。

- 監査ログ: 操作ログを有効化し、エージェントがどのような操作を行い、どの API を呼び出したかを記録する。

エンタープライズ導入構成

Augment Code の分析によると、Antigravity エンタープライズ版は Cloud Run アーキテクチャをサポートしており、以下のサービスと連携します。

- Cloud Storage(リポジトリの内容)

- BigQuery(コードのメタデータと検索)

- VPC Service Controls および IAM 統合によるエンタープライズセキュリティ

この構成により、企業は自社のプライベートクラウド環境で Antigravity の一部を動かしつつ、クラウド AI の能力を享受できるようになります。

VPC Service Controls:安全な境界の構築

VPC Service Controls(VPC-SC)は、Google Cloud が提供するセキュリティ機能で、データの安全な境界(信頼境界)を構築するために使用されます。

核心的なコンセプト

VPC-SC を使用すると、「サービス境界(Service Perimeter)」を定義できます。この境界内では:

- データの自由な移動が許可されます。

- 外部からのアクセスは遮断、または厳格に監査されます。

- Google 側の内部サービスであっても、この境界ルールに従う必要があります。

AI ワークロードへの適用

Gemini、NotebookLM、Antigravity を利用する企業において、VPC-SC は以下を実現します。

- データ流出の防止: コードやドキュメントが、誤って個人の Google アカウントや意図しない外部サービスと同期されるのを防ぎます。

- API 呼び出しの制限: 特定の VPC からのみ Gemini API を呼び出せるように制限します。

- 全アクセスの監査: 誰が、いつ、どのような方法で AI サービスにアクセスしたかを完全に記録します。

設定例(イメージ)

# 簡略化された VPC-SC 設定のコンセプト

title: "AI Services Perimeter"

resources:

- projects/my-enterprise-project

restrictedServices:

- gemini.googleapis.com

- notebooklm.googleapis.com

- storage.googleapis.com

ingressRules:

- from:

identities:

- serviceAccount:[email protected]

to:

operations:

- "*"導入のアドバイス

InfoQ の実践レポートによれば、企業規模で VPC-SC を導入するには以下のステップが必要です。

- 段階的な実施: まずは検証環境で確認してから本番へ展開します。

- サービスマッピング: 依存しているすべての Google サービスを整理し、予期せぬ通信遮断を防ぎます。

- 緊急回避(Break-glass)戦略: 緊急時に境界をバイパスする仕組みをあらかじめ用意しておきます。

- 継続的モニタリング: VPC-SC のログを SIEM(セキュリティ情報イベント管理)に統合し、異常をリアルタイムで検知します。

企業向け AI 導入のコンプライアンス・チェックリスト

実務において、ある AI ツールが自社に適しているかどうかを評価するためのリストです。

データの分類評価

まず、AI に入力するデータを分類します。

- 公開データ: 公式サイトの内容、発表済みの資料 → 低リスク

- 内部データ: 技術仕様書、プロジェクト計画 → 中リスク(利用規約の確認が必要)

- 機密データ: 顧客情報、財務データ、核心的アルゴリズム → 高リスク(追加の保護措置が必要)

サプライヤー評価リスト

各ツールに対し、以下の項目を確認してください。

データ学習ポリシー:

- モデル学習に使用しないという明確な約束があるか

- 契約レベルの保証があるか(利用規約だけでなく特約があるか)

- 人的レビューが行われる条件と範囲は明確か

データの所在とセキュリティ:

- 指定地域(リージョン)での保存をサポートしているか

- 転送時・静止時の暗号化が行われているか

- 独自の暗号鍵(CMEK)を利用できるか

コンプライアンス認証:

- SOC 2

- ISO 27001

- GDPR 準拠声明

- 業界固有の認証(HIPAA、PCI-DSS など)

エンタープライズ機能:

- SSO/SAML 対応

- 監査ログの提供

- きめ細かな権限管理

- データの外部出力・削除機能

結び

冒頭の会議室の光景に戻りましょう。

CTO が問います。「主力製品の技術ドキュメントを、あの AI ツールにアップロードして分析しても大丈夫だろうか?」

今や、セキュリティ責任者はより具体的で前向な回答を出すことができます。

「NotebookLM エンタープライズ版であれば、データは学習に使われず、人的レビューもないため、コンプライアンス上のリスクは制御可能です。ただし、核心的なアルゴリズムについては、まずは機密情報を伏せた状態でテストすることをお勧めします。また、VPC-SC を構成して、意図しない場所へのデータ流出を防ぐ必要があります。」

「Antigravity も利用可能ですが、機密コードはローカルで隔離して管理させましょう。AI にはコード生成やリファクタリングなどの補助的な役割を担わせ、コアな部分はエンジニアがローカルで制御するようにします。」

これは「使える」か「使えない」かという二元論ではなく、リスクの階層化、技術的措置、そしてコンプライアンスプロセスの総合的な判断です。

AI 活用のプレッシャーは消えることはありません。競合他社はすでに動いており、顧客はより早い製品サイクルを期待し、内部チームは効率化ツールを求めています。しかし、セキュリティの底線を守ることも放棄できません。一度のデータ流出による代償は、AI がもたらすすべての利益を吹き飛ばしかねないからです。

重要なのは、この緊張感の中でバランスポイントを見つけることです。ツールのセキュリティメカニズムを理解し、適切な利用ポリシーを確立し、必要な技術的コントロールを実装する。

Google の AI エコシステム(NotebookLM、Antigravity、Gemini Enterprise)は、企業レベルのセキュリティにおいて比較的成熟した選択肢を提供しています。

最終的に、セキュリティを守るのは企業の責任です。ツール提供者は「能力」を与えてくれますが、それをどう使い、どう守るかは、あなたの決断にかかっています。

この記事が、あの会議室であなたが「確信を持った答え」を出すための一助となることを願っています。

FAQ

NotebookLM のエンタープライズ版と個人版で、データプライバシーに関する根本的な違いは何ですか?

- **モデル学習**: エンタープライズ版はデータを学習に使用しないことを明言していますが、個人版(特に無料版)はフィードバックを提供した場合などに使用される可能性があります。

- **人的レビュー**: エンタープライズ版は人間のレビュアーが内容を見ることはありませんが、個人版では品質向上のためにレビューが行われる場合があります。

- **データ保護条項**: エンタープライズ版は Google Workspace の法人向け保護条項が適用されますが、個人版は一般的なサービス利用規約に基づきます。

Gemini API の 3 つのレイヤー(Consumer/Workspace/Enterprise)で、データの扱いはどう変わりますか?

Antigravity のコードセキュリティメカニズムはどうなっていますか? 企業はどう安全に使うべきですか?

VPC Service Controls はどのように企業 AI のワークロードを保護しますか?

企業が AI ツールを導入する際、コンプライアンス面で確認すべき最低限の項目は?

6 min read · 公開日: 2026年2月28日 · 更新日: 2026年3月18日

関連記事

OpenClaw 2026.3 実践アドバンス:新バージョンのコア機能とベストプラクティス

OpenClaw 2026.3 実践アドバンス:新バージョンのコア機能とベストプラクティス

OpenClaw 実践完全マニュアル:入門から精通まで

OpenClaw 実践完全マニュアル:入門から精通まで

単一モデルの囚人にならない:Antigravity で Gemini 3、Claude 4.5、GPT-OSS を柔軟に使い分ける方法

コメント

GitHubアカウントでログインしてコメントできます