RAGシステム最適化実践:検索精度と生成品質のバランス

深夜2時、画面上のRAGシステムの検索結果を眺めて、私は考え込んでしまった。

ユーザーが「パスワードをリセットする方法」を尋ねたのに、システムが返したのは「パスワード複雑度要件」と「アカウントセキュリティ設定」だった。これは今夜調査している17件目のエラーケースだ。さらに頭を悩ませているのは、知識ベースに完全な「パスワードリセット手順」ドキュメントがあり、ベクトル類似度スコアも低くないのに、検索できないということだ。

その時、私の頭に一つの考えしか浮かばなかった:RAGシステム、どうしてこんなに調整が難しいのか?

もしあなたも知識Q&Aシステムを構築しているなら、似たような状況に遭遇した可能性が高い:検索結果は意味的に関連しているが質問に答えていない、生成された内容は一見流暢だが幻覚を含んでいる、ある段階を調整した結果別の段階を壊してしまった。正直に言うと、私はこうした落とし穴に落ち、多くの回り道をした。

本記事ではRAGシステムの完全な最適化パイプラインを紹介する——Query処理から検索戦略、チャック戦略から評価ループまで。「銀の弾丸」的なトリックではなく、実践的なデバッグ経験と判断フレームワークだ。読んでから、回り道を少なくできることを願っている。

1. RAGシステムの3つのボトルネック

調整を始める前に、私たちが実際に何の問題と戦っているのかをまず整理したい。多くの場合、最初からEmbeddingモデルを調整したり、ベクトルデータベースを交換したりするが、効果は理想的ではない。RAGシステムの問題は単一段階の問題ではなく、複数段階が重なった結果だからだ。

意味的ギャップ:ユーザーとドキュメントは別の言葉を話す

これはRAGシステムで最も頭を悩ませる問題だろう。

ユーザーが「システムがダウンしたらどうすればいい」と尋ねても、知識ベースには「サービス例外回復手順」が書かれている。意味的に、この2つの文章は関連しているが、ベクトルモデルはこの関連を見つけられない可能性がある。ユーザーは口語的な表現を使い、ドキュメントは比較的正式で専門的に書かれているからだ。

以前、金融会社の知識ベースQ&Aを担当した時のことを覚えている。ユーザーが「クレジットカードが凍結されたらどうすれば」と尋ねたのに、システムが返したのは「クレジットカード紛失報告手順」だった。ユーザーは почти怒り出した——凍結解除が欲しいのに紛失報告?その後、Query書き換えを行い、「凍結」を「アカウント凍結処理」にマッピングすると、再現率がすぐに改善した。

この問題の本質は:ユーザーの質問表現とドキュメントの表現之间存在一个意味的ギャップ。Embeddingモデルは意味理解で強いが、心を読む術はない——既存のトレーニングデータに基づいて類似度マッチングしかできない。

精密マッチング:ベクトル検索の弱点

ベクトル検索は意味類似性に優れているが、精密マッチングが必要なシナリオでは少し力不足だ。

例えば、ユーザーが「2024年第3四半期の売上は?」と尋ね、ドキュメントに「2024年第3四半期売上は3.2億元に達した」と書かれている場合、ベクトル検索は見つける可能性がある——「Q3」と「第3四半期」が意味的に近いから。しかし、ユーザーが「売上最高の四半期は?」と尋ねた場合、ベクトル検索は困る——これは意味類似性の問題ではなく、データの計算と比較が必要だから。

より微妙なケースがある:専門用語の精密マッチング。例えば「OAuth 2.0」と「OAuth 1.0」は、ベクトル空間では距離が近いかもしれないが、実際には完全に異なるプロトコルバージョンだ。検索結果が混ざって返された場合、ユーザーは誤った情報を得る。

テンセントクラウド開発者コミュニティの2026年技術報告によると、単一ベクトル検索の専門領域での精度平均は60%-70%しかなく、キーワード検索のハイブリッドを追加すると80%以上に達する。この差、正直に言うとかなり大きい。

コンテキスト断片化:チャンクが意味を切断

この問題は、本を断片に引き裂いて再構築するようなもの——一部の断片は合うが、一部はどうしても合わない。

固定チャックは最も簡単な方案だが、問題も最も明らかだ。例えば、コードセグメント:関数シグネチャを一つのチャックに切り、関数本体を別のチャックに切る可能性がある。検索時、シグネチャだけが返され、実装ロジックがない。ユーザーは長時間見てもこの関数の使い方がわからない。

私は一つのケースをテストした:同じ技術ドキュメント、固定500トークンチャックで検索精度62%;意味的チャック(段落、セクション境界で切る)に変更すると精度73%。11ポイントの差、これは単一変数の比較だけだ。

問題はさらに複雑だ:一部の情報は inherently 跨段落だ。例えば「この方案の欠点は…」という文章が第一段落に出るかもしれないが、具体的な欠点の説明は第二段落にある。第一段落だけ検索された場合、モデルは「この方案には欠点がある」と言うが、具体的に何かは言えない——典型的な情報断片化。

多くの問題を議論したが、落胆させるためではなく、調整前にボトルネックがどこにあるかを明確にするためだ。医者が診断してから薬を処方するように、ね?

2. Query処理:入力が下限を決める

ユーザーの質問は千差万別だが、RAGシステムの検索起点は一つ——その原始Queryだ。この段階が適切に処理されないと、後の調整はすべて努力半減だ。

まずユーザーが何を尋ねているかを明確に

多くの場合、ユーザーの質問はかなり曖昧だ。例えば「これどう使う」——コンテキストがないと「これ」が何を指すかわからない。しかし、知識ベースQ&Aシステムでは、ユーザーの履歴对话、現在のページコンテキストから推測できる。

実践的なアプローチは構造化意図理解。ユーザーの質問をいくつかの次元に分解する:

- コア意図:ユーザーが本当に知りたいのは何?(機能判断、成分確認、使用方法、トラブルシューティング)

- 関連エンティティ:質問にどの具体オブジェクトが含まれている?(製品名、バージョン番号、時間範囲)

- 暗黙条件:借用できるコンテキストがある?(ユーザーロール、操作環境)

例えば、ユーザーが「パスワードリセット失敗どうすれば」と尋ねた場合、構造化後:

- コア意図:トラブルシューティング

- 関連エンティティ:パスワードリセット

- 暗黙条件:ユーザーは既にパスワードリセット操作を試している

こう書き換えたQueryは、原始質問よりはるかに精密だ。

質問にタグを付ける

意図分類は新しいことではないが、RAGシステムで特に効果がある。

一組の意図タグを事前定義できる。例えば「アカウント問題」「支払い問題」「技術故障」「機能問い合わせ」。ユーザーが質問した後、まず小さな分類モデル(または直接LLM判断)でタグを付け、対応するドキュメントサブセットだけで検索する。

メリットは検索範囲を狭め、ノイズを減らすこと。VectorHubの技術ブログによると、意図事前分類を追加すると、検索精度平均15%-25%向上できる。私自身のテストデータも似ていて、約20%の改善だ。

実装も複雑ではない、LangChainのRunnableLambdaでできる:

from langchain_core.runnables import RunnableLambda

def classify_intent(query: str) -> str:

# 簡単例:キーワードマッチング

if "密码" in query or "登录" in query:

return "账户问题"

elif "支付" in query or "退款" in query:

return "支付问题"

# ...更多规则

return "通用咨询"

# 检索链に組み込む

intent_chain = RunnableLambda(classify_intent)もちろん、キーワードマッチングは最も粗雑な方法だ。実際プロジェクトではLLMで意図認識を行う——精度より高いが、コストも上がる。

Query書き換えのテンプレート化

最後の手段はQuery書き換え。基本的に、ユーザーの口語表現をドキュメントの「言語スタイル」に変換する。

一連の書き換えテンプレートを準備でき、異なる質問タイプを標準化処理する。例えば:

| 原始質問 | 書き換え後 |

|---|---|

| これどう使う | [製品名]の使用方法と操作手順 |

| なぜエラーが出た | [エラー情報]の原因分析とソリューション |

| もっと速い方法ある? | [機能名]のショートカット操作方法 |

テンプレートのメリットは保守性が強いこと、デメリットは人工設計と継続的迭代が必要なこと。もし領域が比較的固定なら、テンプレート化書き換えは投資価値がある。開放領域Q&Aなら、LLMでリアルタイム書き換えに頼る——効果より良いが、レイテンシとコストも増加する。

3. ハイブリッド検索 + リランキング:検索精度の重要躍進

Query処理が「入力端」の仕事なら、ハイブリッド検索は「検索端」の杀手comboだ。2026年まで、Hybrid Searchは企業級RAGシステムの標準配置となっている。

なぜ単一検索は不十分

純ベクトル検索は意味類似性に優れているが、キーワード精密マッチングでは表現一般だ。純キーワード検索(BM25)は精密マッチングに優れているが、意味理解能力ゼロだ。両者は短板があるが、組み合わせると補完できる。

適切な比喻がある:ベクトル検索は「理解型読者」のような——「苹果」と「水果」の関係を知り、「この方案には欠点がある」と「方案に問題存在」が意味的に近いことを理解できる。BM25は「字面型読者」のような——字面マッチだけ認識、「OAuth 2.0」は「OAuth 2.0」、「OAuth 1.0」は別のものだ。

Hybrid Searchは両者を組み合わせ、まずそれぞれ検索、結果融合で、意味と精密の両方ニーズをカバーできる。

三段階アーキテクチャ:BM25 → ベクトル → リランキング

成熟したHybrid Searchアーキテクチャは通常三段階:

第一段階:BM25キーワード検索

キーワードを含むドキュメントを迅速召回、速度非常に速いが、結果は精密性不足かもしれない。この段階は「広召回」を担当、関連可能性のあるドキュメントをすべて捞める。

第二段階:ベクトル意味検索

Embeddingモデルで意味マッチング、意味的に類似したドキュメントを召回。この段階はBM25が漏らした意味関連だがキーワードマッチしないドキュメントを補充する。

第三段階:Cross-Encoderリランキング

前二段階の候補ドキュメントを一緒に置き、Cross-Encoderモデルで精密ランク。Cross-Encoderは同時処理Queryと各候補ドキュメント、精密関連性スコア計算。

この三段階アーキテクチャの効果データは堅実だ:Dasrootブログの実測によると、Hybrid Search + RRF + Rerankは再現率30%-50%向上できる。単一ベクトル検索との比較で、この改善幅はかなり注目すべき。

RRF融合アルゴリズム

二路検索結果どう合并?最も常用はRRF(Reciprocal Rank Fusion)アルゴリズム。

RRFのコア思想は簡単:各ドキュメントの異検索結果中のランクをスコアに変換、そして合計。ランク上位はスコア高、下位はスコア低。公式:

RRF_score = 1/(k + rank_BM25) + 1/(k + rank_vector)其中k通常取60。この参数は単一ランクが最終結果に過度影響を避ける。

実際実装では、LangChain已经封装好了:

from langchain.retrievers import EnsembleRetriever

from langchain_community.retrievers import BM25Retriever

from langchain_community.vectorstores import FAISS

# 初始化二つの検索器

bm25_retriever = BM25Retriever.from_documents(documents)

vector_retriever = FAISS.from_documents(documents, embeddings).as_retriever()

# 组合成混合検索器

ensemble_retriever = EnsembleRetriever(

retrievers=[bm25_retriever, vector_retriever],

weights=[0.4, 0.6] # BM25权重40%,ベクトル权重60%

)权重はデータ特性に基づいて調整できる。もしドキュメントのキーワードが比較的明確(例えば技術仕様、法律条文)、BM25权重高くできる;意味表現豊富(例えばFAQ、議論スレッド)、ベクトル权重高くできる。

Cross-Encoderリランキングの取舍

Cross-Encoder精度確実比Bi-Encoder高く、Medium技術分析報告によると、リランキングは追加2%精度向上できる。但代价是レイテンシ約100ms增加、Cross-Encoderは各候補ドキュメントを单独計算必要だから。

この取舍はシナリオを見る。もしユーザー300-500ms応答レイテンシを受け入れ可能(例えば専門相談)、Cross-Encoderリランキング追加価値ある。もし极致速度追求(例えばリアルタイムカスタマーサービス)、リランキング放弃、Hybrid Searchだけ使用かもしれない。

私の建议:まずHybrid Search(BM25 + ベクトル + RRF)で一回実行、再現率と応答時間測量。もし再現率まだ不足、Cross-Encoder追加。最初から所有调整堆上不去、否则判断各调整项实际贡献困難。

4. チャック戦略とメタデータフィルタリング

前章は検索层面問題討論、本章はドキュメント层面見る——どうドキュメント切る、どうドキュメントタグ付ける。良いチャック戦略は検索事半功倍、悪いチャック戦略は完全情報を七零八落切る。

意味的チャック vs. 固定チャック

固定チャックは最も容易実装方案:每Nトークン一切、内容何不問。実装簡単、但問題明顕——完全情報を二甚至多チャック切る可能。

意味的チャックはより聪明、内容自然境界で切:段落終了、セクション切替、コードブロック終了等。こう切った各チャックは相対完全意味单元。

LangChain提供RecursiveCharacterTextSplitterで意味的チャック実現:

from langchain.text_splitter import RecursiveCharacterTextSplitter

splitter = RecursiveCharacterTextSplitter(

chunk_size=800, # 每チャック最大800トークン

chunk_overlap=150, # 重複区150トークン

separators=["\n\n", "\n", ". ", " ", ""]

# まず双改行切(段落)、再単改行切(文)、再空白切(語)

)CSDN実戦ケースにデータ比較ある:同じ技術ドキュメント、固定チャック検索精度62%、意味的チャック73%。11ポイント差、特別大ではないが、大規模アプリケーション中、この差はユーザー満足度差累積。

重複区戦略

重複区は情報断片化防止保険。

二連続内容セグメント假设:

- 第一チャック:「…ユーザーは以下手順通過可能」

- 第二チャック:「パスワードリセット完了:1. ログインページクリック…」

もし重複区なし、「パスワードリセット手順」検索可能第二チャックだけ返、ユーザー「ユーザーは以下手順通過可能」开头見えない、情報不完全顕現。

重複区追加後、第一チャック末尾と第二チャック开头一部分重複内容有、こう无论检索哪一チャック、相対完全情報得。

CSDN実測データによると、150-200トークン重複区は再現率25%向上可能。私自身テスト数据も似て、但注意重複区太大存储成本和検索ノイズ增加、权衡必要。

メタデータフィルタリング:検索範囲狭める

チャック以外、メタデータも検索効率向上重要手段。

各ドキュメントチャックにメタデータ付与可能:ドキュメントソース、作成時間、所属カテゴリ、作者等。検索時、まずメタデータ事前フィルタリング、不符合条件ドキュメント排除、残ドキュメント中ベクトルマッチング。

例:ユーザー「2024年経費精算手順」尋ね、もし全ドキュメント「年份」メタデータ有、まず年份=2024ドキュメントフィルタ、再「経費精算手順」検索。こう検索範囲狭め、ノイズ干渉降低。

実装も直接:

# 假设ベクトルデータベースメタデータフィルタリング支持

results = vectorstore.similarity_search(

query="报销流程",

filter={"year": 2024, "category": "财务制度"}

)メタデータフィルタリング効果具体数字量化困難、データ構造依存ため。但もしドキュメント分類明確、時間跨度大、メタデータフィルタリング明顯効率改善带来——検索速度だけでなく、結果品質も。

5. 生成処理と評価ループ

前四章は検索討論、最終章は生成と評価見る。RAGシステム品質は検索精度だけでなく、生成品質も同様重要——両者往往一起調整必要。

検索結果どうモデルに渡す

検索戻りドキュメント盲目LLLMに塞げない。モデルコンテキスト長限制有、多くドキュメント塞げ浪费トークン、ノイズ引入可能。

実践戦略はコンテキスト融合:検索戻り多チャックドキュメント整理、直接拼接ではなく。

具体方法:

- 段落類似度クラスタリング:意味的近段落合并、重複情報減少

- NERエンティティ抽出:ドキュメント中重要エンティティ認識(人名、地名、用語)、包含エンティティ段落優先保持

こう整理後コンテキスト、情報密度高、ノイズ少、モデル生成回答より焦点。

スライディングウィンドウと重要性サンプリング

もしドキュメント多く、スライディングウィンドウメカニズム使用可能。每次最関連Nチャックドキュメントモデル渡、但前一轮部分コンテキスト保持、「滚动」情報流形成。

別技巧は重要性サンプリング:TF-IDF或BM25使用各チャックドキュメント重要性スコア計算、高スコアドキュメント優先選択。これリランキング類似、但生成段階而非検索段階適用。

正直、これら技巧効果改善検索調整那麼明顕ではなく、約3%-5%改善。但もしシステム已瓶颈段階、これら微調値得做。

定量評価:Ragas指標体系

評価なし、調整は盲目調整。Ragasは現在最流行RAG評価フレームワーク、定量指標セット提供、検索と生成品質測量。

コア指標四つ:

| 指標 | 意味 | 目標値 |

|---|---|---|

| Faithfulness | 生成回答検索内容忠実か | ≥ 0.80 |

| Context Precision | 検索内容関連性 | ≥ 0.70 |

| Context Recall | 検索内容必要情報カバーか | ≥ 0.75 |

| Answer Relevance | 回答ユーザー質問回答か | ≥ 0.80 |

Ragas使用コード简洁:

from ragas import evaluate

from ragas.metrics import faithfulness, context_precision, answer_relevance

# 評価データセット:question, answer, contexts, ground_truth包含

results = evaluate(

dataset=eval_dataset,

metrics=[faithfulness, context_precision, answer_relevance]

)評価結果クリア数字与える、システムど次元表現良、ど需要改善。例Faithfulnessだけ0.65、生成段階幻覚問題有;Context Precisionだけ0.50、検索段階召回内容ノイズ太多。

定量指標有、調整方向有。薄弱环节针对性調整、盲目試错ではなく。

評価ループ構築

評価一回性事ではなく、継続做必要。評価ループ構築:

- 基準評価:システム上线前、テストセットRagas実行、基準スコア記録

- 迭代調整:每次調整後再評価、基準対比効果変化見

- オンライン監控:上线後定期ユーザーフィードバックサンプリング、人工評価或自動化評価做

- フィードバック驱动:評価結果基づ次調整点探、ループ形成

このループ見た目繁琐、但RAGシステム継続良くなる核心メカニズム。ループなし、調整游击戦;ループ有、調整系统性迭代升级。

結論

多く議論後、最後判断フレームワーク与えたい、不同シナリオでど戦略使用帮助。

まずシナリオタイプ判断

知識ベース動的更新还是相対安定?もし動的知識(例ニュース、製品公告)、RAG良選択、知識ベース更新比微調モデルより灵活。もし安定領域(例法律条文、技術仕様)、微調考慮可能、モデル内化知識让。

再精度需求見

ユーザーど長応答時間受け入れ?もしユーザー実時性高要求(例カスタマーサービスシナリオ)、速度優先戦略優先:Hybrid Search(BM25 + ベクトル + RRF)、Cross-Encoderリランキングなし。もしユーザー数秒待換更精密答案(例専門相談)、精度優先戦略選択:Cross-Encoderリランキング追加、甚至多轮検索。

私的建议:評価から开始

多く開発者最初「調整」想、但何調整知らない。Ragas評価まず実行、定量指標得、薄弱环节探、针对性調整建议。

もしContext Precision低、検索戦略調整;もしFaithfulness低、生成段階コンテキスト処理調整。こう有的放矢達成。

RAGシステム調整持久戦、銀弾なし、終点なし。但系统性思考と定量フィードバック有、至少各步方向知。本記事回り道少なく帮助願っている。

FAQ

RAGシステム最常见検索問題何?

ハイブリッド検索为何単一ベクトル検索より効果良?

チャック戦略検索品質影響大?

Cross-Encoderリランキング値使用?

Ragas評価指標どう見?

RAGと微調どう選択?

12 min read · 公開日: 2026年4月21日 · 更新日: 2026年4月25日

AI 開発実践

検索からこのページに来た場合は、前後の記事もあわせて読むと同じテーマの理解がかなり早く深まります。

前の記事

Prompt Engineeringビジネス実践:カスタマーサポート、販売、オペレーション3大シーンガイド

カスタマーサポート、販売、オペレーション3つのビジネスシーンにおけるPrompt Engineeringの実践应用を詳解。実データ、再利用可能なプロンプトテンプレート、7ステップ企業導入プロセスを含み、AIプロジェクトの「適応不良」問題を解決

第 10 / 24 記事

次の記事

MCP Server 開発入門:ゼロから始める初めての MCP サービス構築

ゼロから学ぶ MCP Server 開発!TypeScript 原生 SDK を使用して、天気照会サービスの構築をステップバイステップで解説。Tools、Resources、Prompts の完全実装を含む。フロントエンド/フルスタック開発者向け、30 分で習得可能。

第 12 / 24 記事

関連記事

Workers AI 完全ガイド:毎日10,000回の無料LLM呼び出し、OpenAI比90%コスト削減

Workers AI 完全ガイド:毎日10,000回の無料LLM呼び出し、OpenAI比90%コスト削減

AIで10,000行のレガシーコードをリファクタリング:1ヶ月分の仕事を2週間で完了したリアルな振り返り

AIで10,000行のレガシーコードをリファクタリング:1ヶ月分の仕事を2週間で完了したリアルな振り返り

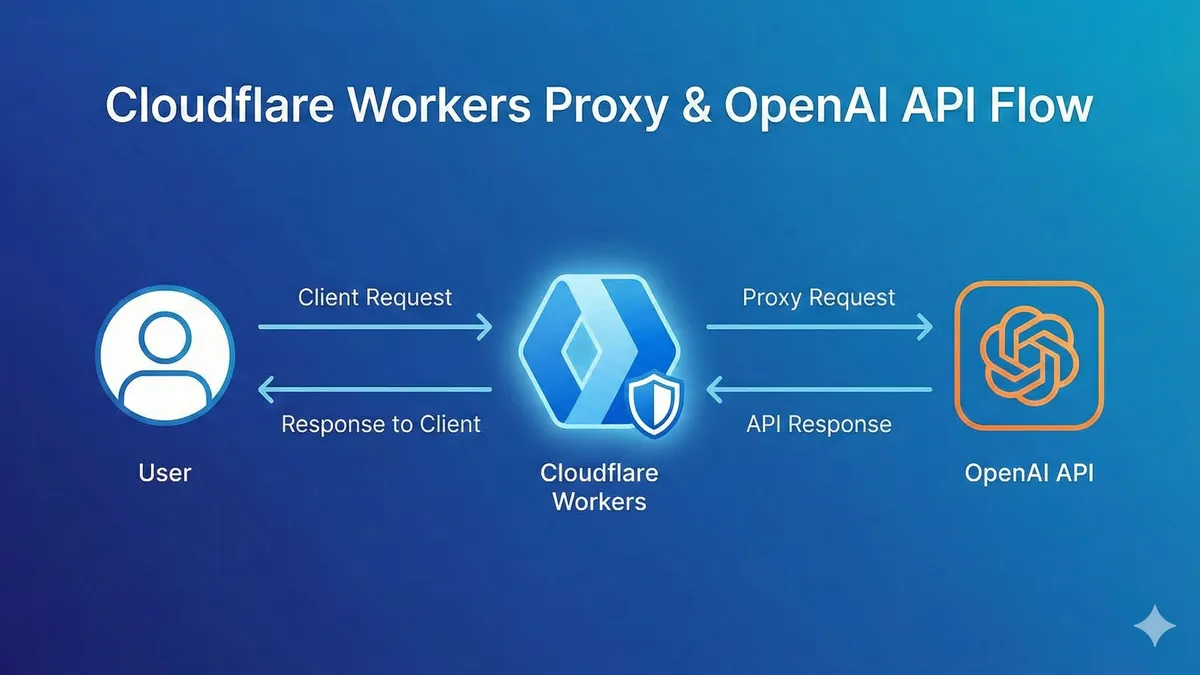

OpenAI APIがタイムアウトする?Workersで専用トンネルを構築、コストゼロで安定化

コメント

GitHubアカウントでログインしてコメントできます