LangGraph状態管理実践:2026年Agentアーキテクチャベストプラクティス

午前三時、私のAgentは27回目のリトライ後、最終的にクラッシュしました。状態データが失われ、会話コンテキストが断裂し、ユーザータイムアウト—これがMemorySaverを本番環境に持ち込んだ代償でした。

LangGraphのGitHubリポジトリは30,000 starsを突破し、2026年最も活発なAgentフレームワークとなっています。でも正直に言うと、多くの人のLangGraph使用はまだ「動けばいい」段階で止まっています。状態競合、永続化失敗、本番デプロイ困難—これらの問題はチュートリアルでほぼ触れられませんが、実際のプロジェクトで繰り返し発生します。

LangChainは2026年にState of Agent Engineeringレポートを公式発表しました。印象に残ったデータ:60%以上のAgent本番事故が状態管理に関連しています。この記事は「チュートリアルが教えないこと」を紹介します—State Schema設計パターン、Reducer関数実践、永続化選択、フレームワーク比較決定、そしてObservability統合。読み終わると、実行可能なコードテンプレートとフレームワーク選択の判断基準が手に入ります。

LangGraph状態管理核心:StateGraphからReducerへ

LangChainのChainを使った経験があるなら、StateGraphに馴染みがないかもしれません。Chainは線形—一歩一歩、パイプラインのように。でも実際のAgentロジックはそんなに単純ではありません:「ユーザー意図は雑談か問い合わせか」をあるノードで判断し、異なる分岐にジャンプする必要があるかもしれません;または複数ノードが並列実行し、最後に結果を集約します。これがStateGraph存在の意味です。

1.1 StateGraph構築パターン

StateGraphと普通のGraphの核心的な違いは「状態」という言葉です。普通のGraphノード間は固定の入出力を渡しますが、StateGraphの全ノードは同じ状態オブジェクトを共有します。各ノードは状態を読み取り、状態を修正し、修正後自動的に次のノードに渡されます。

from langgraph.graph import StateGraph, MessagesState

from langchain_openai import ChatOpenAI

# 状態構造定義(MessagesState継承、自動的にmessagesフィールド含む)

class AgentState(MessagesState):

next_action: str # 次のアクション

retry_count: int = 0 # リトライ回数

# グラフ初期化

graph = StateGraph(AgentState)

# ノード追加

graph.add_node("classify", classify_intent)

graph.add_node("respond", generate_response)

graph.add_node("fallback", handle_fallback)

# エッジ定義(条件分岐)

graph.add_conditional_edges(

"classify",

lambda state: state["next_action"],

{

"respond": "respond",

"fallback": "fallback"

}

)

# コンパイル—このステップ必須、コンパイルしないと実行不可

app = graph.compile().compile()メソッドは多くの人が見落とします。LangGraphを始めた頃、私は同じ罠にかかりました—ノードとエッジを書いて、実行時に「Graph not compiled」エラー。コンパイルは型チェック、エッグ接続性検証を行い、設定に基づいてcheckpointer注入します。

注意すべき詳細:StateGraphの状態は「増分更新」で、「完全上書き」ではありません。例えばノードAでretry_countを修正しても、ノードBはそのフィールドだけ読めばいい、他の状態は気にしない。この設計により並列実行が可能—複数ノード同時実行、各々異なる状態フィールドを修正、最後に結果をマージします。

1.2 状態Schema設計進化

状態構造定義には3つの方法があり、各々一長一短。

TypedDictは最も基本的、型安全ですがデフォルト値サポートなし:

from typing import TypedDict, Annotated

class SimpleState(TypedDict):

messages: list

context: str

# デフォルト値サポートなし、各フィールドに型注釈必須dataclassはPythonネイティブデフォルト値サポート、IDEヒント友好:

from dataclasses import dataclass

@dataclass

class DataclassState:

messages: list

context: str = ""

retry_count: int = 0 # デフォルト値可能Pydantic BaseModelは2026年の推奨方法。再帰検証、型変換サポート、LangChainツールとシームレス統合:

from pydantic import BaseModel, Field

class OptimizedState(BaseModel):

messages: list = Field(default_factory=list)

context: str = ""

retry_count: int = Field(default=0, ge=0) # 検証サポート:必須 >= 0

class Config:

# Pydantic v2設定

extra = "forbid" # 余計なフィールド禁止、状態汚染防止正直、TypedDictを使っていて、十分だと思っていました。ある時、Agent実行時に不正フィールドが混入(デバッグ時一時追加、削除忘れ)、後続ノードが奇妙なデータを受け取ってしまいました。半日かけて原因究明。それ以来、Pydanticのextra="forbid"設定に変更、入り口で不正フィールドをブロックしています。

1.3 Reducer関数メカニズム詳細

これはLangGraph状態管理の最核心、最も誤解されやすい部分です。

複数ノードが並列実行する時、同じ状態フィールドを同時に修正する可能性があります。LangGraphのデフォルト動作は「後の実行が前の実行を上書き」ですが、これは多くの場合望ましくありません。Reducer関数はこれら並列修正のマージ方法を定義します。

LangGraphは内蔵reducerを提供:add_messages。メッセージリストマージ用—自動重複排除、最新版保持:

from langgraph.graph import add_messages

class ChatState(TypedDict):

messages: Annotated[list, add_messages]2つの並列ノードがそれぞれmessagesにメッセージ追加する時、add_messagesは智能的にマージ、単純上書きではなく。

カスタムReducerは2つのパラメータを受け取る関数:現在値と新値。マージ結果を返します。

def merge_contexts(existing: str, new: str) -> str:

"""コンテキスト文字列マージ、最長版保持"""

if not existing:

return new

if not new:

return existing

return existing if len(existing) >= len(new) else new

class CustomState(TypedDict):

context: Annotated[str, merge_contexts]あるプロジェクトでカスタムreducerを使って「多路召回」シナリオを処理しました。3つの検索ノードが並列でベクトルDB、キーワードインデックス、知識グラフを検索、各々候補結果リストを返します。最後にreducerでマージ、重複排除、関連性順序でソート。この方式は逐次呼び出しより約3倍高速でした。

永続化とチェックポイント:本番級Agentの基石

冒頭の午前三時クラッシュ事件、根本原因は永続化を正しく設定していなかったこと。MemorySaverは状態をメモリに保存するだけ、プロセス再起動で消失。Agent実行途中でクラッシュ、ユーザー会話全消失—本番環境でこの種の事故は許容されません。

2.1 Checkpointerタイプと選択

LangGraphは3つのCheckpointerを提供、適用シナリオが大きく異なります。

| Checkpointer | 適用シナリオ | メリット | デメリット |

|---|---|---|---|

| MemorySaver | ローカル開発、高速テスト | ゼロ設定、極速 | プロセス再起動で消失 |

| SqliteSaver | 単機デプロイ、プロトタイプ検証 | 軽量、外部依存不要 | 書き込み性能有限、高並列不適 |

| PostgresSaver | 本番環境 | 信頼性高、高並列サポート | PostgreSQL維持必要 |

強く推奨:開発段階はMemorySaver、本番環境はPostgresSaver。SqliteSaverはスキップ—高並列シナリオで書き込み性能ボトルネックに苦しむでしょう。

# 本番環境設定例

from langgraph.checkpoint.postgres import PostgresSaver

import psycopg

# 同期版

conn = psycopg.connect("postgres://user:pass@host:5432/db")

checkpointer = PostgresSaver(conn)

# 非同期版(高並列推奨)

from langgraph.checkpoint.postgres.aio import AsyncPostgresSaver

import psycopg_pool

pool = psycopg_pool.AsyncConnectionPool(

"postgres://user:pass@host:5432/db",

min_size=5,

max_size=20

)

async_checkpointer = AsyncPostgresSaver(pool)

# コンパイル時注入

app = graph.compile(checkpointer=async_checkpointer)2.2 Thread IDメカニズム

Thread IDはLangGraphの多ユーザー/多セッション隔離核心メカニズム。各thread_idが独立状態履歴に対応、相互干渉なし。

# 初回会話

config = {"configurable": {"thread_id": "user_123_session_1"}}

result = app.invoke(

{"messages": [{"role": "user", "content": "私は小明です"}]},

config

)

# 第2回会話(同じthread_id)

# Agentは「私は小明です」を記憶

result2 = app.invoke(

{"messages": [{"role": "user", "content": "私の名前は?"}]},

config # 同じthread_id

)

# 異なるthread_id = 完全独立新セッション

config_new = {"configurable": {"thread_id": "user_456_session_1"}}

result3 = app.invoke(

{"messages": [{"role": "user", "content": "私の名前は?"}]},

config_new # Agentは「小明」を知らない

)このメカニズムは巧妙ですが、誤用しやすい。私はthread_idを固定値に設定するミスを犯しました—全ユーザーが同じ会話履歴を共有—ユーザーAの質問、ユーザーBが回答を見ました。正しい方法はユーザーID + セッションID組み合わせをthread_idに使います。

自動保存と自動読み込みはcheckpointerの別の「隠式」特性。手動でsave()やload()を呼ぶ必要なし、毎回invoke()やstream()呼び出しで自動トリガー。便利ですが、データベースが頻繁書き込みを耐える必要があります。

2.3 シリアライズと型サポート

LangGraphはデフォルトでJsonPlusSerializerで状態シリアライズ。サポート:

- Pythonネイティブ型(list, dict, str, int, float, bool)

- datetimeオブジェクト

- LangChainメッセージ型(HumanMessage, AIMessage等)

- enum列挙値

from datetime import datetime

from langchain_core.messages import HumanMessage

class RichState(TypedDict):

messages: list

created_at: datetime # datetimeサポート

status: str

# datetime直接保存可能、文字列変換不要

state = {

"messages": [HumanMessage(content="Hello")],

"created_at": datetime.now(),

"status": "active"

}ただしサポートしない型もあります、例えばPythonのset。状態にsetがある場合、自分でlistに変換、読み取り時に戻す必要があります。あるプロジェクトでsetでアクセス済みノードIDを保存、シリアライズ時にエラー、原因究明に時間かかりました。

2.4 本番デプロイ落とし穴ガイド

落とし穴1:SqliteSaver書き込み性能

SQLite書き込みロックはデータベースレベル、同時刻に書き込み操作1つのみ。Agentが100+並列会話処理する場合、SqliteSaverがボトルネック。症状:ユーザー要求遅延、エラー率上昇、ログに「database is locked」満載。

解決:直接PostgreSQL、非同期版AsyncPostgresSaver使用。

落とし穴2:非同期API選択

LangGraphの同期と非同期APIは分離。アプリが非同期フレームワーク(FastAPI、aiohttp)の場合、必ず非同期版を使用:

# 同期API(ブロック)

result = app.invoke(state, config)

# 非同期API(非ブロック)

result = await app.ainvoke(state, config)

# ストリーミング出力も対応非同期メソッド必要

async for chunk in app.astream(state, config):

yield chunk同期と非同期混用で問題発生。私はFastAPIルートで同期invoke()を呼び出し、イベントループ全体をブロック、他の要求全部停止しました。

落とし穴3:エラー回復メカニズム欠如

Checkpointerは状態保存しますが、自動失敗検出器ではありません。AgentがノードCでクラッシュする場合、状態はノードC前で停止、自分で「中断点から回復」ロジック実装必要:

# 前回中断点から回復

state = app.get_state(config)

if state.values.get("current_node") == "C":

# ノードC再実行

result = app.invoke(state.values, config)LangGraphはapp.get_state()とapp.update_state()APIを提供、状態読み取りと手動修正可能。デバッグ有用—チェックポイントに「ロールバック」して再実行できます。

フレームワーク比較:LangGraph vs CrewAI vs AutoGen

フレームワーク選択はプログラミング言語選択と同じ、「最善」なし、「最適」のみ。3つのフレームワークをプロジェクトで使用、各々特性があります。

3.1 3フレームワーク設計哲学

LangGraph:グラフ構造 + 状態駆動

LangGraphの核心理念は「明示的グラフ構造」。ノード、エッグ、状態を定義、フレームワークが実行。メリットは極強制御力—データの流れ、どのノードで何決定を明確に把握。デメリットは学習曲線急、コード量相対多。

# LangGraphスタイル:各ノードとエッグを明示定義

graph = StateGraph(AgentState)

graph.add_node("research", research_node)

graph.add_node("write", write_node)

graph.add_node("review", review_node)

graph.add_edge("research", "write")

graph.add_conditional_edges("write", should_review, {"review": "review", "end": END})CrewAI:ロール駆動 + 高抽象

CrewAIのアプローチは「ロール定義、協業させる」。Agent(ロール)、Task(タスク)、Crew(チーム)を定義、フレームワーク自動オーケストレーション。スタート迅速、数行コードで実行。でも制御力弱—下層オーケストレーションロジックがカプセル化、問題発生時デバッグ困難。

# CrewAIスタイル:ロールとタスク定義

researcher = Agent(role="Researcher", goal="Find information", ...)

writer = Agent(role="Writer", goal="Write articles", ...)

task1 = Task(description="Research topic X", agent=researcher)

task2 = Task(description="Write article based on research", agent=writer)

crew = Crew(agents=[researcher, writer], tasks=[task1, task2])

crew.kickoff() # 一行でスタートAutoGen:会話駆動 + 協業

AutoGenはMicrosoft Researchから、核心は「Agent間会話」。複数Agentを定義、会話で協業しタスク完了。頻繁コミュニケーション、交渉シナリオに適用、例えばコードレビュー、提案議論。でもToken消費高—Agent間会話が大量コンテキストを占有。

# AutoGenスタイル:Agentが会話で協業

assistant = AssistantAgent("assistant", llm_config=...)

user_proxy = UserProxyAgent("user_proxy", ...)

# Agent間自動会話

user_proxy.initiate_chat(

assistant,

message="ソートアルゴリズムを書いてください"

)

# assistantとuser_proxyが自動多回会話、タスク完了まで3.2 技術次元比較表

実際使用経験に基づき、いくつかの次元で比較しました:

| 次元 | LangGraph | CrewAI | AutoGen |

|---|---|---|---|

| 学習曲線 | 急 | 穏やか | 中間 |

| 制御力 | 極強 | 中間 | 中間 |

| 本番成熟度 | 最成熟 | 安定 | 改善中 |

| 状態管理 | ネイティブサポート | カプセル化 | カプセル化 |

| デバッグ能力 | 強(可視化trace) | 中間 | 中間 |

| Token効率 | 高 | 中間 | 低(会話オーバーヘッド) |

| 並列実行 | ネイティブサポート | サポート | サポート |

| 永続化 | 多バックエンド | 有限 | 有限 |

| ドキュメント品質 | 詳細 | 平均 | 平均 |

学習曲線:CrewAI最友好、ロール定義で完了。LangGraphはStateGraph、Reducer、Checkpointer概念理解必要、学習期間長。

制御力:LangGraph勝利。各ノード入出力、条件分岐、並列実行を精密制御可能。CrewAIとAutoGenオーケストレーションロジックがカプセル化、問題発生時原因究明困難。

Token効率:AutoGen会話メカニズムでToken消費高。Agent間メッセージ転送がコンテキストウィンドウ占有。LangGraph状態駆動モードが効率的—状態は必要情報のみ保存、無限膨張なし。

3.3 選択決定フレームワーク

選択に迷う場合、こう判断:

CrewAIを選ぶ、もし:

- 高速プロトタイプ、デモ効果

- チームAgent開発経験有限

- タスクフロー相対固定、複雑条件分岐不要

- プロジェクト期間短、デプロイ優先

LangGraphを選ぶ、もし:

- 本番級システム構築

- フローと状態の精密制御必要

- 複雑条件分岐、並列実行要求あり

- 長期維持、イテレーション

AutoGenを選ぶ、もし:

- タスクが多Agent交渉、議論必要

- 既存LLMクォータあり、Token消費問題なし

- 研究性プロジェクト、Agent協業パターン探索

推奨:確信ない場合、まずLangGraphから学習。概念がより基礎、理解後CrewAIとAutoGen理解容易。加えてLangGraphドキュメントとコミュニティサポートは現在3者中最良。

Observabilityと本番デプロイ実践

Agent本番後、新問題に直面:黒箱として動作。どのノードで停止、なぜ奇妙結果を出力、Token消費正常か不明。Observabilityツールはこれら問題解決用。

4.1 LangSmith統合

LangSmithはLangChain公式Observabilityプラットフォーム。毎回呼び出し追跡、Agent実行パス可視化、出力品質評価。

import os

# 環境変数設定(起動時1回設定)

os.environ["LANGSMITH_API_KEY"] = "your-api-key"

os.environ["LANGSMITH_TRACING"] = "true"

os.environ["LANGSMITH_PROJECT"] = "my-agent-project"

# 以降毎回invoke自動レポート

result = app.invoke({"messages": [...]})

# LangSmithコンソールで確認:

# - 完全呼び出しチェーン

# - 各ノード入出力

# - Token消費詳細

# - 実行時間分布LangSmith trace機能はAgentデバッグ時最使用。ある時ユーザーからAgentが偶に無関係内容を出力とフィードバック、LangSmithでtrace記録を調べ、ある検索ノードが誤結果を返すを発見。原因究明10分以内、修正迅速—フィルタ条件追加で解決。

費用面、LangSmith無料枠あり(月5000回trace)、小規模プロジェクト十分。チーム版$39/月+、多人数協業適用。

4.2 Langfuseオープンソース代替

プロジェクトがデータプライバシー敏感、またはObservabilityデータを自己管理したい場合、Langfuseはオープンソース代替案。

# インストール

# pip install langfuse

from langfuse.langchain import CallbackHandler

# ハンドラー初期化

langfuse_handler = CallbackHandler(

public_key="pk-xxx",

secret_key="sk-xxx",

host="https://cloud.langfuse.com" # または自己ホストアドレス

)

# invoke注入

result = app.invoke(

{"messages": [...]},

config={"callbacks": [langfuse_handler]}

)

# Langfuse記録:

# - promptとcompletion

# - モデルパラメータ

# - Token使用量

# - 実行時間Langfuseは自己ホストサポート、Docker一撃デプロイ可能。機能はLangSmithより少ないが、核心trace、スコアリング、データセット管理あり。あるプロジェクトでコンプライアンス要件のため第三者データ送信不可、Langfuse自己ホスト版を使用、私有Kubernetesクラスタで運用。

機能比較:

| 機能 | LangSmith | Langfuse |

|---|---|---|

| Trace追跡 | サポート | サポート |

| 可視化 | 強 | 中間 |

| 自己ホスト | サポートなし | サポート |

| 価格 | $0-$39+/月 | オープンソース無料 |

| データセット管理 | サポート | サポート |

| スコアリングシステム | サポート | サポート |

4.3 カスタムMetrics

既存Observabilityプラットフォーム以外、自分で埋め込んで指標収集も可能。

状態遷移追跡:各ノード入退時間記録、レイテンシー分布計算。

import time

from datetime import datetime

# カスタムノードラッパー

def timed_node(node_func):

def wrapper(state):

start = time.time()

print(f"[{datetime.now()}] Entering {node_func.__name__}")

result = node_func(state)

elapsed = time.time() - start

print(f"[{datetime.now()}] Exiting {node_func.__name__}, took {elapsed:.2f}s")

return result

return wrapper

# 使用

@timed_node

def my_research_node(state):

# ノードロジック

return state決定パス可視化:Agent通過ノードシーケンス記録、共通パス分析。

# 状態にパスフィールド追加

class TrackedState(MessagesState):

visited_nodes: list = []

# 各ノード実行後記録追加

def track_visit(state, node_name):

state["visited_nodes"].append({

"node": node_name,

"timestamp": datetime.now().isoformat()

})

return stateこれらカスタムmetricsは自分の監視システム(Prometheus、Grafana)にレポート、ビジネス指標と一緒に分析。ある時夕ピーク時Agent応答遅延を発見、カスタムmetricsで外部API呼び出しタイムアウトを原因究明。リトライメカニズムとサーキットブレーカー追加後、p99レイテンシー15秒から3秒に低下。

2026 AgentエンジニアリングトレンドとLangGraph進化

技術変化迅速ですが、いくつかのトレンドは事前に知る価値があります。

5.1 LangChain State of Agent Engineeringレポート核心発見

LangChainは2026年初めにState of Agent Engineeringレポート発表、数百本番級Agentシステム分析に基づく。印象に残った3つの発見:

発見1:グラフアーキテクチャ主流化

70%以上の本番Agentが何らかのグラフ構造(DAGまたは状態マシン)採用、単純線形Chainではなく。理由は実用的:実際のビジネスプロセスは一直線終点まで進む稀。ユーザー随时中断、説明要求、トピック切替可能—グラフ構造がこれら複雑性をより良く処理。

発見2:Human-in-the-loop標準化

60%のAgentシステムが人工介入点追加。Agent全自動実行ではなく、重要決定点で停止、人間確認後継続。LangGraph interrupt API設計:

# 重要ノードで停止、人工レビュー待機

graph.add_node("human_review", interrupt=True)

# レビュー通過後継続

app.update_state(config, {"approved": True})

result = app.invoke(None, config) # 中断点から継続実行このパターンは金融、医療高リスクシナリオで特に重要—Agent自動振込または処方箋書き不可、人間把关必要。

発見3:Observabilityツール成熟

レポートで1データ:Observabilityツール装備Agent、平均デバッグ時間60%短縮。私の経験と一致—traceなし、Agentデバッグは暗闇摸索。

5.2 LangGraph 2026新機能

LangGraphは2026年いくつか重要更新:

Pydantic v3状態定義標準化

Pydantic v3性能はv2より5-10倍向上、検証高速。LangGraph公式は新プロジェクト全てPydantic BaseModel状態定義推奨。

Subgraphモジュラー化

複雑Agentを複数Subgraphに分割、各Subgraphは独立状態マシン、単独テスト、再利用可能。

# サブグラフ:独立検索Agent

research_subgraph = StateGraph(ResearchState)

research_subgraph.add_node("search", search_node)

research_subgraph.add_node("summarize", summarize_node)

research_subgraph.compile()

# メイングラフ:サブグラフ呼び出し

main_graph = StateGraph(MainState)

main_graph.add_node("research", research_subgraph)

main_graph.add_node("write", write_node)この機能は大型プロジェクト有用—異なるチームが各々Subgraph開発、最後に組立。

Deep Agents:プランニング + サブAgent + ファイルシステム

LangGraphが「Deep Agents」概念導入:1主Agentプランニング担当、複数サブAgent呼び出しで具体タスク実行、ファイルシステム操作可能。Agentがより複雑ワークフロー処理、例「このPDF分析、レポート生成、指定ディレクトリ保存」。

5.3 未来展望

Agent Governance進化

Agent本番環境応用進展、ガバナンス問題重要性増:誰がAgent監督?決定失敗時責任追及方法?コンプライアンス確保?LangChainがAgentOps概念推進、DevOps類似、Agentライフサイクル管理対象。

マルチモーダルAgentサポート

現在Agent主にテキスト処理。未来はより画像、音声、動画結合。LangGraph既にマルチモーダルメッセージ型サポート、完全クロスモーダルワークフロー探索中。

これら予測全部実現するか確信ありませんが、1点確実:Agentエンジニアリングまだ初期段階、ベストプラクティス毎日進化。学習継続、公式ドキュメントとコミュニティ議論多読、変化追従唯一方法。

まとめ

この記事はLangGraph状態管理いくつか核心次元カバー:

- StateGraph構築:グラフ構造 + 状態駆動はAgent開発基礎パターン

- Reducerパターン:並列実行状態マージ核心メカニズム

- 永続化選択:MemorySaver開発用、PostgresSaver本番用

- フレームワーク比較:LangGraph最強制御力、CrewAI最速スタート、AutoGen協業シナリオ適用

- Observability:LangSmithまたはLangfuse、1つ選択、必須

いくつかアクション提案:

- 既存Agentプロジェクト確認。MemorySaver使用の場合、即PostgresSaver移行計画。

- LangChain State of Agent Engineeringレポート一読、業界トレンド理解。

- AgentにObservability追加—LangSmithまたは自己ホストLangfuse、まず実行。

- Agent開発初心者の場合、本シリーズAgent記憶システム設計とAI Agentアーキテクチャ設計参照、完全技術スタック構築。

Agentエンジニアリングまだ急速進化、今日ベストプラクティスは来年陳腐化可能。でも基礎原理—状態管理、永続化、可観測性—マスターで、新ツールより良く理解応用可能。

FAQ

LangGraph StateGraphと普通のGraphの違いは?

カスタムReducer関数はいつ必要?

本番環境はどのCheckpointer選択?

LangGraph、CrewAI、AutoGenどのフレームワーク選択?

• LangGraph:本番級システム、フローと状態精密制御必要

• CrewAI:高速プロトタイプ、チーム経験有限、プロジェクト期間短

• AutoGen:多Agent交渉議論シナリオ、研究プロジェクト

ObservabilityツールLangSmithまたはLangfuse?

10 min read · 公開日: 2026年4月24日 · 更新日: 2026年4月25日

AI 開発実践

検索からこのページに来た場合は、前後の記事もあわせて読むと同じテーマの理解がかなり早く深まります。

前の記事

AI エージェント開発実践:アーキテクチャ設計と実装ガイド

AI エージェントのアーキテクチャ設計を深く解説。ReAct、Plan-and-Execute、Multi-Agent の3つの主要パターンを比較し、5つのマルチエージェントオーケストレーションパターンを詳しく説明。Claude Agent SDK の実践的なコード例とともに、理論から実践まで網羅的に紹介します。

第 14 / 24 記事

次の記事

エージェントツール呼び出し実践:AIに外部APIとサービスを呼び出させる

Function CallingからMCPまで、ClaudeとOpenAIのツール呼び出しメカニズムを詳しく解説。完全なコード例とベストプラクティスで、API呼び出し機能を持つAIエージェントを構築

第 16 / 24 記事

関連記事

Workers AI 完全ガイド:毎日10,000回の無料LLM呼び出し、OpenAI比90%コスト削減

Workers AI 完全ガイド:毎日10,000回の無料LLM呼び出し、OpenAI比90%コスト削減

AIで10,000行のレガシーコードをリファクタリング:1ヶ月分の仕事を2週間で完了したリアルな振り返り

AIで10,000行のレガシーコードをリファクタリング:1ヶ月分の仕事を2週間で完了したリアルな振り返り

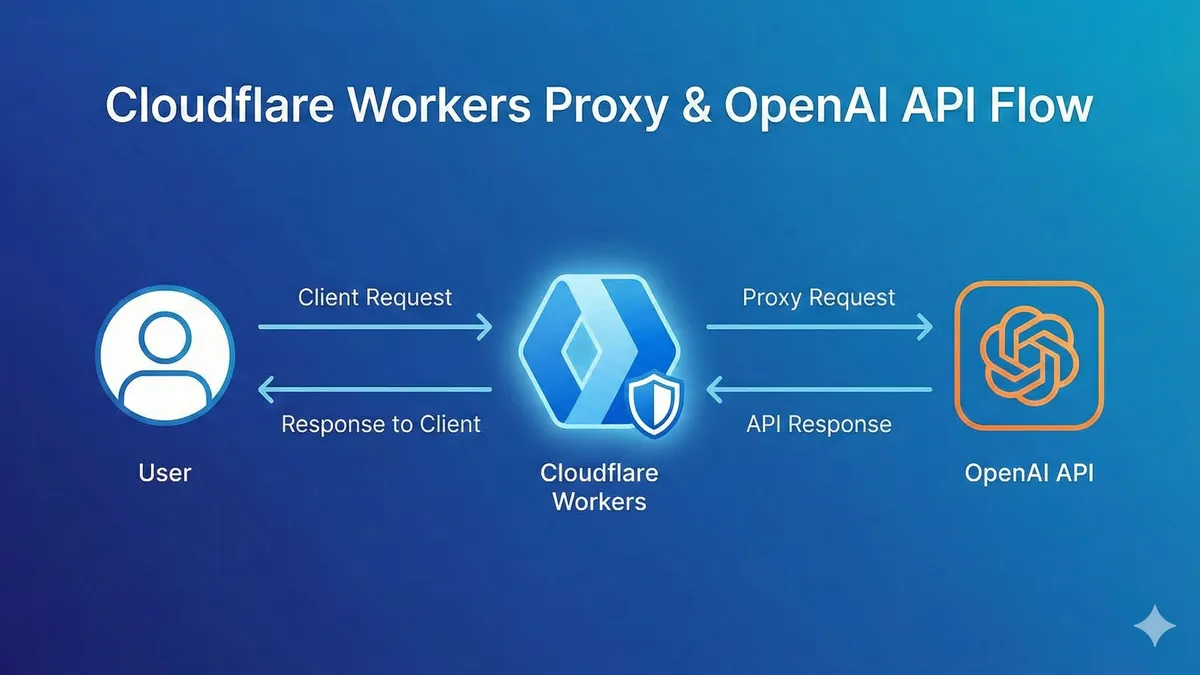

OpenAI APIがタイムアウトする?Workersで専用トンネルを構築、コストゼロで安定化

コメント

GitHubアカウントでログインしてコメントできます