LLM評価フレームワーク比較:LangSmith vs W&B vs MLflow

LangChainアプリを本番環境にデプロイしました。ユーザーから「たまに変な回答が返ってくる」というフィードバック。ログを確認しても、JSONの山が表示されるだけで、どこで問題が起きたのかさっぱりわかりません。Promptの設計が悪いのか?RAGの検索精度が低いのか?それともAgentのツール呼び出しが失敗したのか?

深夜2時、37回目のデバッグ出力を眺めながら気づきました。LLMアプリは従来のソフトウェアと違う。出力が不確定で、実行チェーンが10〜100ステップになることもある。ログを見るだけでは不十分で、各ステップを追跡し、各呼び出しを評価できるツールが必要です。

問題はこれです。LangSmith、Weights & Biases、MLflow、3つのツールが「LLM可観測性ソリューション」として存在します。どれを選ぶべきか?価格がこれほど違うのに、機能にはどんな違いがあるのか?

この記事で答えを出します。読み終えると、以下のことが明確になります:

- 3つのツールの核心的な位置づけと機能の違い

- チームの規模と予算に適したツール

- 技術スタックに基づく選択方法

- 実際のコスト—価格表の数字だけではありません

LangSmith、W&B、MLflow:位置づけが選択を決める

正直なところ、この3つのツールの根本的な違いは機能リストにはありません。「出自」と「DNA」にあります。この点を理解することは、機能を一つずつ比較するよりも重要です。

LangSmith:LangChainエコシステムのネイティブ監視プラットフォーム

LangSmithはLangChain社が自社開発したツールで、LangChain、LangGraphと同じ会社の製品です。これはどういうことか?LangChainでLLMアプリを開発しているなら、LangSmithはほぼゼロ設定で統合できます。SDKをインストールし、数行のコードを追加するだけです。

昨年、あるAgentプロジェクトで使用しました。当時、LangGraphで状態管理を行い、Agentの実行チェーンが非常に複雑でした。1つのリクエストで7〜8個のツールを呼び出し、途中に条件分岐もありました。LangSmithのtracing機能を使うと、実行グラフ全体が明確に表示されます。どのステップで止まったのか、どのツールがエラーを返したのか、一目でわかります。

LangSmithの核心機能:

- Dataset-based evaluations:テストデータセットをアップロードし、自動で評価を実行

- LLM-as-Judge:GPT-4などのLLMで出力品質を評価

- Tracing:各LLM呼び出し、ツール呼び出し、Chain実行を追跡

- Playground:オンラインでPromptをデバッグし、リアルタイムで効果を確認

一言でまとめると:LangChainやLangGraphを使用しているなら、LangSmithが最も手間のかからない選択です。統合に苦労する必要も、ドキュメントを研究する必要もなく、そのまま使えます。

Weights & Biases:ML実験追跡のベテラン

Weights & Biases(略称W&B)はLangSmithよりずっと歴史があります。2018年から機械学習実験追跡を行っており、主に研究・実験シーンを対象としています。ハイパーパラメータ調整、数十のモデルの性能比較、トレーニング曲線の記録—これらが強みです。

2024年、W&BはWeaveをリリースし、LLMアプリ追跡を専門にサポートしました。WeaveはLLM呼び出しチェーンを追跡し、トークンコストを計算し、異なるPromptの出力効果を比較できます。

しかし、正直なところ、W&Bには「新しい靴で古い道を歩く」感じがあります。LLM機能は後から追加されたもので、インターフェースには従来のML実験管理の痕跡が見えます。実験比較テーブル、トレーニング曲線グラフなど。これらは研究シーンには優れていますが、本番環境のLLM監視については、LangSmithほどスムーズではありません。

W&Bの核心機能:

- Weave LLM Tracing:LLM呼び出しチェーンを追跡

- 実験比較:数十の実験のパラメータと結果を横断比較

- コスト試算:トークン消費とAPIコストを計算

- チームコラボレーション:実験記録、注釈、共有

一言でまとめると:大量の実験比較とハイパーパラメータ調整を行うなら、W&Bはベテランのツールです。ただし本番監視の体験はLangSmithに劣ります。

MLflow:オープンソースMLOpsの柔軟な選択

MLflowは2018年にDatabricksがオープンソース化したツールで、「オープンソースの機械学習ライフサイクル管理プラットフォーム」として位置づけられています。実験追跡、モデル登録、モデルデプロイ、プロジェクトパッケージの4つのモジュールで構成されています。

MLflowの核心的な位置づけは:完全な制御が必要で、ベンダーロックインを避けたい場合です。オープンソースで無料、任意のサーバーに自己デプロイでき、データは完全に自分で管理できます。

ただし、MLflowのLLMサポートは比較的弱いです。mlflow.evaluate()インターフェースがあり、50以上の評価指標が組み込まれていますが、主に従来のMLモデルを対象としています。LLM特有の機能—マルチターン会話評価、Agent実行追跡など—はLangSmithやW&Bほど充実していません。

友人が金融会社でLLMプロジェクトに取り組んでいます。コンプライアンス要件が厳しく、データを内部ネットワーク外に出せません。彼らはMLflowを選択し、自社でデータセンターに構築しました。データは完全に管理できます。代償は運用コストが高いこと—サーバー、データベース、ストレージのメンテナンス、アップグレード、バックアップを自分で処理する必要があります。

MLflowの核心機能:

- 実験追跡:パラメータ、指標、モデルファイルを記録

- モデル登録:バージョン管理、モデルパッケージ

- モデルデプロイ:複数のデプロイ方法をサポート

- 50以上の組み込み評価指標:従来ML + 一部LLM指標

一言でまとめると:オープンソースと完全な制御が必要なら、MLflowは無料ですが、LLM機能は弱く、自分で補完する必要があります。

追跡だけではない:評価、デバッグ、デプロイ能力の比較

位置づけを見ただけでは不十分です。実際の作業でどれが使いやすいかを知る必要があります。3つの観点から比較します:追跡能力、評価能力、本番デプロイ能力。

追跡能力:実行チェーンを明確に説明できるか

LLMアプリで最も頭を悩ませるのは実行チェーンが長いことです。1つのAgent呼び出しに、Prompt構築 → LLM呼び出し → ツール実行 → 結果解析 → 再度LLM呼び出しが含まれることがあります。途中のどのステップで問題が起きても、最終出力に影響します。

| 次元 | LangSmith | W&B Weave | MLflow |

|---|---|---|---|

| LLMネイティブTracing | ✅ ネイティブサポート、LLM専用設計 | ✅ サポート、ただし従来実験向け | ⚠️ 汎用追跡、LLMサポート弱 |

| Agent実行グラフ | ✅ Agentフロー全体を可視化 | ⚠️ 基本追跡はサポート、グラフ化弱 | ❌ 非サポート |

| マルチターン会話追跡 | ✅ 各ターンを完全記録 | ✅ サポート | ⚠️ カスタマイズ必要 |

| ツール呼び出し追跡 | ✅ 各ツール呼び出しを自動記録 | ✅ サポート | ❌ 非サポート |

| 実行時間分析 | ✅ 各ステップの所要時間を統計 | ✅ サポート | ✅ サポート |

結局のところ、LangSmithは追跡においてプロフェッショナルです。LLMアプリ専用に設計され、Agent実行グラフ、ツール呼び出し追跡などがネイティブでサポートされています。W&B Weaveも追跡できますが、体験は「従来の実験管理にLLMモジュールを追加した」感じです。MLflowはさらに弱く、主に従来MLを対象としており、LLMの特殊なニーズは基本的に自分でコードを書いて適応する必要があります。

例を挙げます。昨年、RAG Agentをデバッグしていました。検索結果が時々不適切でした。LangSmithのtracingを使うと、問題はEmbeddingモデルにあることがわかりました。あるクエリのベクトル距離計算が誤っていて、召回されたドキュメントが完全に間違っていました。ログファイルでこれを確認しようとしたら、数百行のJSONを確認する必要があり、まったくわかりません。

評価能力:出力の良し悪しを判断できるか

追跡は「何が起きたかを知る」ことで、評価は「結果が良いかどうかを知る」ことです。LLM出力の不確定性により、評価が特に重要になります。

| 次元 | LangSmith | W&B Weave | MLflow |

|---|---|---|---|

| LLM-as-Judge | ✅ ネイティブサポート、複数モデル選択可能 | ⚠️ 設定必要 | ⚠️ カスタマイズ必要 |

| Dataset Management | ✅ データセットをアップロードし、一括評価 | ✅ サポート | ✅ サポート |

| マルチターン会話評価 | ✅ 会話シーン専用 | ⚠️ カスタマイズ必要 | ❌ 非サポート |

| 出力比較 | ✅ 複数バージョンの出力比較 | ✅ 強み、横断比較 | ⚠️ 手動設定必要 |

| 組み込み評価指標 | 10+ LLM専用指標 | 5-10 LLM関連指標 | 50+ 従来ML指標 |

LangSmithのLLM-as-Judgeは非常に使いやすいです。GPT-4やClaudeでモデル出力の品質を評価できます。「回答は正確か」「有害か」「簡潔か」など。これらの評価基準はカスタマイズでき、テンプレートとして保存・再利用も可能です。

W&Bの出力比較は強みです。20種類の異なるPromptの効果を比較する場合、W&Bのテーブルビューは非常に直感的です。横に各Promptの出力を見て、縦に評価指標を見られます。これはW&Bが従来のML実験管理から継承した利点です。

MLflowは組み込み指標が最も多い—50以上あります。ただし、これらの指標は主に従来のMLモデル(精度、F1、AUCなど)を対象としています。LLM専用の指標(意味的類似度、有害性検出など)は自分でコードを書いて実装する必要があります。

本番デプロイ能力:本番運用に付き合えるか

研究段階と本番運用では、ニーズが異なります。研究段階は「実験比較」が中心、本番運用は「監視・アラート」が中心です。

| 次元 | LangSmith | W&B Weave | MLflow |

|---|---|---|---|

| 監視アラート | ✅ エラー率、遅延アラートをサポート | ⚠️ 主に実験向け、本番監視は弱 | ⚠️ Grafanaとの組み合わせ必要 |

| A/Bテスト | ✅ 異なるバージョンの比較をサポート | ⚠️ 実験比較で、本番A/Bではない | ❌ 非サポート |

| 統合難易度 | ✅ LangChainはゼロ設定 | ⚠️ 手動統合必要 | ⚠️ 自己デプロイ必要 |

| 本番安定性 | ✅ クラウドサービス、高可用性 | ✅ クラウドサービス | ⚠️ 自己運用 |

LangSmithは本番デプロイにおいて最も体験が良いです。クラウドサービスなので、サーバーダウンやデータバックアップを心配する必要がありません。監視アラート、A/Bテスト、エラー追跡、一連のフローがスムーズです。

W&Bは主に研究段階を対象としています。実験比較機能は優れていますが、本番監視—リアルタイムアラート、エラー追跡など—はLangSmithほど充実していません。

MLflowは自分で運用する必要があります。サーバー、データベース、バックアップ、アップグレードを管理する必要があることを意味します。メリットは完全な自律管理、デメリットは運用コストが高いことです。本番環境ではMLflow + Grafanaの組み合わせを使用できます:MLflowが実験を記録し、Grafanaが監視アラートを行います。

価格は表面上、真のTCOこそ意思決定の鍵

多くの人は価格表を見て、MLflowは無料、LangSmithは有料だからMLflowを選びます。この考えは単純すぎます。真のコスト(TCO)は価格表の数字だけではありません。運用人件費、統合コスト、機会コストも含まれます。

価格比較表

| ツール | 価格モデル | 料枠 | 典型的な月額コスト(5人チーム) |

|---|---|---|---|

| LangSmith | Seat + Traces課金 | 5,000 traces/月無料 | Plus版:$39/seat、小規模チーム約$120-200/月 |

| W&B | 多層価格:Free/Team/Enterprise | 個人無料、チーム有料 | Team版約$50/seat、中規模チーム$500+/月 |

| MLflow | 完全オープンソース無料 | 無制限 | インフラコスト:$100-300/月(サーバー + ストレージ) |

LangSmithの価格は比較的明確です。無料版は月5,000 tracesで、個人開発者に十分です。Plus版は$39/席で、5人チームなら月約$120-200(traces使用量による)。Enterprise版は営業に連絡する必要があり、価格はカスタムです。

W&Bの価格は比較的複雑です。個人版は無料、Team版は約$50/席、Enterprise版は価格交渉が必要です。また、W&Bの課金は席だけでなく、実験ストレージ量、データストレージ量も含まれます。中規模チーム(10-20人)の月額コストは簡単に$500を超えます。

MLflowは表面上無料ですが、自分でデプロイする必要があります。サーバー、データベース、ストレージ、帯域幅—これらすべてにお金がかかります。簡単な見積もり:クラウドサーバー1台(2コア4GB)月額$50-100、ストレージ(100GB)$20-50、帯域幅トラフィック$30-50。合計$100-200/月。高可用性(複数サーバー + ロードバランサー)が必要な場合、コストは倍になります。

隠れたコスト:予想外の部分

価格表だけ見ると、MLflowが最も経済的に見えるかもしれません。しかし、いくつかの隠れたコストがあります:

MLflowの運用コスト:サーバーのメンテナンス、ソフトウェアのアップグレード、バックアップ、障害対応—これらすべてに人件費がかかります。チームに専任の運用エンジニアがいない場合、開発者がMLflowに時間を費やすことになります。時間もコストです。開発者の月給が20Kの場合、毎週4時間MLflowをメンテナンスすると、月額コストは約2Kになります。これはまだ障害対応の時間を含んでいません。

商用ツールが無料枠を超えた後の限界コスト:LangSmithは5,000 traces無料ですが、アプリが毎日500回LLMを呼び出すと、月15,000 tracesになり、無料枠を超えます。Plus版はtraces課金で、超過分に追加コストがかかります。これを事前に見積もる必要があります。

統合コスト:LangSmithとLangChainの統合は非常に簡単ですが、技術スタックがLlamaIndexや純粋なPythonでOpenAI APIを呼び出す場合、統合難易度は上がります。W&BとMLflowの統合は両方ともコードを書く必要があり、ゼロ設定ではありません。

真のコスト計算例

5人チーム、月10,000 tracesと仮定:

| ツール | 価格コスト | 運用コスト | 統合コスト(一回限り) | 月額真のコスト |

|---|---|---|---|---|

| LangSmith Plus | $200 | $0(クラウドサービス) | $0(ゼロ設定) | $200 |

| W&B Team | $250 | $0(クラウドサービス) | $500(2日間統合) | $250 + 一回限り$500 |

| MLflow自構築 | $0 | $150(サーバー) + $400(運用人件費) | $1,000(3日間統合デプロイ) | $550 + 一回限り$1,000 |

こう計算すると、MLflowは必ずしも経済的ではありません。チームの運用能力が高く、既存のインフラがある場合、MLflowは経済的です。ただし、チームが開発に集中し、運用に時間をかけたくない場合、商用ツール(LangSmithまたはW&B)の方が良いかもしれません。

重要な質問:チームの時間はいくらの価値があるか?。開発者が1週間かけてMLflowをデプロイすることで、他に価値を生み出せるか?答えが「価値がない」なら、無料にこだわる必要はありません—有料ツールが良い選択かもしれません。

あなたの状況に合わせて、こう選ぶ

これだけ話しましたが、結局どれを選ぶべきか?決定フローを提示します。順番に判断してください:

決定フロー

ステップ1:LangChainまたはLangGraphを使用していますか?

- はい → LangSmithを直接選択。ゼロ設定統合、手間いらず。

- いいえ → ステップ2へ。

ステップ2:完全なオープンソース / ベンダーロックイン回避が必要ですか?

- はい → MLflow + Langfuseの組み合わせを選択。MLflowで実験追跡、Langfuseで本番監視。両方ともオープンソースで、データは完全に管理。

- いいえ → ステップ3へ。

ステップ3:主な作業シーンは何ですか?

- 研究段階、大量の実験比較 → W&B Weaveを選択。実験比較機能は強み、ハイパーパラメータ調整もスムーズ。

- 本番環境、監視アラートが必要 → LangSmithまたはLangfuseを選択。LangSmithはクラウドサービス、Langfuseはオープンソースで自己構築可能。

ステップ4:チーム規模と予算は?

- 小規模チーム(under 5人)、予算限定 → LangSmith無料版(5,000 tracesで十分)またはMLflow自構築。

- 中規模チーム(5-20人)、ある程度の予算 → LangSmith PlusまたはW&B Teams、月額$200-500。

- 大規模チーム(over 20人)、予算十分 → Enterprise版(LangSmithまたはW&B)、または高可用MLflow + Grafanaの組み合わせを自構築。

推奨組み合わせまとめ

| シーン | 推奨組み合わせ | 理由 |

|---|---|---|

| LangChainユーザー | LangSmith | ゼロ設定、ネイティブ統合、最も手間いらず |

| 研究実験中心 | W&B Weave | 実験比較が強み、ハイパーパラメータ調整がスムーズ |

| オープンソース管理必要 | MLflow + Langfuse | データ自律、コスト管理可能、LLM能力を補完 |

| 小規模チーム予算限定 | LangSmith無料版 | 5,000 tracesで十分、試してから課金 |

| 大企業コンプライアンス要件 | MLflow自構築 + Grafana | データは内部ネットワーク外に出ない、完全自律管理 |

正直なところ、「完璧なツール」はありません。各ツールにはトレードオフがあります:LangSmithは便利だが有料、MLflowは無料だが手間がかかる、W&Bは研究に強いが本番は弱い。重要なのは、技術スタック、予算、チームの状況に基づいて選択すること—他人が使っているからといって真似するのではなく。

結論

LLMアプリの監視と評価は「あれば良い」ではなく、「本番に必須」です。監視がなければ、アプリが本番で何をしているのかわかりません。評価がなければ、出力品質が基準を満たしているか判断できません。

LangSmith、W&B、MLflowにはそれぞれトレードオフがあります。重要なのは技術スタック、予算、ニーズを見ることです:

- LangSmithはLangChainユーザーの最初の選択—ゼロ設定、深い統合、機能充実。LangChainやLangGraphを使用しているなら、これを選んでください。

- MLflow + Langfuseはオープンソースと完全な制御が必要なチームの選択—無料、自律、ただし運用に時間を費やす必要があります。

- W&B Weaveは大量の実験比較とハイパーパラメータ調整の研究シーンに適しています—従来の強みは依然として存在しますが、本番監視体験はLangSmithに劣ります。

最後にアドバイス:価格表だけでなく、真のTCOを見てください。MLflowは無料ですが、運用コストがかかります。LangSmithは有料ですが、開発・デバッグ時間を節約します。ツールを選ぶことは機能を選ぶことだけでなく、ROIを選ぶこと—チームの時間はいくらの価値があるか?この質問は「どのツールがより安か」よりも重要です。

現在どのツールを使用していますか?どんな問題に直面していますか?コメント欄で選択経験をシェアしてください。

FAQ

LangSmith無料版の5,000 tracesで十分ですか?

MLflow自構築の運用コストはどのくらい?

LangChainを使用せずにLangSmithを使えますか?

W&B WeaveとLangSmithのLLM追跡の違いは?

本番環境ではどれが推奨されますか?

既存の監視ソリューションから移行するには?

10 min read · 公開日: 2026年4月28日 · 更新日: 2026年4月29日

AI 開発実践

検索からこのページに来た場合は、前後の記事もあわせて読むと同じテーマの理解がかなり早く深まります。

前の記事

RAG + Agent:次世代 AI アプリケーションアーキテクチャ

従来の RAG から Agentic RAG へのアーキテクチャ進化を解説。10種類の RAG パターン、フレームワーク選定、エンタープライズ実装ロードマップ、スマートカスタマーサポートの実践事例を詳しく紹介します

第 18 / 28 記事

次の記事

Computer-Use Agent:AIにあなたのPCを操作させる

Claude Computer Use 技術を原理から実践まで完全ガイド。Dockerデプロイ、コード例、競合分析、セキュリティベストプラクティスを含む、AIデスクトップ自動化の最前線を解説します

第 20 / 28 記事

関連記事

Workers AI 完全ガイド:毎日10,000回の無料LLM呼び出し、OpenAI比90%コスト削減

Workers AI 完全ガイド:毎日10,000回の無料LLM呼び出し、OpenAI比90%コスト削減

AIで10,000行のレガシーコードをリファクタリング:1ヶ月分の仕事を2週間で完了したリアルな振り返り

AIで10,000行のレガシーコードをリファクタリング:1ヶ月分の仕事を2週間で完了したリアルな振り返り

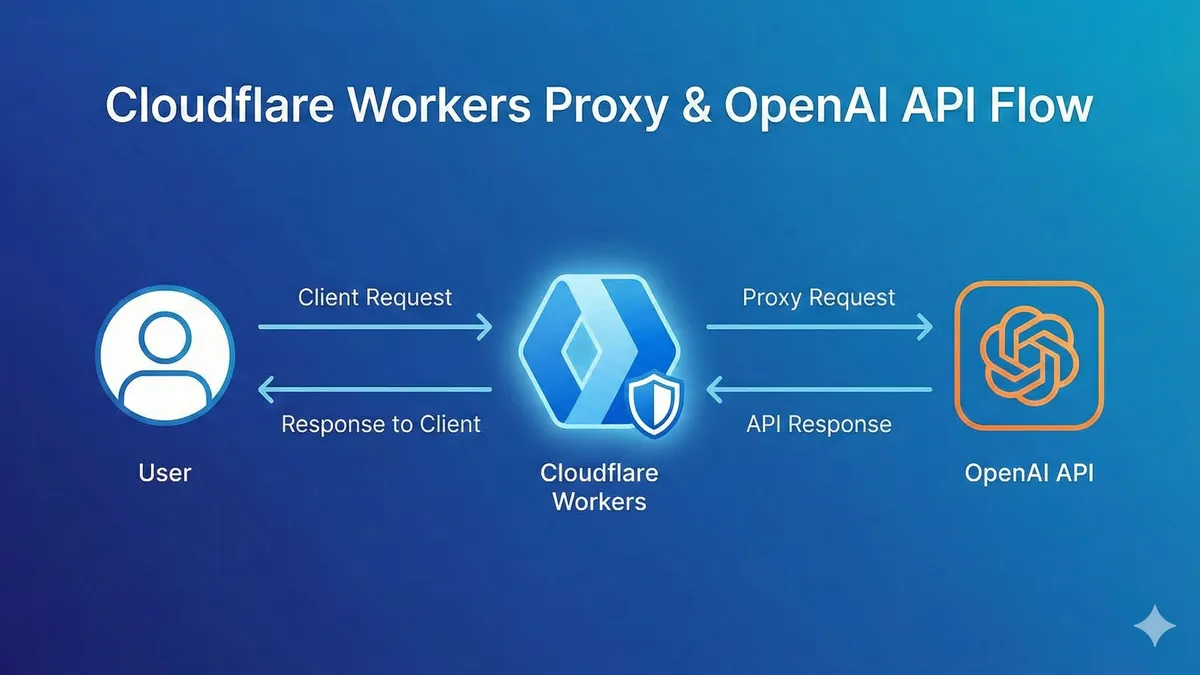

OpenAI APIがタイムアウトする?Workersで専用トンネルを構築、コストゼロで安定化

コメント

GitHubアカウントでログインしてコメントできます