自己進化 AI:2026 年にモデルが継続学習するための 4 つの手法

2026 年 3 月、Anthropic の CEO である Dario Amodei があるインタビューで発した言葉が、数日間ずっと頭から離れませんでした。「継続学習は 2026 年に解決されるでしょう。」

この発言は少し大胆に聞こえます。しかし、その直後に Google DeepMind も 2026 年を「継続学習の年」と予測し、イーロン・マスクに至っては「シンギュラリティはすでに到来した」と宣言しました。

正直に言うと、最初はこれらの予測に少しマーケティング的な要素が含まれていると感じていました。しかし、MiniMax の M2.7 モデルが内部で 100 回以上の自律最適化ループを実行し、性能が 30% 向上したのを見て、ようやく気づきました。これは本当に実現しようとしているのかもしれません。

本記事では、「自己進化 AI」とは一体何なのか、なぜ現在の LLM では「使いながら学習する」ことができないのか、そして 2026 年に真に注目すべき技術ソリューションについて解説します。3 つの主要な継続学習アプローチを分解し、特に MIT と ETH Zurich が年初に発表した自己蒸留技術(SDFT)を中心に解説します。さらに、MiniMax M2.7 の実際のケースを通じて、モデルがどのように「自己をアップグレードする」のかを見ていきます。

なぜ LLM は「使いながら学習」する必要があるのか?

長い間悩み続けてきた疑問があります。なぜ ChatGPT を 2 年間使っても、依然是として同じ ChatGPT のままなのか?

質問が増え、対話が増えても、モデルは賢くなりません。会話が終われば、すべてがリセットされます。次に会っても、やはり「工場出荷時設定」のままです。

これは人間とは全く異なります。私たちはコードを書き、プロジェクトを行い、失敗から学び、経験を蓄積します。3 年前の自分が書いたコードと今のコードを比べると、差は歴然です。しかし、LLM にはこの能力がありません。内部パラメータは凍結されており、訓練完了後は固定されています。

Dwarkesh Patel はインタビューで印象的な言葉を残しました。「LLM は人間のように時間とともに向上しない」。LLM の知識は常に訓練終了時点で止まっています。新しいことを学びたいなら、再訓練するか、ファインチューニングするしかありません。

しかし、ファインチューニングには大きな落とし穴があります。破滅的忘却です。

IBM が継続学習の紹介で使った素晴らしい比喩があります。スケートボードを学んでも、自転車の乗り方を忘れません。人間の脳には不思議な能力があり、新しいスキルを学ぶと同時に、古いスキルも保持できます。

ニューラルネットワークにはそれができません。

新しいデータでモデルをファインチューニングすると、新しいデータの分布に強く適合しようとし、その代償として古い知識が「押し出されます」。極端な例を挙げましょう。コアラという動物は、「木の葉」だけを食物として認識します。葉を地面に置いても、餓死しても食べないかもしれません。「学習した」パターンが硬直しすぎており、新しい環境に適応できないからです。

モデルの場合はさらに深刻です。Python 3.12 の新機能を学習させると、Python 3.8 の基礎構文を忘れてしまうかもしれません。実際の運用では致命的です。製品が反復され、コードベースが更新されても、新しいフレームワークを学習するたびに古いフレームワークの知識を捨てるわけにはいきません。

結局のところ、LLM の現状は「静的」です。百科事典のように、内容は豊富ですが更新できません。私たちが必要としているのは「動的」なものです。古い同僚のように、協力すればするほど息が合い、プロジェクトや習慣、技術スタックへの理解が深まるような存在です。

これが継続学習が解決すべき問題です。

継続学習の 3 つの技術流派

継続学習の分野は長年研究されており、アプローチは大きく 3 つに分類されます。厳密ではないですが、わかりやすい比喩を使って説明します。

Replay 方式:学びながら復習する。

この発想は最もシンプルです。新しいことを学ぶ際、古いデータも取り出して「再確認」します。試験前の勉強のように、新しい章の知識を確認しながら、以前の間違いも見直す感じです。

具体的には、古いタスクのサンプルの一部を保存し、新しいタスクのデータと混ぜて訓練します。欠点は明らかです。大量の古いデータを保存する必要があり、メモリとストレージのコストが巨大です。数百 GB の訓練データとなると、このソリューションのコストは高すぎます。

Regularization 方式:重要なパラメータに「保護フィルム」をかける。

この方法は賢いです。核心的なアイデアは、ニューラルネットワーク内のすべてのパラメータが同じ重要度ではないため、新しいタスクを学ぶ際、古いタスクに重要なパラメータを「ロック」するというものです。

最も有名なのは EWC(Elastic Weight Consolidation)で、2017 年に PNAS に掲載された論文です。原理は、各パラメータの古いタスクに対する重要度を計算し、重要なパラメータに制約を加え、更新時の変化幅を制限します。

比喩を使うと、英語を学ぶ際、文法規則はすでに脳に定着しており、フランス語の学習に干渉されにくいです。しかし、語彙がまだ蓄積段階にある場合、フランス語の学習で英語の単語を忘れることがあるかもしれません。EWC は「すでに定着している」パラメータを見つけ出し、保護します。

Architecture 方式:各タスクに専用モジュールを割り当てる。

この発想は、新しいことを学ぶと古いことに干渉するなら、いっそパラメータを共有させなければいい、というものです。新しいタスクを学ぶ際、モデルに新しいモジュールを追加し、そのタスク専用に処理させ、古いモジュールは変更しません。

LoRA(Low-Rank Adaptation)はこの発想の典型的な代表です。バックボーンネットワークのパラメータを凍結し、小型の低ランクアダプタのみを訓練します。各タスクにアダプタを割り当て、タスク切り替え時にアダプタも切り替えます。

Nature に掲載された研究でも、動的拡張アーキテクチャが忘却を大幅に減少させることが確認されています。ただし、この方法にも問題があります。タスクが増えるほどモジュールが増え、モデルはどんどん大きくなり、推論時のコストも上がっていきます。

正直に言うと、これら 3 つのアプローチにはそれぞれ長所と短所があり、完璧な解決策はありません。Replay は重すぎ、Regularization は完璧な重要度重みを計算できず、Architecture はモデルを肥大化させます。学界は長年取り組んできましたが、産業界で実際に導入されているものは多くありません。

今年になり、MIT と ETH Zurich が新しい発想を提案しました。モデルに「自分自身を教える」方法です。

SDFT — 自己蒸留でモデルが「自分自身を教える」

2026 年 1 月、MIT と ETH Zurich が論文を発表し、タイトルで主張を明確に示しました。『Self-Distillation Enables Continual Learning』(自己蒸留が継続学習を可能にする)。

この手法の核心的な発想には感嘆しました。外部データも、追加のモデルも必要なく、モデル自身に頼るだけです。

具体的にどうするのでしょうか?

ステップ 1:ICL を活用して「自己教師」信号を生成。

LLM には In-Context Learning(コンテキスト内学習)の能力があります。いくつかの例を与えれば、そのパターンを模倣できます。SDFT はこの能力を活用し、モデル自身に「答え」を生成させ、それを訓練データとして使用します。

比喩を使うと、コードのコメントを書くスタイルを学びたいが、「コメントスタイル」のデータセットがない場合。どうするか。モデルにまず自分でコメントを書かせ(現在の能力に基づいて)、そのコメントを「模範解答」として、自分自身を訓練するのです。

循環論法のように聞こえるかもしれません。しかし、ここで重要なポイントがあります。

ステップ 2:On-policy 学習、分布ミスマッチを回避。

従来の SFT(Supervised Fine-Tuning)には問題があります。訓練データの分布とモデルが実際に出力する分布が一致しません。モデルは「自分のスタイル」の答えを生成するかもしれませんが、訓練データは「専門家スタイル」の答えです。無理に専門家スタイルを学ばせると、逆に元の能力を損なう可能性があります。

SDFT は On-policy の方式を採用します。モデルに答えを生成させ、その答えで自分自身を訓練するため、分布は自然に一致します。「自分自身を教える」ことに相当し、無理に他人のスタイルを学んで自分の能力を失うことはありません。

論文のデータは非常に堅実です。14B パラメータのモデルで、SDFT を使用すると、従来の SFT より 7 ポイント向上しました。さらに重要なのは、順次学習の実験を行ったことです。モデルに複数のスキル(数学推論、コード生成、創作)を順次学習させた結果、モデルはこれらのスキルを蓄積でき、能力が低下しませんでした。

"Self-Distillation Enables Continual Learning"

これは従来のソリューションとは本質的に異なります。外部リソース(Replay)にも、人間が設計した制約(Regularization)にも、モジュールの分離(Architecture)にも頼らず、モデル自身の出力分布で反復最適化を行います。

この発想が面白いのは、「自分を傷つけない」学習方法を見つけた点だと思います。人間が本を読むようなものです。脳内の既存の知識を押し出すためではなく、既存の知識の上に、振り返りと内化を通じて、徐々に向上していくのです。

もちろん、SDFT も完璧な解決策ではありません。論文でも、非常に複雑なタスクシーケンスでは効果が低下することが認められていますし、On-policy 訓練の計算コストも小さくありません。しかし、少なくとも新しい方向を示しています。継続学習は必ずしも外部リソースに依存する必要はなく、モデル自身が自分の「先生」になれるのです。

LangChain の 3 層進化フレームワーク

2026 年 4 月、LangChain がブログ記事『Continual Learning for AI Agents』を公開し、非常に実践的価値のあるフレームワークを提案しました。3 層の進化です。

このフレームワークは、エージェントの「継続学習」を 3 つの層に分解し、モデルの重みだけを見るのではなく、システム全体の観点から進化を考えます。

第 1 層:Model Layer — モデルの重みを更新。

最も直接的な層です。SFT、RLHF、DPO などの方法で、モデルのパラメータを直接更新します。脳に「チップを交換する」ようなものです。

ただし、この層には問題があります。更新頻度が低く、コストが高いです。モデルに問題を 1 つ解決させるたびに再訓練するわけにはいきません。実際の運用では、この層の更新は通常「バージョン反復」という形で行われます。数ヶ月、あるいはそれ以上の間隔です。

第 2 層:Harness Layer — フレームワークコードを更新。

この層が最も面白いと感じました。Harness とは、モデルの外側を包むコードのことです。ツール呼び出しロジック、エラー処理、タスク計画、プロンプトテンプレートなどが含まれます。

LangChain が提案する「Meta-Harness」の概念は、エージェントに自分の Harness コードを変更させることです。例えば、エージェントがあるツール呼び出しフローで常に失敗することに気づいた場合、失敗の原因を分析し、コードロジックを変更し、次は同じミスをしないようにします。

モデルのパラメータを更新するより実用的です。コードの変更は速く、コストが低く、モデルの中核能力に影響しません。「使い方」を変えるのであって、「脳そのもの」を変えるのではありません。

OpenClaw プロジェクトの「dreaming」メカニズムが良い例です。エージェントがバックグラウンドで実行されているとき、自動的に記憶を統合し、自分の行動パターンを最適化します。「夢を見ている」ときに日中の問題を振り返るようなものです。

第 3 層:Context Layer — 記憶を更新。

この層は最もわかりやすいです。エージェントの記憶ストレージを更新します。会話履歴、プロジェクトドキュメント、ユーザー設定、タスク記録などが含まれます。

Deep Agents の設計では、記憶も階層化されています。ユーザーレベルの記憶(ある人が何を好むか)、組織レベルの記憶(あるチームの習慣)、グローバル記憶(一般的な知識)です。

この 3 層の関係は、一言で要約できます。Traces がすべての更新の核心。

Traces とは何か。エージェントの実行中に残す完全な記録です。入力、出力、ツール呼び出し、エラー情報、ユーザーフィードバックなどです。これらの Traces は、記憶更新の素材(Context Layer)であり、コード最適化の根拠(Harness Layer)であり、モデル訓練のデータソース(Model Layer)でもあります。

3 層フレームワークの価値は、「継続学習」を単なる技術問題から、システムエンジニアリングの問題に変えた点にあります。モデルのバージョン更新を待たなくても、エージェントを進化させることができます。Harness と Context を更新することで、エージェントは毎日進歩できるのです。

これが、開発者にとって、重みの更新だけを見るより、3 層フレームワークを理解する方が重要だと言える理由です。真の自己進化は、エージェントのライフサイクル全体で発生し、訓練段階だけではありません。

実践事例:MiniMax M2.7 がどのように「自己進化に深く関与」しているか

これまで理論を多く語ってきましたが、ここで実際の事例を見てみましょう。

MiniMax は 2026 年 3 月に M2.7 モデルを公開し、公式の紹介に印象的な言葉がありました。「自己進化に深く関与」。これはマーケティングのスローガンではありません。実際にモデルに 100 回以上の最適化ループを自律的に実行させたのです。

具体的にどう動いているのか? 4 つのステップのサイクルです。

1. 失敗を分析。

モデルがまずタスクを実行し、失敗したタスクを抽出して、なぜ失敗したかを分析します。プロンプトの書き方が間違っていたのか? ツール呼び出しに問題があったのか? それともコードロジックが間違っていたのか?

2. 変更を計画。

失敗分析に基づいて、モデル自体が改善案を提案します。例えば、「このツール呼び出しのパラメータ検証が厳密ではないため、チェックを追加すべき」とか、「この種のエラーを処理する際は、まず X 方案を試してから Y 方案を試すべき」といった具合です。

3. コードを修正。

モデルが自分のコードを変更します。モデルのパラメータではなく、エージェントの Harness 層のコード(ツール呼び出しロジック、エラー処理フローなど)を変更します。

4. 評価を実行。

変更後、評価セットを実行して、変更が効果的かどうかを確認します。効果があれば保持し、効果がなければロールバックします。

この 4 つのステップのサイクルを、M2.7 は 100 回以上実行しました。結果は驚異的です。内部評価セットで性能が 30% 向上しました。

外部ベンチマークテストのデータも素晴らしいです。

- SWE-Pro:56.22%。このベンチマークは、モデルに実際の GitHub issue を解決させるもので、難易度は Claude Opus に近いです(Opus-4.6 は約 55%)。

- MLE Bench Lite:66.6% の平均メダル獲得率。これは機械学習エンジニアリングのベンチマークで、モデルが Kaggle プロジェクトを完了する能力をテストします。Opus-4.6 に次ぐ結果です。

最も興味深いのは、このプロセスにおける「人間」の役割です。MiniMax の研究者によると、重要な決定にだけ介入すればいいそうです。ある変更を保持すべきかどうかを確認したり、大きな方向性でアドバイスを提供したりする程度です。残りの分析、計画、修正、評価は、すべてモデルが自律的に完了します。

これは従来の「人間がコードを書く → モデルがテストする → 人間がコードを修正する」というフローとは全く異なります。モデルは単なる受動的な「実行者」ではなく、積極的に問題を発見し、解決策を提案し、効果を検証する「参加者」になりました。

MiniMax 自身の表現を使えば、「モデルが初めて自己の進化に深く関与した」のです。

正直に言うと、この事例を見て、興奮と懸念の両方を感じました。興奮したのは、継続学習がついに実装された実例があり、効果も確かだったことです。懸念したのは、このフローの信頼性をどう保証するかです。モデルは「間違った方向にどんどん修正」してしまうのではないか? 100 回のサイクルのうち、どれだけがプラスで、どれだけが試行錯誤のコストなのか?

公式はこれらの詳細を公開していませんが、少なくとも M2.7 は一つのことを証明しました。自己進化は机上の空論ではなく、実際に動き、成果を出せるのです。

結論

2026 年の年明けから現在まで、継続学習というトピックの注目度は高まるばかりです。DeepMind は今年を「継続学習の年」と呼び、Anthropic は「2026 年に解決する」と言い、MiniMax は M2.7 の実践データを提示しました。

継続学習がすぐに普及するとは言えません。SDFT はまだ論文段階ですし、M2.7 の自己進化フローの詳細も完全には公開されていません。しかし、少なくとも方向性は明確です。モデルは永遠に静的な「工場出荷時設定」であってはならず、使いながら学習する必要があります。

開発者へのアドバイスとしては、「モデルの重み更新」だけを見ないでください。LangChain の 3 層フレームワークは、より実践的な視点を提供します。まず Harness 層と Context 層から始め、エージェントのツール呼び出しロジックや記憶管理で「継続的最適化」を実現できます。この 2 層は変更コストが低く、効果が早く、モデルの再訓練も不要です。

真に面白い未来は、3 層の連動です。モデルが Harness 層で行動を最適化し、Context 層で経験を蓄積し、タイミングが成熟したら、その経験データで重みを更新する。そして新しいサイクルが始まります。

これこそが「自己進化」のあるべき姿です。数ヶ月に一度の大きなバージョン更新ではなく、毎日進歩していくのです。

この分野に興味がある方は、SDFT の論文(arxiv 2601.19897)を読み、LangChain の 3 層フレームワークのブログを見て、MiniMax が今後 M2.7 の技術的詳細を公開するかどうかをフォローすることをお勧めします。継続学習はまだ急速に発展しており、2026 年は確実に重要な年になるでしょう。

FAQ

LLM の破滅的忘却とは何ですか?

SDFT 自己蒸留手法の核心的な利点は何ですか?

LangChain の 3 層進化フレームワークとは何ですか?

MiniMax M2.7 の自己進化プロセスはどのように動作しますか?

継続学習の 3 つの主要な手法にはそれぞれどのような長所と短所がありますか?

開発者はどのように継続学習を実践し始めるべきですか?

8 min read · 公開日: 2026年4月14日 · 更新日: 2026年5月26日

AI 開発実践

検索からこのページに来た場合は、前後の記事もあわせて読むと同じテーマの理解がかなり早く深まります。

前の記事

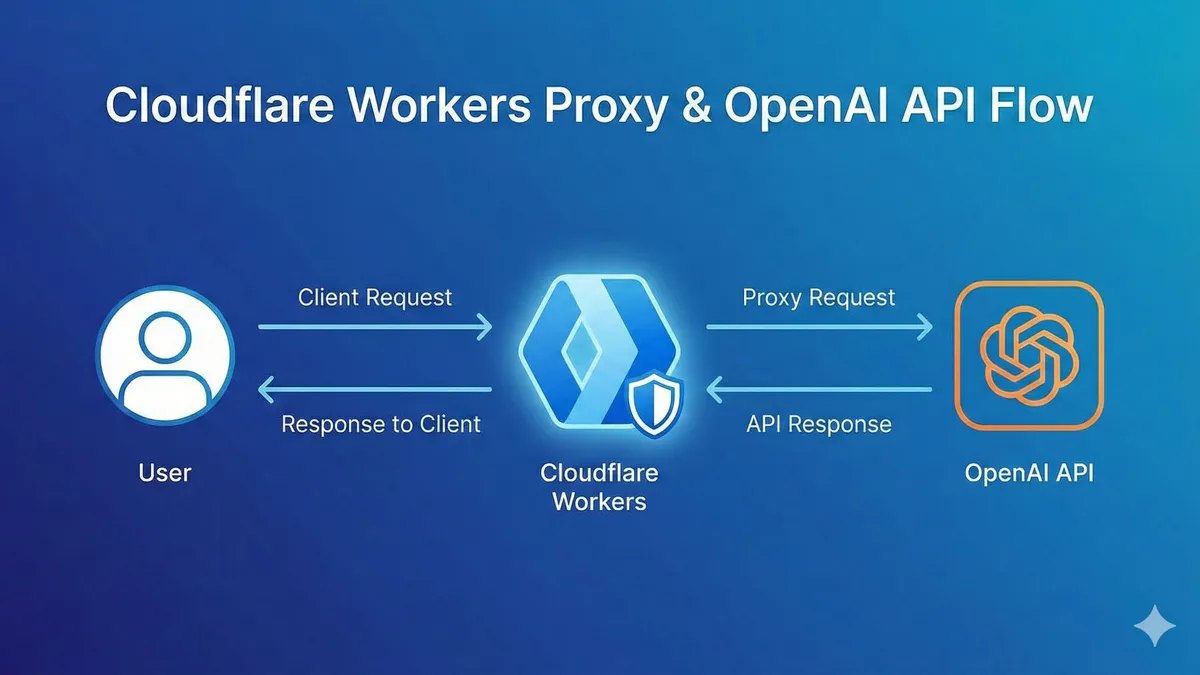

ベクトルデータベースは高すぎる?無料のVectorizeで30分で作るセマンティック検索

Cloudflare Vectorizeを使ったコストゼロからの入門ガイド。Pineconeより月50ドル安く、30分でセマンティック検索を実装する方法。完全なコードとトラブルシューティング付き。500万ベクトルまで無料。

第 6 / 40 記事

次の記事

プロンプトエンジニアリング実践編:テクニックからメソドロジーへ

散らばったテクニックから体系的メソドロジーへ。Chain-of-Thought、ReAct、DSPyなどの高度技術を深く解説。ClaudeとChatGPTの差別化ベストプラクティスを掌握し、評価可能・反復可能なプロンプトエンジニアリング体系を構築

第 8 / 40 記事

関連記事

Workers AI 完全ガイド:毎日10,000回の無料LLM呼び出し、OpenAI比90%コスト削減

Workers AI 完全ガイド:毎日10,000回の無料LLM呼び出し、OpenAI比90%コスト削減

AIで10,000行のレガシーコードをリファクタリング:1ヶ月分の仕事を2週間で完了したリアルな振り返り

AIで10,000行のレガシーコードをリファクタリング:1ヶ月分の仕事を2週間で完了したリアルな振り返り

OpenAI APIがタイムアウトする?Workersで専用トンネルを構築、コストゼロで安定化

コメント

GitHubアカウントでログインしてコメントできます