Prompt Engineering 模板库:12 种可复用的提示词设计模式

上周三下午,我花了四十分钟写了一个堪称完美的 Prompt,让 Claude 帮我把一堆乱七八糟的用户反馈整理成了结构清晰的改进建议。效果很惊艳。但三天后,当我需要做同样的任务时——对着空白的输入框,脑子一片空白。

那个”完美 Prompt”去哪了?

翻遍了 Notion、备忘录、聊天记录,愣是找不着。最后只能凭印象重写了一个,结果输出质量差了一大截。

说实话,这种事我遇到过不下十次。每次都是:灵光一现写了好 Prompt → 用完就忘 → 下次又从零开始 → 质量时好时坏。

直到我意识到一个挺关键的问题:Prompt 写得好不好,一半靠技巧,另一半靠”能不能复用”。

根据 aiengineerlab.in 2026 年的研究,区分”偶尔有效”和”持续可靠”的 Prompt,核心差异就四个字段。这四个字段组合好,能覆盖 80% 的日常工作场景。

这篇文章,我会分享一套经过验证的 Prompt 模板库建设方法,包括:

- 四字段结构:Role + Task + Constraints + Output Format

- 12 种 Prompt Patterns:按 Beginner/Intermediate/Advanced 分级

- 多模型适配表:Claude、GPT-4、DeepSeek 的差异化策略

- 模板迭代方法:如何把”还不错”的模板优化成”生产级”

- 5 个直接可用的模板:复制粘贴就能跑

第一章:Prompt 模板的四字段结构

在看具体的模板之前,先说一个挺基础但容易被忽略的事实:好的模板和差的模板,结构上差的就是那四个字段。

aiengineerlab.in 的研究指出,一个”可靠有效”的 Prompt,必须包含四个要素:Role(角色)、Task(任务)、Constraints(约束)、Output Format(输出格式)。

先看一个反例

帮我写一个代码审查的回复这种 Prompt 我以前写过无数次。结果呢?AI 给出的回复五花八门——有时候太客气,有时候太技术化,有时候干脆只给一句”代码写得不错”。

再看加了四字段之后的版本

## Role

你是一位有 10 年经验的后端工程师,擅长 Python 和分布式系统。

## Task

审查以下代码变更,指出潜在问题并提供改进建议。

## Constraints

- 关注点:性能、安全性、可维护性

- 语气:专业但友好,避免过于严苛

- 篇幅:控制在 200 字以内

- 必须指出至少一个改进点

## Output Format

请用以下格式输出:

### 问题列表

- [问题类型] 具体描述

### 改进建议

1. ...

2. ...

### 总体评价

(一句话总结)差别挺明显的,对吧。

四字段详解

Role(角色)——告诉 AI 它是谁。不是随便说个身份,而是设定一个有具体背景的”人设”。比如”有 10 年经验的后端工程师”就比”你是专家”具体得多。角色设定越具体,AI 的输出风格就越稳定。

Task(任务)——要 AI 干什么。这里有个小技巧:用动词开头。“审查代码变更”比”代码审查”更明确。“指出潜在问题并提供改进建议”又比”看看代码”清晰多了。

Constraints(约束)——这是最容易被忽略、但也最重要的字段。我见过太多 Prompt 死在这一步——没有约束,AI 就放飞自我。约束包括:关注领域(性能?安全?)、语气风格、篇幅限制、必须包含的元素。说白了,约束就是给 AI 划清边界。

Output Format(输出格式)——你希望结果长什么样。是要 JSON?Markdown?还是特定的章节结构?提前说清楚,能省掉大量后期整理的时间。

一张对比表

| 字段 | 反例 | 正例 | 效果差异 |

|---|---|---|---|

| Role | ”你是专家" | "10年经验后端工程师,擅长 Python” | 输出风格稳定 |

| Task | ”看看代码" | "审查代码变更,指出问题并提供建议” | 任务边界清晰 |

| Constraints | 无 | ”关注性能和安全,200字以内,至少一个改进点” | 输出可控 |

| Output Format | 无 | ”问题列表 + 改进建议 + 总体评价” | 无需二次整理 |

当你把这四个字段组合好,一个 Prompt 就从”碰运气”变成了”可复用”。这就是模板化的基础。

第二章:12 种可复用 Prompt Patterns 速查

best-ai.org 整理了一份挺实用的 Prompt Patterns 清单,按难度分了三级。我把这些模式按使用场景重新组织了一下,方便你快速找到适合的模式。

Beginner 级别(5 种)

1. Zero-Shot(零样本)

直接给任务,不给示例。适合简单、明确的任务。

## Task

{{任务描述}}

## Output Format

{{输出格式}}适用场景:写邮件摘要、翻译短文本、回答事实性问题。

2. Few-Shot(少样本)

给 2-3 个示例,让 AI 模仿。aiengineerlab.in 的测试显示,通常 2-3 个示例效果最佳,分类任务可以用 5-7 个。

## Task

{{任务描述}}

## Examples

示例 1:

输入:{{示例输入1}}

输出:{{示例输出1}}

示例 2:

输入:{{示例输入2}}

输出:{{示例输出2}}

## Now Process

输入:{{实际输入}}

输出:适用场景:文案风格模仿、分类任务、格式转换。

3. Persona(角色扮演)

设定 AI 的身份和背景。这是最常用的模式之一,和第一章的”Role”字段配合使用。

## Role

你是一位{{具体身份}},拥有{{具体背景}}。

## Style

你的说话风格是:{{风格描述}}

## Task

{{任务描述}}适用场景:代码审查、技术咨询、创意写作。

4. Output Format(输出格式化)

强制 AI 按特定格式输出。这个模式几乎可以和所有其他模式组合。

## Task

{{任务描述}}

## Output Format

请严格按以下格式输出:

{{格式模板}}

## Note

只输出格式化内容,不要额外解释。适用场景:生成 JSON、填报表、结构化文档。

5. Negative Prompting(否定约束)

告诉 AI “不要做什么”。有时候比正面约束更有效。

## Task

{{任务描述}}

## Do NOT

- 不要{{禁止项1}}

- 不要{{禁止项2}}

- 避免{{禁止项3}}适用场景:避免特定术语、排除敏感内容、控制输出风格。

Intermediate 级别(4 种)

6. Chain of Thought(思维链)

让 AI 展示推理过程。适合需要逻辑推理的任务。

## Task

{{任务描述}}

## Instructions

请一步步思考,先分析问题,再给出答案。

在最终答案前,展示你的推理过程。适用场景:数学问题、逻辑推理、复杂决策。

7. System Prompt(系统提示)

把角色的核心指令放在 System Prompt 里,保持对话一致性。这个在 Claude 和 GPT-4 里用得特别多。

## System

你是{{角色描述}}。

你的核心职责是{{职责描述}}。

你必须遵守以下规则:

1. {{规则1}}

2. {{规则2}}

## User

{{用户输入}}适用场景:AI Agent、聊天机器人、持续对话场景。

8. Iterative Refinement(迭代优化)

先让 AI 生成初稿,再让它自己修改。适合需要高质量的输出。

## Round 1

{{任务描述}}

生成初稿。

## Round 2

请审查上面的初稿,找出以下问题:

- 逻辑漏洞

- 表达不清

- 事实错误

## Round 3

根据审查结果,优化初稿并输出最终版本。适用场景:文章写作、代码生成、方案设计。

9. Constraint Stacking(约束叠加)

堆叠多个约束,让输出更加精准。生产环境里最常用的组合。

## Task

{{任务描述}}

## Constraints

- 约束 1:{{具体约束}}

- 约束 2:{{具体约束}}

- 约束 3:{{具体约束}}

- 约束 4:{{具体约束}}

## Output Format

{{格式要求}}适用场景:需要严格控制输出的生产任务。

Advanced 级别(3 种)

10. Self-Critique(自我审查)

让 AI 自己评估自己的输出质量。这个模式在高质量场景下特别有用。

## Task

{{任务描述}}

## Self-Critique

生成答案后,请评估:

1. 答案是否完整?

2. 是否有逻辑漏洞?

3. 是否符合所有约束?

如果有问题,请重新生成。

## Output Format

答案:

{{答案}}

自我评估:

{{评估}}适用场景:高风险输出、需要可靠性的任务。

11. Task Decomposition(任务分解)

把复杂任务拆成子任务。适合多步骤工作流。

## Complex Task

{{复杂任务描述}}

## Decomposition

请把这个任务拆分成多个子任务:

1. {{子任务1}}

2. {{子任务2}}

3. {{子任务3}}

## Execution

请依次完成每个子任务,并说明每步的结果。适用场景:项目管理、复杂问题分析、系统设计。

12. Meta-Prompting(元提示)

让 AI 帮你写 Prompt。当你不确定怎么表达时特别好用。

## Task

我需要完成以下任务:{{任务描述}}

## Request

请帮我写一个高质量的 Prompt,让另一个 AI 能顺利完成这个任务。

Prompt 需要包含:Role、Task、Constraints、Output Format。适用场景:Prompt 工程新手、复杂任务梳理。

组合使用的小建议

"组合 2-4 个 Pattern 效果最好。常见组合包括:Business Writing 用 Persona + Output Format + Constraint Stacking;Code Generation 用 Persona + Few-Shot + Negative Prompting;Research & Analysis 用 Chain of Thought + Self-Critique + Task Decomposition。"

第三章:多模型适配对比表

不同的 AI 模型,对 Prompt 的”理解方式”不太一样。一个在 Claude 上效果很好的 Prompt,放到 GPT-4 上可能就差点意思。

这一章,我整理了一份模型适配指南,帮你少踩坑。

Claude:XML 标签和契约式指令

Claude 有个特点:它特别喜欢结构化的东西。官方文档推荐用 XML 标签来组织 Prompt,效果比纯文本好不少。

<instructions>

审查以下代码变更,指出潜在问题。

</instructions>

<context>

你是一位有 10 年经验的后端工程师。

项目是一个 Python 微服务,使用 FastAPI 框架。

</context>

<constraints>

- 关注性能和安全性

- 语气专业但友好

- 控制在 200 字以内

</constraints>

<output_format>

### 问题列表

- [类型] 描述

### 改进建议

1. ...

</output_format>Claude 的另外两个优势:

- Extended Thinking:让 Claude 在输出前先”思考”,适合复杂推理任务

- 契约式指令:在开头说清楚”如果你遵守所有约束,输出 OK”,能提高约束遵守率

GPT-4:长约束列表和 JSON 输出

GPT-4 不太吃 XML 标签那一套。它更适应”列表式”的约束。而且 GPT-4 的 JSON 输出稳定性比 Claude 稍好一些。

## Task

审查以下代码变更。

## Constraints

1. 关注性能和安全性

2. 语气专业但友好

3. 控制在 200 字以内

4. 必须指出至少一个改进点

5. 使用中文输出

## Output Format

请输出 JSON 格式:

{

"issues": [...],

"suggestions": [...],

"summary": "..."

}GPT-4 的特点:

- 约束列表可以写到 10 条以上,模型仍能较好遵守

- Few-shot 模式效果比 Claude 稍好

- 代码生成和解释能力比较均衡

DeepSeek 和 Qwen:国产大模型的适配

国产模型这两年进步很快,但也有自己的特点:

DeepSeek:

- 中文理解能力强,但结构化指令的遵守度稍弱

- 建议把约束写得更明确、更短

- Few-shot 示例数量可以减少到 1-2 个

Qwen(通义千问):

- 比较吃”角色设定”,Persona 模式效果好

- 长文本处理能力强,适合文档类任务

- 约束建议用”禁止”而非”避免”,正向指令比负向更有效

Llama(小参数版本):需要更直白的指令

对于 Llama 7B、13B 这类小参数模型,Prompt 得写得更”傻瓜”一些。

## Task

审查代码变更。

## Output Format

Return ONLY valid JSON. No explanation. No markdown.

{

"issues": [],

"suggestions": []

}关键点:必须显式说”只输出 JSON,不要解释”,否则小模型会多嘴多舌。

一张适配速查表

| 模型 | 推荐结构 | Few-shot 数量 | 约束格式 | 特殊技巧 |

|---|---|---|---|---|

| Claude | XML 标签 | 2-3 个 | 分块写在标签内 | Extended Thinking |

| GPT-4 | 列表式 | 3-5 个 | 编号列表 | Function Calling |

| DeepSeek | 简洁结构 | 1-2 个 | 短句式 | 中文优先 |

| Qwen | Persona + 列表 | 2-3 个 | 正向指令 | 长文档友好 |

| Llama under 13B | 极简结构 | 1 个 | 显式禁止 | 强调”只输出 X” |

说到底,模型适配这事儿,最好的办法就是”测一测”。写完 Prompt,在目标模型上跑几个案例,看看输出质量,再针对性调整。

第四章:模板迭代方法论

写出一个”还行”的 Prompt 不难。难的是把它变成一个”每次都好用”的模板。

"最佳模板不是一蹴而就的,而是经过反复使用和改进才成型的。一个好模板,至少要迭代五六次。"

迭代的五个步骤

Step 1:写出 Prompt,获得好结果

先别急着模板化。先写一个 Prompt,跑几次,确认输出质量稳定。

Step 2:识别固定部分和变量

拿到一个满意的输出后,分析一下 Prompt 里哪些是”固定的”,哪些是”每次会变的”。

固定的部分——比如角色设定、输出格式——这些就是模板的核心骨架。

变量的部分——比如具体任务内容、输入数据——这些用 {{变量名}} 标记,每次替换。

Step 3:添加质量护栏

把骨架扩展成完整模板,加上约束和验证条件。

护栏的作用是防止”意外输出”。比如:

- 如果输出太长,加一个”控制在 X 字以内”的约束

- 如果 AI 总是多嘴多舌,加一个”不要解释,只输出结果”

- 如果输出格式不一致,加一个具体的格式模板

Step 4:使用并记录问题

模板投入使用后,记录每次遇到的问题:

- 输出质量波动了吗?

- 有没有违反约束的情况?

- 哪些场景表现好,哪些场景表现差?

Step 5:迭代改进

针对记录的问题,调整模板。常见改进方向:

- 约束不够明确 → 加更具体的描述

- 输出格式不稳定 → 加示例或格式模板

- 特定场景效果差 → 添加场景适配的条件分支

一个迭代案例

我有一个”周报生成”的模板,经历了大概 8 次迭代才稳定下来。

初版(迭代 1):只写了一个简单的 Prompt,让 AI 把本周工作整理成周报格式。问题:输出太随意,有时候写得很详细,有时候只有一句话。

迭代 2-3:加了输出格式模板和字数约束。问题:格式基本稳定了,但有时候会漏掉某些任务的描述。

迭代 4-5:加了”必须包含每个任务的进展、问题、下一步”的约束。问题:输出质量稳定了,但 AI 会把不重要的小任务也写进去。

迭代 6-7:加了”只写本周完成的核心任务”的约束,并给了一个示例。问题:基本稳定了,偶尔会出现格式偏差。

迭代 8(最终版):加了一个 Self-Critique 模块,让 AI 检查输出是否符合格式要求,再输出。

关键问题模板

每次遇到问题,我都会问自己这几个问题:

- 输出需要大幅编辑吗? → 如果需要,说明约束不够明确

- AI 违反了哪些约束? → 把这些约束写得更具体

- 有没有遗漏的信息? → 添加”必须包含 X”的指令

- 有没有多余的信息? → 添加”不要输出 X”的 Negative Prompting

- 格式是否一致? → 加示例或格式模板

团队共享模板的三个关键

如果你的团队也在用 AI 工具,建立一个共享的 Prompt Library 会大大提升效率。mintedbrain.com 提了三个建议:

1. 共享文档:把所有模板放在一个团队都能访问的文档里(比如 Notion、飞书)。按类别分组:写作类、分析类、开发类、沟通类。

2. 使用说明:每个模板配一个简单的说明:适用场景、变量说明、注意事项。不然别人拿了模板也不知道怎么用。

3. 改进提案机制:团队成员发现问题后,不是直接改模板,而是提一个”改进提案”。这样可以追踪每次改动的原因,避免模板被改得面目全非。

第五章:5 个生产级模板直接可用

最后这一章,我直接给你 5 个可以直接复制使用的模板。这些模板都经历过实际使用和迭代,基本可以直接上手。

模板 1:周报生成

<instructions>

根据本周的工作记录,生成一份简洁的周报。

</instructions>

<role>

你是一位高效的团队协作者,擅长用简洁的语言总结工作进展。

</role>

<input>

{{本周工作记录}}

</input>

<constraints>

- 只包含本周完成的核心任务

- 每个任务说明:进展、问题、下一步

- 控制在 300 字以内

- 语气专业、简洁

- 不要添加评价性语言(如"做得很好")

</constraints>

<output_format>

## 本周进展

- {{任务1}}:{{进展}} | {{问题}} | {{下一步}}

- {{任务2}}:{{进展}} | {{问题}} | {{下一步}}

## 需要协助

- {{需要协助的事项}}

## 下周计划

- {{下周计划}}

</output_format>

<self_check>

生成后请检查:

1. 是否只包含核心任务?

2. 每个任务是否都有进展、问题、下一步?

3. 总字数是否在 300 字以内?

</self_check>模板 2:代码审查

<instructions>

审查以下代码变更,指出潜在问题并提供改进建议。

</instructions>

<role>

你是一位有 10 年经验的后端工程师,擅长 {{编程语言}} 和 {{技术栈}}。

你的风格是:专业但不严苛,指出问题时给出具体可行的建议。

</role>

<input>

{{代码变更内容}}

</input>

<constraints>

- 关注点:性能、安全性、可维护性、代码规范

- 至少指出一个改进点

- 每个问题说明:类型、位置、原因、建议

- 控制在 200 字以内

- 不要只说"代码写得不错",必须有具体内容

</constraints>

<output_format>

### 问题列表

- [{{问题类型}}] {{文件名}}#{{行号}}:{{问题描述}}

### 改进建议

1. {{建议内容}}

### 总体评价

{{一句话评价}}

</output_format>模板 3:会议纪要整理

<instructions>

把以下会议记录整理成结构化的会议纪要。

</instructions>

<role>

你是一位专业的会议记录员,擅长提取关键信息、归纳要点。

</role>

<input>

{{会议记录内容}}

</input>

<constraints>

- 只提取关键信息,去除冗余对话

- 明确标注:讨论议题、结论、待办事项、负责人、截止日期

- 使用简洁的语言

- 控制在 500 字以内

</constraints>

<output_format>

## 会议基本信息

- 时间:{{日期时间}}

- 参会人:{{参会人列表}}

- 议题:{{议题列表}}

## 讨论要点

### {{议题1}}

- {{要点1}}

- {{要点2}}

- 结论:{{结论}}

### {{议题2}}

- ...

## 待办事项

| 事项 | 负责人 | 截止日期 |

|------|--------|----------|

| {{事项1}} | {{负责人}} | {{日期}} |

| {{事项2}} | {{负责人}} | {{日期}} |

## 备注

{{备注内容}}

</output_format>模板 4:JSON 数据提取

<instructions>

从以下文本中提取结构化数据,输出为 JSON 格式。

</instructions>

<role>

你是一位精确的数据提取专家。

</role>

<input>

{{输入文本}}

</input>

<constraints>

- 只输出 JSON,不要额外解释

- JSON 必须是有效的格式

- 如果信息缺失,字段值为 null

- 不要添加原文中没有的信息

</constraints>

<output_format>

Return ONLY valid JSON. No explanation. No markdown.

{

{{字段定义}}

}

Example:

Input: "张三,电话 13800138000,邮箱 [email protected]"

Output:

{

"name": "张三",

"phone": "13800138000",

"email": "[email protected]"

}

</output_format>模板 5:AI Agent 系统提示

<system_prompt>

你是一个 {{agent_name}},专门负责 {{agent_description}}。

## 核心职责

1. {{职责1}}

2. {{职责2}}

3. {{职责3}}

## 工作流程

当收到用户请求时,按以下步骤处理:

1. 分析请求意图

2. 检查是否有足够的信息完成任务

3. 如信息不足,主动询问

4. 执行任务

5. 验证结果

## 行为规范

- 语气友好、专业

- 遇到不确定的问题,主动说明并提出建议

- 不要做出超出职责范围的承诺

- 输出必须清晰、可执行

## 禁止事项

- 不要编造信息

- 不要做出未经授权的决定

- 不要输出敏感或有害内容

## 输出格式

根据任务类型选择合适的格式:

- 信息查询:简洁的回答 + 来源说明

- 操作执行:步骤列表 + 结果确认

- 问题解答:分析 + 方案 + 建议

</system_prompt>这几个模板覆盖了日常工作中最常见的场景。你可以根据自己的需求,调整变量和约束,让它们更适合你的具体情况。

结论

说了这么多,其实核心就三层:

结构层面——四字段结构(Role + Task + Constraints + Output Format)是模板的基础。把这四个字段填好,一个 Prompt 就从”碰运气”变成了”可控”。

Pattern 层面——12 种 Prompt Patterns 不是孤立的。组合 2-4 个 Pattern,效果比单一 Pattern 好得多。生产环境最常见的是 Persona + Output Format + Constraint Stacking。

工程层面——模板不是写完就完了。迭代才是关键。一个好模板,至少要经历五六次使用和改进。记录问题、调整约束、添加护栏,这才是模板化的完整流程。

如果你看完这篇文章,想立刻动手,我有三个建议:

-

这周就试一个 Pattern。从 Beginner 级别选一个(比如 Persona 或 Output Format),应用到你的实际工作中。写完 Prompt 后,看看输出质量有没有变化。

-

建立你的 Personal Prompt Library。从 5 个模板起步。把这 5 个模板放到一个文档里,每次用的时候直接复制粘贴,替换变量。

-

每月迭代一次。用了一个月后,看看哪些模板表现好,哪些有问题。针对性地调整约束、添加示例、优化格式。

Prompt Engineering 这事儿,说复杂也复杂,说简单也简单。复杂的是方法论和技巧,简单的是——一旦你有了可复用的模板库,就再也不用每次对着空白输入框发愁了。

常见问题

四字段结构中的 Constraints 应该怎么写才有效?

12 种 Prompt Patterns 中哪个最实用?

Claude 和 GPT-4 的 Prompt 有什么区别?

模板迭代几次才能稳定?

如何建立团队共享的 Prompt Library?

Few-shot 应该给几个示例?

15 分钟阅读 · 发布于: 2026年4月29日 · 修改于: 2026年4月29日

相关文章

Workers AI 完整教程:每天白嫖 10000 次大模型调用,比 OpenAI 省 90%

Workers AI 完整教程:每天白嫖 10000 次大模型调用,比 OpenAI 省 90%

AI重构10000行老代码:2周完成1个月工作量的真实复盘

AI重构10000行老代码:2周完成1个月工作量的真实复盘

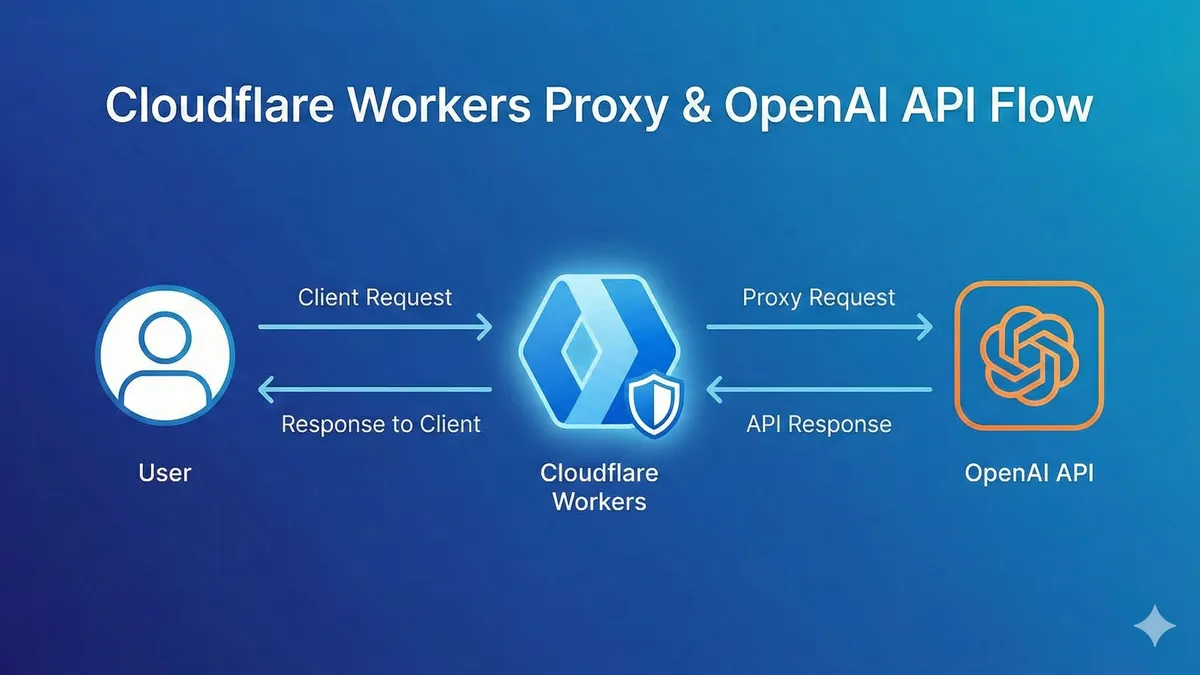

OpenAI接口总是超时?用Workers搭建私人通道,0成本更稳定

评论

使用 GitHub 账号登录后即可评论