Docker 网络模式选择实战:bridge、host 与 overlay 的决策指南

"Docker 提供多种网络驱动,包括 bridge、host、overlay、macvlan 等,每种模式适用不同场景。"

"Overlay 网络基于 VXLAN 隧道技术,需要 Swarm 集群或外部 KV store 支持,适合跨主机容器通信。"

"生产环境 72 小时压力测试显示:Host 延迟 32μs,Bridge 128μs,丢包率分别为 0% 和 0.012%。"

从一个真实故障说起

凌晨两点,生产环境的 API 服务突然超时。

容器明明启动了,docker ps 显示 running,防火墙也关了,端口映射配得清清楚楚,容器日志没报错。排查半小时,搞到快崩溃。最后发现是 Docker 网络模式用错了——我们用的是默认 bridge,但服务需要跨主机访问另一个节点的数据库,bridge 只能单机通信,跨不了主机。

这个案例暴露了一个挺普遍的问题:很多开发者知道 Docker 有 bridge、host、overlay 三种网络模式,但不清楚什么时候用哪种。说实话,我刚开始也踩过这个坑。

读完本文,你将拿到三种网络模式的完整决策流程图和性能基准对比表,下次遇到网络问题,先判断”单机还是跨主机”,就不会像我当初那样瞎折腾。

Bridge:默认选择,单机通信之王

Bridge 是 Docker 的默认网络模式。

你运行 docker run 时,如果不指定 --network,容器就自动挂到这个模式。它的核心原理很简单:Docker 在宿主机上创建一个叫 docker0 的虚拟网桥,每个容器分到独立的 IP(通常是 172.17.x.x),通过 veth pair(虚拟网线)连到网桥上。

听起来挺抽象?其实就是把容器当作一台独立的虚拟机,给它配个私有 IP,然后通过 NAT(端口映射)让它跟外界通信。

适用场景

单主机多容器部署,首选 Bridge。

开发环境、测试环境,甚至一些不需要跨主机通信的生产场景,都用它就够了。简单、安全、不需要额外配置。

配置示例

默认就是 Bridge,所以你根本不用指定:

# 默认 bridge,自动分配 IP,需要 -p 映射端口

docker run -d -p 8080:80 nginx不过有个问题:默认 bridge 下,容器之间只能用 IP 通信,不能用容器名。你启动两个容器,想让它们互相访问,还得手动查 IP,挺麻烦的。

怎么查?用 docker inspect:

# 启动两个容器

docker run -d --name web nginx

docker run -d --name db redis

# 查看 web 容器的 IP

docker inspect web | grep IPAddress

# 输出:172.17.0.2

# 在 db 容器里 ping web(只能用 IP)

docker exec db ping 172.17.0.2你看,每次通信都要先查 IP,多麻烦。如果容器重启,IP 还可能变,更麻烦。

推荐的做法是创建自定义 bridge:

# 创建自定义网络

docker network create --subnet=192.168.100.0/24 my-net

# 启动容器,挂到自定义网络

docker run -d --network my-net --name web nginx

docker run -d --network my-net --name db redis

# web 容器可以直接 ping db(DNS 自动解析)

docker exec web ping db这样一来,容器名就能当域名用了,方便不少。说实话,这点我当时也挺惊喜的,本来以为得手动配 DNS,结果 Docker 自带的。

Host:性能最优,隔离最弱

Host 模式有点”暴力”——容器直接用宿主机的网络栈。

没有独立 IP,没有 NAT 转换,没有 veth pair。容器里的网络接口就是宿主机的网络接口,性能接近原生,几乎没有开销。

你可能会想:这么直接,岂不是性能最好?确实是这样,但代价是隔离没了。

适用场景

对网络性能敏感的场景,Host 是最优选择。

比如游戏服务器、实时通信(WebSocket、视频流)、高频交易系统,这些应用哪怕几十微秒的延迟都很关键,Host 模式能把这些开销砍掉。

还有就是网络调试。容器里跑 tcpdump,直接抓宿主机的流量,不用额外配置,方便排查问题。

配置示例

更简单,连 -p 都不用:

# host 模式,容器直接占用宿主机 80 端口

docker run -d --network host nginx你启动后,直接访问宿主机的 80 端口,就是容器里的 nginx。

风险提示

但有几个坑要注意。

端口冲突:如果你在宿主机上已经跑了 nginx(占 80 端口),再启动一个 host 模式的容器也想用 80,直接报错,起不来。

报错信息类似:

docker: Error response from daemon: driver failed programming external connectivity on endpoint xxx: Bind for 0.0.0.0:80 failed: port is already allocated.排查方法很简单:先检查宿主机端口占用:

# 查看端口占用

netstat -tuln | grep :80

# 或者

ss -tuln | grep :80

# 查看进程

lsof -i :80如果有进程占用,要么停掉它,要么改容器端口。改容器端口的话,Host 模式没法用 -p,只能在容器里改应用配置(比如 nginx 改成监听 8080)。

安全性:容器能看到宿主机的所有网络接口,包括内网、外网、甚至 VPN 连接。如果容器被攻破,攻击者能访问宿主机的所有网络资源。这点在生产环境要慎重。

说实话,Host 模式用得少,大部分场景 Bridge 就够了。但遇到性能瓶颈,或者真的需要低延迟,Host 是个值得考虑的选项,前提是你能接受隔离的代价。

Overlay:跨主机通信的正解

Bridge 只能单机通信,Host 性能好但也跨不了主机,那多台服务器上的容器怎么互相访问?这就得用 Overlay。

Overlay 网络基于 VXLAN 隧道技术,把分布在不同主机上的容器拉到一个虚拟局域网里,好像它们都在同一台机器上一样。

核心原理

VXLAN 是 Overlay 的关键。

它在容器流量外面包了一层封装,通过”隧道”传到另一台主机,再解封装,交给目标容器。这个封装/解封装的过程由 VTEP(VXLAN Tunnel Endpoint)负责,Docker Swarm 里自动管理。

打个比方:你在北京寄快递到上海,快递公司把你的包裹装进一个大箱子,通过物流网络运到上海,再拆开箱子,把包裹交给收件人。VXLAN 就是那个”大箱子”,容器流量是你的”包裹”,VTEP 是快递公司的打包/拆包环节。

VXLAN 的好处是:不管底层物理网络怎么连,容器看到的都是同一虚拟局域网,IP 统一、通信简单。

有个前提:Overlay 网络需要 Swarm 集群,或者外部 KV store(比如 Consul)。单机 Docker 搞不了,必须多节点协作。

为什么需要 Swarm?因为 Overlay 网络要管理多台主机的容器 IP、VTEP 连接、路由信息,这些需要一个中心化的协调者,Swarm 就干这个事。如果你不用 Swarm,可以用 Consul、Etcd 做 KV store,但配置更复杂。

适用场景

Docker Swarm 集群,Overlay 是唯一选择。

跨主机微服务部署,比如 Web 服务在节点 A,数据库在节点 B,它们需要互相访问,Overlay 把它们拉到一个虚拟网络,容器名就能通信,不用配 IP。

Kubernetes 里也有类似的概念(CNI 网络),不过配置方式不一样。如果你主要用 K8s,这篇文章的 Overlay 概念也能帮你理解 K8s 的网络原理。

配置示例(完整流程)

Overlay 的配置比 Bridge、Host 复杂,需要先初始化 Swarm:

# 1. 在第一台主机上初始化 Swarm

docker swarm init --advertise-addr 192.168.1.10

# 会输出一个 join token,类似:

# docker swarm join --token SWMTKN-xxx 192.168.1.10:2377

# 2. 在其他主机上加入 Swarm(复制上面的命令)

docker swarm join --token SWMTKN-xxx 192.168.1.10:2377

# 3. 创建 Overlay 网络

docker network create --driver overlay --subnet=10.0.1.0/24 my-overlay

# 4. 在不同主机上启动容器,加入同一 Overlay

# 在节点 A

docker run -d --network my-overlay --name web nginx

# 在节点 B

docker run -d --network my-overlay --name db redis

# 5. 测试通信(web 能 ping db,跨主机!)

docker exec web ping db我第一次配置 Overlay 时,踩了个坑:忘了 Swarm 初始化,直接想创建 overlay 网络,报错”This node is not a swarm manager”。后来才明白,Overlay 必依赖 Swarm。

还有一个细节:--subnet=10.0.1.0/24,推荐用 /24 子网块(256 个 IP),避免跟其他网络冲突。规模大的集群可以用 /16,但记得规划好 IP 范围。

性能基准对比:数据说话

三种网络模式到底有多大性能差异?我整理了几份实测数据,给你一个直观对比。

核心数据(72小时压力测试)

据 CSDN 的生产环境实测报告,三种模式在压力测试下的表现如下:

关键发现

几个数字挺有意思:

Host 比 Bridge 快不少。平均延迟从 128μs 降到 32μs,差了 96μs,约 14% 的性能提升。吞吐量方面,Host 接近原生,Bridge 大概 80%。如果你的应用每秒处理几千次请求,这个差距会很明显。

Bridge 的 NAT 开销不小。CPU 占用从 0.9 核涨到 1.8 核,几乎翻倍。因为每个外部请求都要经过 NAT 转换,多了一层处理。

Overlay 的 VXLAN 封装更重。跨主机通信要封装、解封装,延迟比 Bridge 还高,CPU 占用更大。适合分布式场景,不适合高性能单机。

实际影响

这些数字看着抽象,但实际场景里差别挺大。

比如高频交易系统,每微秒都很关键,Host 模式的 32μs vs Bridge 的 128μs,可能意味着订单能不能抢到。而普通 Web 应用,用户请求往返延迟本来就有几百毫秒,几十微秒的差距几乎无感。

所以别只看数字,要结合你的场景。性能敏感?优先 Host。安全优先?默认 Bridge。跨主机必需?Overlay,接受性能代价。

如何测试你的环境

如果你想在自己环境里测性能差异,有几个简单方法:

延迟测试:用 ping 或 iperf3

# 在容器 A 里 ping 容器 B(bridge 模式)

docker exec container-a ping container-b

# 用 iperf3 测试吞吐量(先安装 iperf3)

docker exec container-a iperf3 -c container-bCPU 占用监控:用 docker stats

# 查看容器 CPU 占用

docker stats --no-stream网络流量监控:用 tcpdump 抓包分析

# 抓宿主机网络流量(host 模式直接抓)

docker exec -it container-host tcpdump -i eth0

# 抓 bridge 网络流量(需指定网桥)

tcpdump -i docker0我建议在生产环境上线前,先跑一轮压力测试,看看你选的网络模式能不能扛住流量。别等上线后才发现问题。

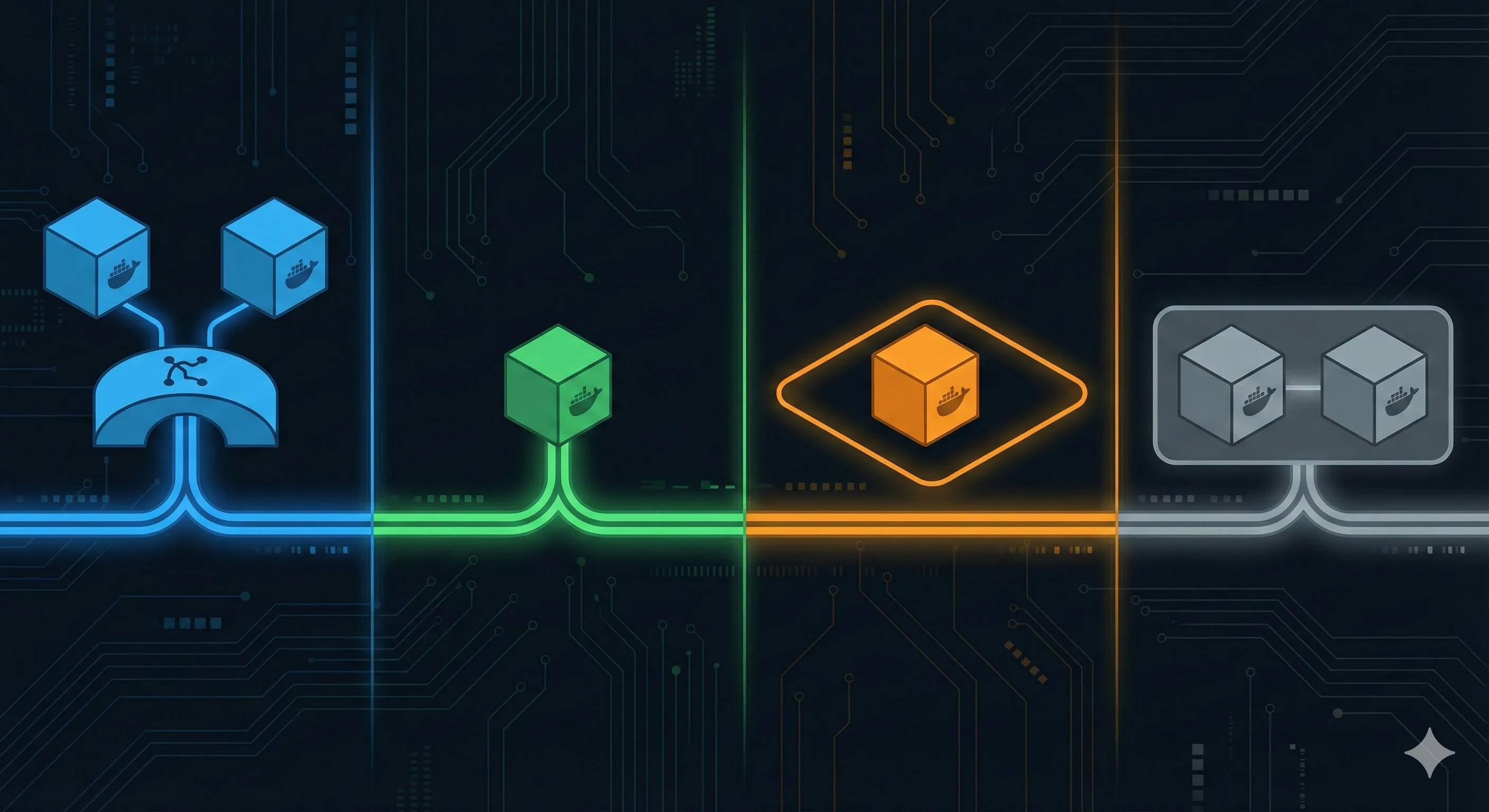

决策流程图:场景到模式选择

说了这么多,到底怎么选?给你一个简单的决策逻辑。

三步决策流程

遇到网络配置,按这个流程走:

第一步:是否需要跨主机通信?

如果多个容器分布在不同服务器上,需要互相访问(比如 Web 在节点 A,数据库在节点 B),那就必须跨主机。

- YES → 第二步

- NO → 第三步

第二步:是否使用 Swarm?

跨主机通信有两种路子:Docker Swarm(用 Overlay)或者手动配置路由(用 Host + iptables)。

- YES → Overlay 网络(最简单,Swarm 自动管理)

- NO → 考虑 Macvlan 或 Host + 路由配置(复杂,适合特殊场景)

第三步:对网络性能是否敏感?

如果应用对延迟、吞吐量很敏感(高频交易、实时通信、游戏),性能优先。

- YES → Host 模式(但要评估安全风险)

- NO → Bridge 模式(默认安全选择)

场景推荐表

更直观一点,常见场景的推荐:

| 场景 | 推荐模式 | 理由 |

|---|---|---|

| 单机 Web 应用 | Bridge | 安全、简单,默认够用 |

| 高频交易服务 | Host | 延迟敏感,性能最优 |

| Swarm 微服务集群 | Overlay | 跨主机通信必需 |

| 开发调试环境 | Bridge(自定义) | DNS 支持,容器名通信 |

| 完全隔离测试 | None | 无网络,完全隔离 |

一个小建议

别一开始就纠结”哪个模式最优”。

大部分场景,Bridge 就够了。遇到问题再调整:

- 服务发现麻烦 → 换成自定义 Bridge

- 性能真不够 → 考虑 Host,但要评估安全代价

- 需要跨主机 → Overlay,接受 VXLAN 的性能开销

我见过不少团队,一开始就配 Host,结果端口冲突、安全漏洞一堆。其实 Bridge 默认就能解决 90% 的场景,没必要过度优化。

生产环境最佳实践

三种模式各有优劣,生产环境怎么用才稳妥?这里总结几个实战经验。

Bridge:自定义网络 + DNS

默认 bridge 有个大问题:容器只能用 IP 通信,不能用名称。

生产环境推荐创建自定义 bridge:

# 创建自定义网络,指定子网(避免冲突)

docker network create --subnet=192.168.100.0/24 --name my-app-net

# 启动服务,挂到自定义网络

docker run -d --network my-app-net --name web-server nginx

docker run -d --network my-app-net --name redis-cache redis

# web-server 可以直接访问 redis-cache(DNS 自动解析)

docker exec web-server ping redis-cache这样一来,服务发现不用手动配 IP,容器名就能当域名用,方便多了。

还有一点:子网规划要合理。别用默认的 172.17.x.x,容易跟公司内网冲突。推荐用 192.168.100.0/24 或 10.10.10.0/24,提前跟运维沟通好 IP 范围。

Host:安全加固不能少

Host 模式性能好,但安全性差。容器能看到宿主机的所有网络接口,包括内网、外网、VPN。

生产环境用 Host,至少做两件事:

第一:限制容器权限。用 --cap-drop 删掉不必要的 Linux capabilities,比如 CAP_NET_RAW(防止容器随意抓包):

docker run -d --network host --cap-drop NET_RAW nginx第二:监控异常流量。容器网络行为要监控,比如突然大量外连、访问内网敏感接口,要告警。可以用 Prometheus + Grafana 监控,或者专门的网络安全工具。

说实话,Host 模式在生产环境用得少,除非性能真的瓶颈。大部分场景 Bridge + 自定义网络就够了。

Overlay:子网大小 + Swarm 稳定性

Overlay 网络的关键是 VXLAN 封装,开销不小。

几个优化点:

控制子网大小:推荐用 /24(256 个 IP),规模大的集群用 /16(约 6 万个 IP),但要提前规划,避免冲突。

# 推荐:/24 子网块

docker network create --driver overlay --subnet=10.0.1.0/24 my-overlay监控 CPU 使用率:VXLAN 封装会增加 CPU 开销,尤其是高流量场景。用 docker stats 或 Prometheus 监控,发现 CPU 过高要及时优化,比如调整 MTU、减少跨主机通信。

Swarm 节点间网络稳定性优先:Overlay 依赖 Swarm,节点间网络不稳定,Overlay 就会出问题。生产环境用 Overlay,要确保 Swarm 节点间的网络延迟低、丢包少,最好用内网专线。

总结:记住三个核心原则

说了这么多,归根结底就是三句话:

1. 单机默认 Bridge

90% 的场景,Bridge 就够了。安全、简单、默认即用,不用纠结。如果服务发现麻烦,换自定义 Bridge,容器名就能通信。

2. 性能敏感用 Host

延迟敏感、吞吐量关键的场景,Host 是最优选择。但记住:性能最好,隔离最差。生产环境用 Host,要做好安全加固。

3. 跨主机必 Overlay

多台服务器上的容器要互相访问,Overlay 是唯一正解。前提是 Swarm 集群,配置比 Bridge、Host 复杂,但跨主机通信必需。

实战建议

下次遇到 Docker 网络问题,先问自己一个问题:单机还是跨主机?

单机,默认 Bridge。性能不够,考虑 Host,但要评估安全代价。跨主机,Overlay,接受 VXLAN 的性能开销。

别一开始就纠结”哪个模式最优”,从 Bridge 开始,遇到问题再调整。我当初就是搞反了,先配 Overlay,结果单机场景根本用不上,白白折腾。

如果你对 bridge/host/none/container 的基础原理还不熟悉,建议先读系列中的第11篇《Docker网络模式详解》,把基础搞清楚,再看这篇进阶内容,会更顺畅。

参考资料

"Docker 提供多种网络驱动,包括 bridge、host、overlay、macvlan 等,每种模式适用不同场景。官方文档详细说明了各模式的配置方法和适用场景。"

"Overlay 网络基于 VXLAN 隧道技术,需要 Swarm 集群或外部 KV store 支持,适合跨主机容器通信。官方文档提供了完整的配置流程。"

"Swarm 网络管理指南,包括如何创建 overlay 网络、管理服务网络、以及跨主机通信的最佳实践。"

"Docker网络配置最佳实践(生产环境零丢包实测报告),提供了 72 小时压力测试数据,包括 Host、Bridge、Overlay 三种模式的延迟、吞吐量、丢包率对比。"

"Docker Network Tests under Host/Bridge Mode,详细对比了 Host 和 Bridge 模式的性能差异,提供了延迟测试方法和实验数据。"

Docker 网络模式选择与配置

根据场景选择合适的 Docker 网络模式并进行配置

⏱️ 预计耗时: 15 分钟

- 1

步骤1: 判断部署场景

明确容器部署需求:单机多容器、单机高性能、还是跨主机集群通信。单机场景优先考虑 Bridge 或 Host,跨主机必须用 Overlay。 - 2

步骤2: 评估性能与安全需求

性能敏感(高频交易、实时通信)选 Host,接受安全代价;安全优先选 Bridge,接受 NAT 性能开销;跨主机必需选 Overlay,接受 VXLAN 封装开销。 - 3

步骤3: 配置网络模式

Bridge:创建自定义网络 docker network create --subnet=192.168.100.0/24 my-net。Host:docker run --network host。Overlay:先 docker swarm init,再创建 overlay 网络。 - 4

步骤4: 测试与监控

用 ping 和 iperf3 测试延迟与吞吐量,用 docker stats 监控 CPU 占用,用 tcpdump 抓包分析网络流量。

常见问题

默认 Bridge 和自定义 Bridge 有什么区别?

Host 模式端口冲突怎么办?

不用 Swarm 能创建 Overlay 网络吗?

三种模式的性能差异有多大?

生产环境推荐哪种模式?

13 分钟阅读 · 发布于: 2026年5月14日 · 修改于: 2026年5月15日

相关文章

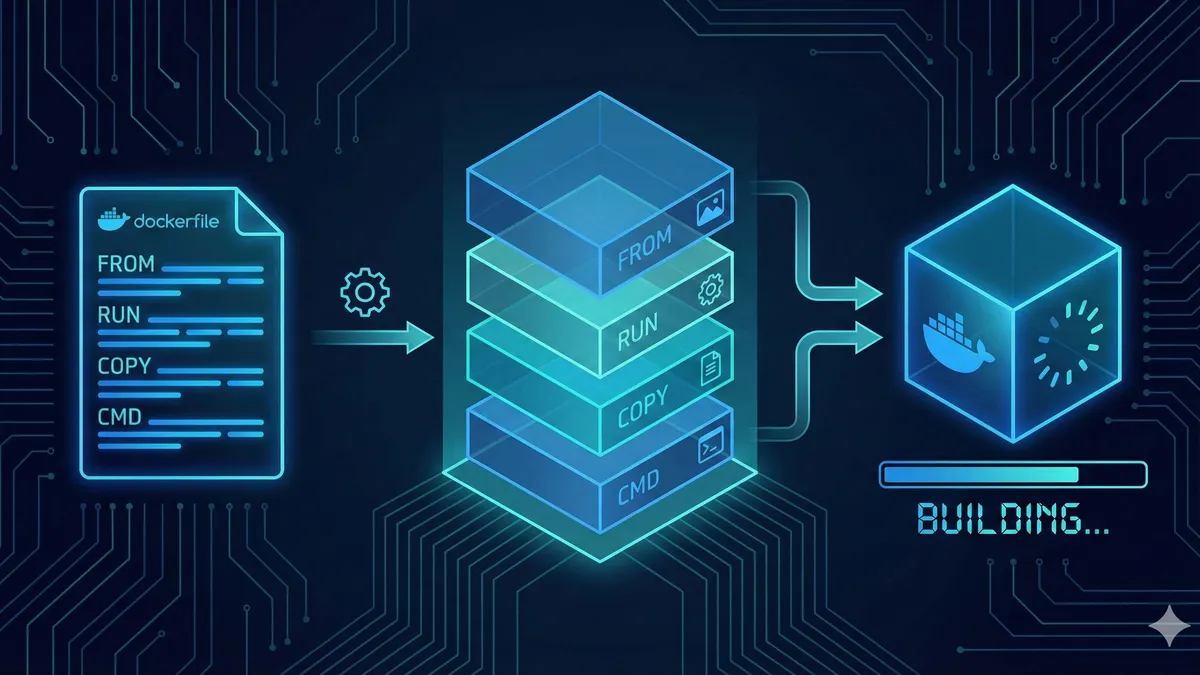

Dockerfile入门教程:从零构建你的第一个Docker镜像(含实例)

Dockerfile入门教程:从零构建你的第一个Docker镜像(含实例)

Docker vs 虚拟机:5分钟搞懂性能差异与场景选择指南

Docker vs 虚拟机:5分钟搞懂性能差异与场景选择指南

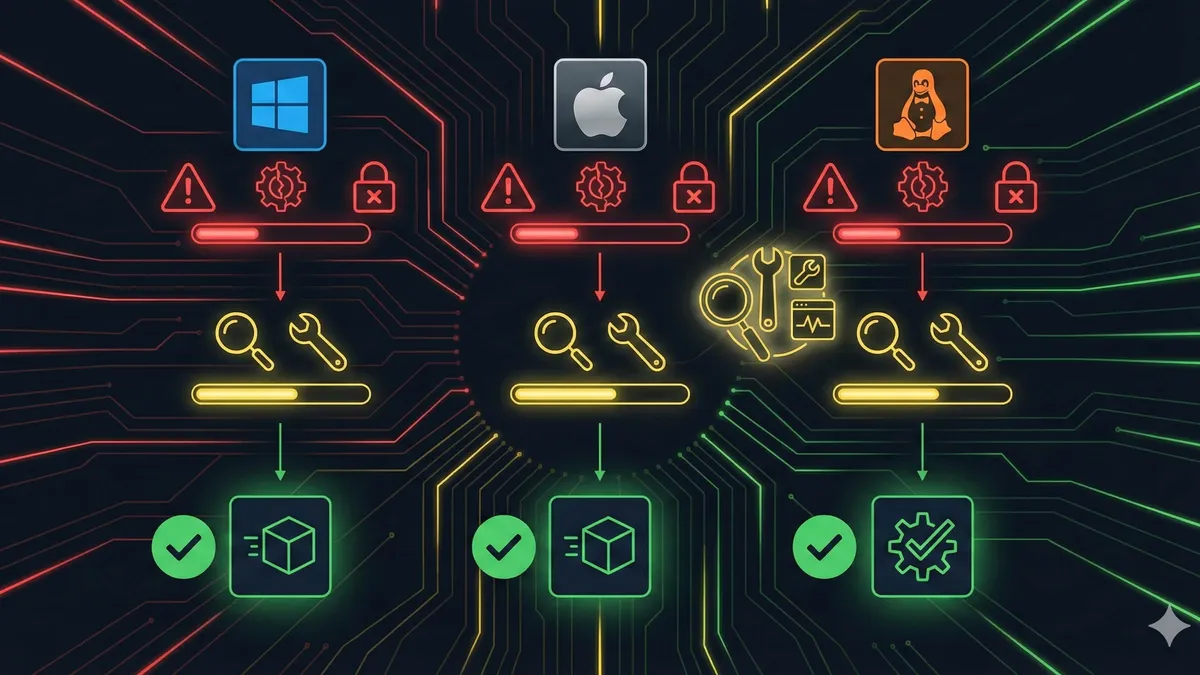

Docker安装避坑指南2025:从permission denied到成功运行的完整解决方案

评论

使用 GitHub 账号登录后即可评论