Agent メモリシステム設計:セッションから長期記憶まで

30分かけて AI Agent とプロジェクトの詳細を話し合い、アーキテクチャ案や技術選定、リスク評価を一通り確認したとします。翌日、同じ会話を開くと、Agent から「どのような内容についてお話ししましょうか?」と聞かれます。

昨日のすべての内容——あなたの好み、議論の結論、進捗状況——がすべて消えてしまったのです。

正直に言えば、これは Agent の能力の問題ではありません。問題はアーキテクチャ設計にあります。Agent に「脳」を与えたが、「記憶」を与えていないのです。

LLM はデフォルトでステートレス(無状態)です。各リクエストは白紙の状態から始まり、能動的にメモリシステムを構築しない限り、何も記憶しません。多くのチームが Agent の本番運用を開始してから、この問題に気づきます。「また同じことを聞いてくる」「前回決めたことが忘れられている」というユーザーからのクレームが届き、そこから慌てて対策を講じるのです。

この記事で共有したいのは、完全な Agent メモリシステム設計の青写真です。4種類のメモリタイプの選び方、5段階パイプラインの構築方法、フレームワークの選定、コスト管理について解説します。

第1章:なぜ Agent にメモリシステムが必要なのか

LLM は生まれつき「金魚の記憶」しか持ちません。あなたがリクエストを送ると、LLM はレスポンスを返し、それで終わりです。次のリクエストが来ると、また新しい状態から始まり、何も覚えていません。これは欠陥ではなく、設計上の特性です。各推論が独立して行われることで、出力の予測可能性が保証されるのです。

しかし、この特性は Agent のシナリオでは大問題となります。

カスタマーサポートの Agent を想像してください。ユーザーが「住所を変更したい」と言います。Agent は「承知しました。新しい住所をご入力ください」と返します。ユーザーが「前回の倉庫の住所でお願いします」と言います。この時、Agent は完全に困惑します。前回とはいつのこと?どの倉庫?何も分からないのです。

さらに悪いのは「コンテキストの腐敗(Context Rot)」です。会話にどんどん情報を詰め込むと、コンテキストが長くなり、中のノイズも増えていきます。ユーザーが単純な質問をしても、Agent は数十ラウンドの履歴から答えを探さなければなりません。Redis 公式ブログのデータによると、全コンテキスト方式では p95 レイテンシーが 17.12 秒に跳ね上がり、トークンコストが14倍に増加します。

コストの差はさらに極端です。ある比較を見たことがあります。全コンテキスト方式は月に100万ドルを消費しますが、選択的記憶方式なら10万ドルで済みます。10倍の差です。

ここでの中心的な矛盾はこうです。Agent にすべてを記憶させたいが、すべてをコンテキストウィンドウに詰め込むことはできない。どうすればいいのでしょうか?答えはシンプルです。メモリシステムを導入することです。

メモリシステムは3つの核心的な問題を解決します。

セッション間の継続性:ユーザーが今日「中国語での返信を好む」と言えば、明日、来週、来月開いても、Agent はこの好みを覚えているべきです。

パーソナライゼーション:各ユーザーの使用習慣、ビジネス背景、履歴は異なります。メモリシステムによって、Agent はユーザーを「認識」できるようになります。

クラッシュリカバリー:Agent が途中でエラーになった場合、メモリシステムがあれば、再起動後に前回の中断点から再開でき、最初からやり直す必要がありません。

第2章:4種類のメモリタイプ:認知科学から技術アーキテクチャまで

メモリは単なる記憶領域ではなく、階層があり、役割分担があります。認知科学者は人間の記憶を作業記憶、エピソード記憶、意味記憶、長期記憶に分類しています。Agent のアーキテクチャ設計もこのモデルを参考にできます。

作業記憶(Working Memory)

作業記憶は、Agent の現在のセッションにおける「脳」です。あなたが会話すると、Agent が頭の中で処理しているものはすべてここにあります。ユーザーが言ったこと、現在のタスクの進捗、中間の推論結果などです。

保存場所は直接的です。コンテキストウィンドウです。ライフサイクルも短く、会話が終わると作業記憶はクリアされます。次の会話は最初から始まります。

技術実装では、多くのフレームワークが Redis や KV Store をバックエンドとして使用し、Checkpointer が定期的に状態を保存します。LangGraph の MemorySaver は典型的な例です。各ノードの実行完了後、状態のスナップショットをメモリまたはデータベースに保存します。

エピソード記憶(Episodic Memory)

エピソード記憶は「何が起きたか」の記録です。ユーザーが前回どんな質問をしたか、Agent がどう答えたか、途中でどんな決定があったか。これらのイベントは時系列で保存され、流水帳のようなものです。

作業記憶とは異なり、エピソード記憶はセッションをまたいで永続化されます。今日の会話が終わっても、明日の会話で前回のイベント記録を確認できます。

保存方法は通常、イベントストリーム(Redis Streams)または時系列データベースです。重要な最適化戦略は「要約圧縮」です。生のイベントは非常に長い場合があるため、LLM で簡潔なバージョンに要約します。重要な情報を保持しながら、保存と検索のコストを削減します。

意味記憶(Semantic Memory)

意味記憶は「何を知っているか」です。抽象的な知識と事実を保存します。「ユーザーは中国語での返信を好む」「本社は上海にある」「製品Aの価格は500元」などです。

これらはいつ知ったか、どの会話から知ったかは関係なく、知識そのものだけが重要です。

保存方法は主にベクトルデータベース(Pinecone、Weaviate、Milvus)とナレッジグラフです。ベクトル化後、HNSW または IVF インデックスで検索を高速化します。ナレッジグラフはエンティティ関係を保存するために使用されます。例えば「ユーザーAはBを好む」「会社CはDに位置する」などです。

長期記憶(Long-Term Memory)

長期記憶は「ユーザーは誰か」です。ユーザー像、好みの設定、長期的なドメイン知識を保存します。これらは簡単には変化せず、すべてのセッションで有効です。

保存方法は永続化データベースです。PostgreSQL、MongoDB、またはクラウドプロバイダーが提供する専用ソリューション(Alibaba Cloud AnalyticDB、PolarDB)。検索方法は通常、意味検索+RAG で、属性フィルタリング(ユーザーID で絞り込みなど)と組み合わせます。

この4種類のメモリは孤立しておらず、ピラミッド構造を形成します。作業記憶は最下層で、最も高速だが寿命が短い。長期記憶は最上層で、最も持続的だが検索が最も遅い。Agent はタスクの要件に応じて、異なる層から情報を取り出します。

第3章:5段階メモリパイプライン:抽出から忘却まで

メモリは会話を保存すれば終わりではありません。完全なパイプラインが必要です。抽出、統合、保存、検索、忘却。各段階にこだわりがあります。

Stage 1:抽出(Extraction)

会話の中のすべての発言を記憶する必要はありません。「こんにちは」「ありがとう」「ちょっと待って」これらのノイズ情報を保存しても無駄です。

抽出段階のタスクは、どの情報が保存に値するかを識別することです。一般的な方法は LLM 分類+ルールフィルタリングです。LLM がこの情報に長期的な価値があるかを判断します(「ユーザーは中国語での返信を好む」vs「ユーザーがこんにちはと言った」)。ルールフィルタリングは明らかなパターンを補足処理します(長さが短すぎる、純粋な挨拶など)。

# 抽出段階の疑似コード

def extract_memories(conversation):

candidates = []

for message in conversation:

# LLM 分類:記憶に値するか?

classification = llm.classify(message, "memory_candidate")

if classification == "worth_remembering":

candidates.append(message)

# ルールフィルタリング:明らかなノイズを除去

candidates = filter_noise(candidates)

return candidatesStage 2:統合(Consolidation)

抽出された情報には重複があるかもしれません。「ユーザーは中国語が好き」という情報が異なる会話で3回出てきたかもしれません。3回保存する必要はありません。

統合段階のタスクは、重複のマージ、古い記憶の更新、ナレッジグラフのトリプル構築です。

例えば:

- 古い記憶:「ユーザーは中国語での返信を好む」

- 新しく抽出:「ユーザーは簡潔な中国語での返信をより好むと言った」

- 統合後:「ユーザーは簡潔な中国語での返信を好む」(マージして詳細化)

# 統合段階の疑似コード

def consolidate_memories(new_memories, existing_memories):

for new in new_memories:

# 既存の記憶と重複または関連があるか確認

similar = find_similar(new, existing_memories)

if similar:

# マージまたは更新

merged = llm.merge(new, similar)

update_memory(similar.id, merged)

else:

# 新規記憶を追加

add_memory(new)Stage 3:保存(Storage)

保存段階では、保存形式とインデックス方式という2つの重要な決定があります。

保存形式はメモリタイプに依存します。作業記憶は KV Store、エピソード記憶はイベントストリーム、意味記憶はベクトルデータベース、長期記憶はリレーショナルデータベースを使用します。

インデックス方式は検索パフォーマンスに影響します。主流の選択は HNSW と IVF です:

- HNSW:中・小規模データセット(10万〜100万級)に適合。同じレイテンシー目標でより高い再現率を達成。ただし、メモリ消費が大きい。

- IVF:大規模データセット(100万〜1億級)に適合。メモリ効率が高い。ただし、精度はやや劣る。

Redis ブログのデータによると、HNSW は同じレイテンシー目標で通常より高い再現率を達成でき、IVF は大規模データでよりメモリを節約します。選択はデータ量と精度要件によります。

Stage 4:検索(Retrieval)

Agent がメモリを使用する際、検索段階が関連情報を取り出します。

純粋なベクトル検索だけでは精度が不十分な場合があります。より良い方法は「ハイブリッド検索」です。ベクトル検索+全文検索+属性フィルタリングの組み合わせです。

例えば、ユーザーが「前回言っていた倉庫の住所は何ですか」と聞く場合:

- ベクトル検索:意味的に類似した記憶を検索(「倉庫住所」「物流情報」)

- 属性フィルタリング:このユーザーの記憶のみを確認

- 時系列ソート:最近の記憶を優先的に返す

# ハイブリッド検索の疑似コード

def retrieve_memories(query, user_id):

# ベクトル検索

vector_results = vector_db.search(query, top_k=20)

# 属性フィルタリング:現在のユーザーのみ

filtered = [m for m in vector_results if m.user_id == user_id]

# 時系列ソート:最近を優先

sorted_results = sort_by_time(filtered, descending=True)

return sorted_results[:5]Stage 5:忘却(Forgetting)

忘却は消極的な言葉に聞こえますが、メモリシステムでは極めて重要です。忘れないと、保存が無限に膨張し、ノイズが価値ある情報を埋もれてしまいます。

忘却戦略には主に2種類あります。

時間減衰:記憶の重要度が時間とともに低下します。1ヶ月前の好み設定はすでに古くなっている可能性があり、自動的に重みが下がります。

重要度淘汰:アクセス頻度、ユーザーフィードバック、検証回数などの指標に基づいて重要度を評価します。重要度の低い記憶を定期的にクリーンアップします。

見落とされがちな問題は「一回限りのエラーの固定化」です。ユーザーが間違った情報を何気なく言ってしまい、Agent がそれを「事実」として保存してしまう。これは危険です。解決方法は、統合段階で検証ロジックを追加するか、信頼度の低い記憶に「確認待ち」のマークを付けることです。

Agent メモリシステムの構築

5段階パイプラインでメモリの抽出、統合、保存、検索、忘却を実装

⏱️ 目安時間: 60 分

- 1

ステップ1: 抽出段階:価値ある情報の識別

会話から記憶に値する情報を識別します:

• LLM 分類で情報に長期的な価値があるか判断

• ルールフィルタリングで明らかなノイズを除去(挨拶、無意味な短文)

• 重要指標:ユーザー設定、ビジネス制約、決定結論 - 2

ステップ2: 統合段階:マージと更新

抽出結果を処理し、重複保存を回避します:

• 類似記憶を検出し、重複情報をマージ

• 古い記憶を更新(設定の詳細化など)

• ナレッジグラフのトリプルを構築

• 信頼度の低い情報に「確認待ち」マークを付与 - 3

ステップ3: 保存段階:適切な方法の選択

メモリタイプに応じて保存とインデックスを選択します:

• 作業記憶:Redis/KV Store(サブミリ秒)

• エピソード記憶:Redis Streams/時系列データベース

• 意味記憶:ベクトルデータベース+HNSW/IVF インデックス

• 長期記憶:PostgreSQL/MongoDB+RAG 検索 - 4

ステップ4: 検索段階:ハイブリッド検索戦略

複数の検索方法を組み合わせて精度を向上させます:

• ベクトル検索:意味的類似度マッチング

• 全文検索:キーワードの正確なマッチング

• 属性フィルタリング:user_id、時間範囲でフィルタ

• 時系列ソート:最近の記憶を優先的に返す - 5

ステップ5: 忘却段階:膨張とノイズの防止

定期的に価値の低い記憶をクリーンアップします:

• 時間減衰:重要度が時間とともに低下

• アクセス頻度淘汰:長期間アクセスがない記憶の重みを下げる

• エラー固定化防止:検証ロジック+確認待ちマーク

• 定期リフレクション:LLM で矛盾または古い情報をチェック

第4章:フレームワーク比較:Mem0 vs Zep vs LangMem vs LangChain

市場にはすでに成熟したメモリフレームワークがあります。ゼロから車輪を再発明する必要はありません。問題は、どれを選ぶかです。

この4つのフレームワークはそれぞれ特徴があります。まず比較表を示します:

| 項目 | Mem0 | Zep | LangMem | LangChain 標準 |

|---|---|---|---|---|

| タイプ | マネージドプラットフォーム(オープンソース版あり) | コンテキストエンジニアリングプラットフォーム | LangGraph ライブラリ | 基盤フレームワーク |

| ナレッジグラフ | Pro 版で対応 | コア機能 | 未対応 | 外部追加必要 |

| セルフホスト | オープンソース版で可能 | クラウドのみ | 完全ローカル | 完全ローカル |

| SDK | Python、JS、MCP Server | Python、TS、Go | Python のみ | Python |

| 料金 | Free → $19 → $249/月 | $25/月〜 | 無料 | 無料 |

選定の決定木

フレームワークを選ぶ前に、まず3つの問いを自問してください:

Q1: ナレッジグラフは必要か?

→ はい → Mem0 Pro または Zep(両方とも成熟したグラフ機能を持つ)

→ いいえ → Q2 へ

Q2: マネージドサービスは必要か?

→ はい → Mem0(入門が簡単)または MemoClaw(API Key 設定不要)

→ いいえ → Q3 へ

Q3: LangGraph を使用しているか?

→ はい → LangMem(ネイティブ統合、追加依存関係なし)

→ いいえ → 自前で実装(LangChain Checkpointer +ベクトルデータベースを使用)実際のシナリオ別推奨

インテリジェントカスタマーサポート → Mem0

カスタマーサポート Agent は、ユーザーの好み、注文履歴、クレーム記録を覚える必要があります。これらの情報はナレッジグラフで保存するのが適しています。「ユーザーAは製品Bを購入」「ユーザーAは問題Cについてクレーム」などです。Mem0 のマネージド版は運用コストを節約でき、Pro 版はグラフ機能を提供します。

医療診断 Agent → Zep

医療シナリオでは複雑なエンティティ関係とタイムラインが関係します。症状がいつ出現したか、薬がいつ調整されたか、検査結果がいつ変化したか。Zep のコア優位性は「時系列ファクト(Temporal Facts)」です。イベントの時間次元を正確に追跡でき、病歴の推論が必要なシナリオに適しています。

社内ツール Agent → LangMem

すでに LangGraph で Agent を構築している場合、LangMem を追加するのが最も簡単です。LangGraph のネイティブライブラリで、追加の依存関係が不要。Checkpointer とメモリ保存が一体化しています。

迅速なプロトタイピング → MemoClaw

メモリシステムの効果をまず試してみたいが、アカウント登録や API Key の設定をしたくない場合。MemoClaw は「メモリ as a Service」を提供し、store/recall の2つのインターフェースを簡単に呼び出すだけで使用できます。プロトタイピング段階に適しており、本番環境ではより強力なフレームワークが必要かもしれません。

Mem0 の統合エコシステム

特筆すべきは Mem0 の統合カバレッジです。Mem0 公式ブログの2026年初頭のデータによると、21のフレームワークとプラットフォームの統合をサポートしています。OpenAI、LangChain、LlamaIndex、CrewAI、AutoGen などが含まれます。主流のフレームワークを使用している場合、既存の統合パッケージがある可能性が高いです。

第5章:本番環境の実装:コスト管理とパフォーマンス最適化

デモが動いても、本番で動くとは限りません。メモリシステムを本番稼働する前に、3つの問題を解決する必要があります。パフォーマンスが十分に速いか、コストが十分に低いか、セキュリティが十分に堅牢か。

インデックス選定:精度 vs スケール

ベクトル検索のパフォーマンスのボトルネックはインデックスにあります。3つの主流の選択があります:

FLAT:ブルートフォース検索。精度は完璧だが、速度は遅い。小規模データ(1万以下)または100%の正確性が必要なシナリオに適合。

HNSW:階層型ナビゲーションスモールワールドグラフ。再現率が高く、速度が速い。中・小規模(10万〜100万級)に適合。ただし、メモリ消費が大きい。100万ベクトルあたり数 GB のメモリが必要。

IVF:転置インデックス。ベクトルをバケットに分割し、検索時にいくつかのバケットのみを検索。大規模(100万〜1億級)に適合。メモリ効率が高いが、精度はやや劣る。対象バケットに関連ベクトルが含まれていない可能性があるため。

選定ロジックは単純です。データ量が少ない場合は FLAT または HNSW、データ量が多い場合は IVF を選択します。精度要件が特に高い場合(医療診断など)、速度を犠牲にしてでも高い再現率が必要なら、HNSW を選択します。

レイテンシー最適化:秒からミリ秒へ

ユーザーが質問すると、Agent はメモリを検索、推論、回答を生成します。各段階でレイテンシーが積み重なります。全コンテキスト方式が遅い理由は、推論前に超長コンテキストを処理する必要があり、p95 レイテンシーが17秒に達する可能性があるからです。

最適化のアプローチ:検索を推論前に配置し、しかも高速に行うこと。

Redis を統一プラットフォームとして使用すると、サブミリ秒のクエリが可能です。ベクトル検索、イベントストリーム、KV ストレージを同時にサポートします。作業記憶、エピソード記憶、意味記憶をすべて1箇所に配置でき、サービス間呼び出しのネットワークレイテンシーを節約できます。

もう一つの落とし穴は「複数回推論の積み重ね」です。検索 → LLM で検索結果を整理 → さらに推論して回答、という設計があります。LLM を2回呼び出すため、レイテンシーが倍になります。より良い方法は、検索結果を直接コンテキストに注入し、1回の推論で完了させることです。

コスト管理:10倍の差の秘密

先ほど、全コンテキスト vs 選択的記憶のコスト差は10倍だと述べました。どうやって実現するのでしょうか?

核心的な戦略は3つあります:

選択的記憶:価値のある情報のみを保存し、すべての会話履歴を詰め込まない。抽出段階でノイズをフィルタリングし、保存段階で記憶数を制御します。

要約圧縮:生の会話は数千文字になる可能性がありますが、要約後は数百文字に。LLM で定期的にエピソード記憶を簡潔なバージョンに圧縮し、トークン消費を削減します。

スマート忘却:保存が無限に膨張するのを防ぐため、重要度の低い記憶を定期的にクリーンアップ。時間減衰+アクセス頻度淘汰で、記憶プールを制御可能な規模に保ちます。

Mem0 公式チームの見積もりによると、選択的記憶方式は月額コストを100万ドルから10万ドルに削減できます。主にトークンコストと保存コストの削減によるものです。

セキュリティとプライバシー:メモリ分離

メモリシステムにはユーザーデータが保存されるため、セキュリティ設計を軽視できません。

メモリ分離:各ユーザーの記憶は独立して保存され、検索時は厳密に user_id でフィルタリングします。「ユーザーAがユーザーBの記憶を検索してしまう」という事故は絶対にあってはなりません。

メモリポイズニング防御:悪意のあるユーザーが意図的に虚偽情報を入力し、Agent に間違った事実を記憶させようとする可能性があります。統合段階で検証ロジックが必要です。信頼度の低い情報には「確認待ち」マークを付け、直接長期記憶に書き込まないようにします。

データ匿名化:機密情報(電話番号、ID カード番号)は保存前に匿名化処理が必要です。検索後に復元する際も、権限管理が必要です。

整合性維持:分散ロック+リフレクション

マルチインスタンスデプロイメントの場合、メモリの整合性が問題になります。インスタンスAがある記憶を更新しても、インスタンスBは古いバージョンを使っている可能性があります。

2つのメカニズムで解決します:

分散ロック+バージョン管理:記憶を更新する前にロックを取得し、更新後に新しいバージョンを書き込みます。検索時はデフォルトで最新バージョンを取得し、古いデータを読むのを防ぎます。

定期的なリフレクション:定期的に LLM にメモリベースをチェックさせ、矛盾または古い情報を発見したら、能動的にクリーンアップまたは更新します。Alibaba Cloud AnalyticDB のソリューションには、このメカニズムが組み込まれています。

結論

結局のところ、メモリシステムは Agent の「オプション機能」ではなく、普通の LLM インターフェースと区別される核心機能です。メモリのない Agent は、毎回の会話が新しい出会いです。ユーザーを真に「理解」できず、長期タスクで一貫性を保てません。

しかし、メモリシステムを導入すればそれで終わりではありません。まず明確にする必要があります。ナレッジグラフは必要か?マネージドサービスを受け入れられるか?既存のフレームワークバインディングは何か?これらの問いに答えれば、フレームワークの選択は自然と明確になります。

まだ判断がつかない場合、LangMem または Mem0 のオープンソース版から実験を始めることをお勧めします。投資が最も少なく、効果が最も直感的です。作業記憶に慣れたら、エピソード記憶、長期記憶への拡張を検討してください。

FAQ

Agent にメモリシステムはなぜ必要なのか?LLM にはすでにコンテキストがあるのでは?

4種類のメモリタイプの違いは?それぞれ何で実装する?

Mem0、Zep、LangMem はどれを選ぶべきか?

メモリシステムのコストはどう管理する?全コンテキストは高すぎる場合は?

メモリシステムの本番稼働で注意すべきセキュリティ問題は?

ベクトルインデックスは HNSW と IVF のどちらを選ぶべきか?

10 min read · 公開日: 2026年4月23日 · 更新日: 2026年4月25日

AI 開発実践

検索からこのページに来た場合は、前後の記事もあわせて読むと同じテーマの理解がかなり早く深まります。

前の記事

MCP Server 開発入門:ゼロから始める初めての MCP サービス構築

ゼロから学ぶ MCP Server 開発!TypeScript 原生 SDK を使用して、天気照会サービスの構築をステップバイステップで解説。Tools、Resources、Prompts の完全実装を含む。フロントエンド/フルスタック開発者向け、30 分で習得可能。

第 12 / 24 記事

次の記事

AI エージェント開発実践:アーキテクチャ設計と実装ガイド

AI エージェントのアーキテクチャ設計を深く解説。ReAct、Plan-and-Execute、Multi-Agent の3つの主要パターンを比較し、5つのマルチエージェントオーケストレーションパターンを詳しく説明。Claude Agent SDK の実践的なコード例とともに、理論から実践まで網羅的に紹介します。

第 14 / 24 記事

関連記事

Workers AI 完全ガイド:毎日10,000回の無料LLM呼び出し、OpenAI比90%コスト削減

Workers AI 完全ガイド:毎日10,000回の無料LLM呼び出し、OpenAI比90%コスト削減

AIで10,000行のレガシーコードをリファクタリング:1ヶ月分の仕事を2週間で完了したリアルな振り返り

AIで10,000行のレガシーコードをリファクタリング:1ヶ月分の仕事を2週間で完了したリアルな振り返り

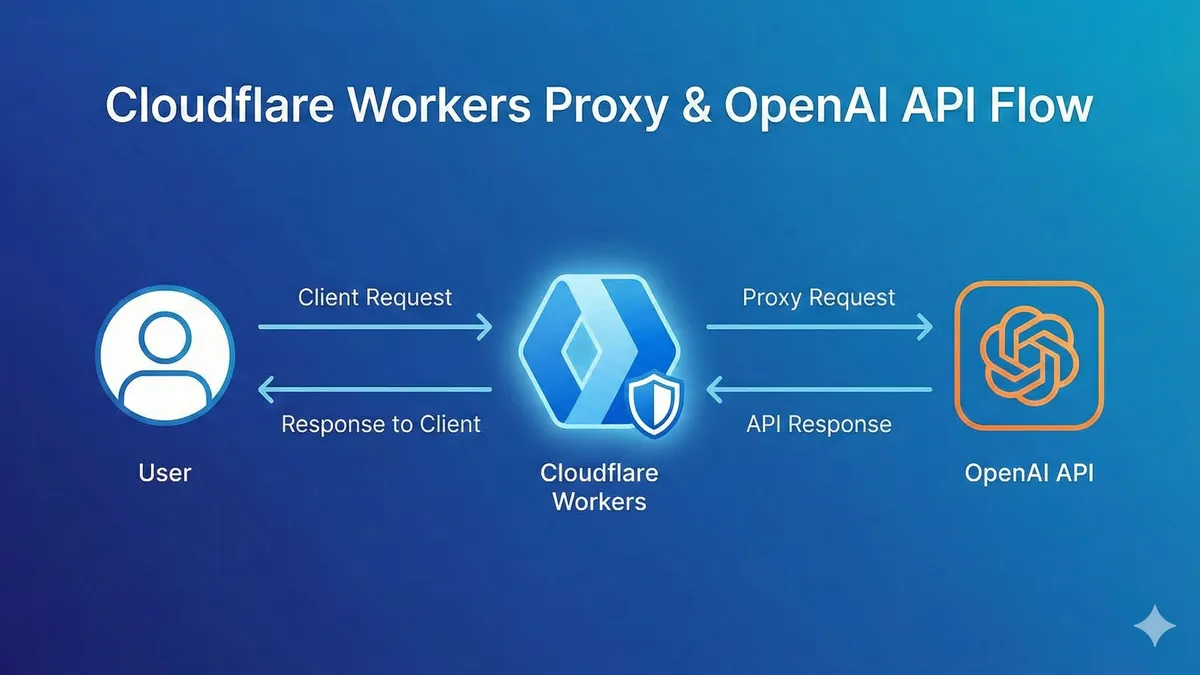

OpenAI APIがタイムアウトする?Workersで専用トンネルを構築、コストゼロで安定化

コメント

GitHubアカウントでログインしてコメントできます