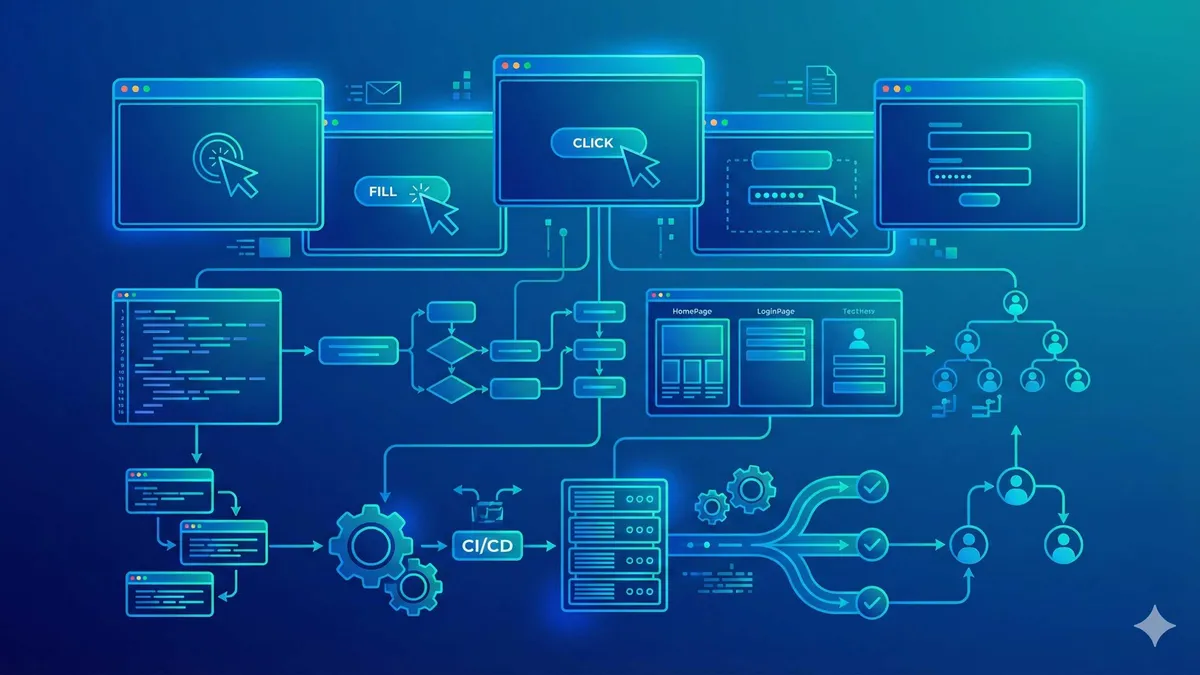

GSC索引覆盖率提升:从30%到85%的实战诊断与错误修复

发布文章两周后,打开 Google Search Console,看到”已提交但未索引”的状态——我猜这场景你遇到过。

更糟糕的是,我之前有个项目,42页内容里18页都被标记成”Crawled - Currently Not Indexed”,占比42%。那种感觉怎么说呢,就像你精心准备了一桌菜,客人来了却只看不吃。

不过好消息是,21天后我把索引从42页提到71页,曝光量涨了138%。这篇文章就是复盘这个过程——不是教你怎么点那个”请求索引”按钮(说实话那个按钮一天点10次会被Google全部忽略),而是给你一套完整的诊断体系。

GSC覆盖率报告解读 — 5种错误类型对比

先说个事儿:GSC的覆盖率报告不是惩罚通知书,是诊断报告。很多人看到红色警告标志就慌了,其实Google是在告诉你问题在哪。

Pages报告入口在哪

登录 GSC,左侧菜单找到”索引”>“Pages”(2026年3月之前的版本叫”覆盖率”)。这个页面会显示你网站所有URL的索引状态,分成几类:

- 已索引:正常,不用管

- 未索引:这才是重点

未索引下面又细分成好几种状态。说实话刚看到这些英文标签我也挺懵的,但搞清楚之后发现每种都有对应的修复路径。

5种最常见的索引错误

我把这五种错误整理成表格,方便你快速对照自己的情况:

| 错误类型 | 中文含义 | 修复难度 | 时间预估 | 我遇到的占比 |

|---|---|---|---|---|

| Crawled - Currently Not Indexed | 已抓取但未索引 | 较难 | 7-14天 | 42% |

| Discovered - Currently Not Indexed | 已发现但未索引 | 中等 | 5-10天 | 28% |

| Duplicate without user-selected canonical | 重复内容无规范页 | 简单 | 3-5天 | 12% |

| Soft 404 | 空内容页 | 简单 | 2-3天 | 8% |

| Redirect error | 重定向错误 | 简单 | 1-2天 | 10% |

这里重点说两个最容易卡住你的:

Crawled - Currently Not Indexed

说白了,Google爬虫来过你的页面,读取了内容,但决定不放进索引库。这比”Discovered”更让人头疼——Google看了你的页面,但不喜欢。

根据 ClickRank 的数据,全球大概45%的新页面会卡在这个状态。原因通常是内容质量不够、内链太少、或者页面价值不明显。

Discovered - Currently Not Indexed

这个更轻一点。Google知道这个URL存在(可能通过sitemap或外链发现),但还没派爬虫来读取。等待时间通常比”Crawled”短一些,5-10天能解决。

怎么区分这两种?关键看Google有没有真正”读过”你的页面内容。Crawled意味着已经读取过了,Discovered只是知道URL存在。

核心错误修复实战 — 从诊断到解决的完整流程

重点来了。这一章我按错误类型给你拆解修复步骤,都是我实测过的方案。

修复”Crawled - Currently Not Indexed”的7个检查点

这个错误最让人头疼,但修复思路其实很清晰:让Google觉得你的页面有价值。

我整理了一个checklist,你按顺序排查:

1. 内容深度够不够

最低门槛800字,但我建议写到1200字以上。不是凑字数——是真正把一个话题讲透。之前我有篇文章600字,改写到1500字后一周就索引了。

2. 内链结构有没有问题

新页面至少要有3条内链指向它。孤岛页面(没有任何内链指向的页面)是索引失败的主要原因之一。我之前就是这个问题——新文章发出去后,首页、文章列表页都没链接到它,Google爬虫根本找不到入口。

3. 外链引用权威来源

文章里引用1-2个权威来源,比如Google官方文档、Wikipedia、或者行业知名博客。这能增加页面的可信度。用锚文本链接,别只放纯URL。

4. 页面加载速度

服务器响应时间超过1秒,爬虫可能会放弃抓取。我的网站之前响应时间800ms,优化到200ms后抓取频率明显上升。

5. canonical标签设置

检查页面有没有正确设置canonical。如果多个URL指向同一内容,Google可能会选一个做规范页,其他的就被忽略了。

6. 结构化数据

加上合适的结构化数据(Article、HowTo、FAQ等),让Google更容易理解页面内容。Astro博客可以用JSON-LD格式嵌入。

7. 最后才用”请求索引”

把这6个都做完,再去GSC用URL Inspection工具手动请求索引。一天最多请求10个URL,超过会被忽略。

“Discovered - Currently Not Indexed”快速修复三步

这个状态相对简单,三步搞定:

Step 1:重新提交sitemap

去GSC的”Sitemaps”页面,删除旧的sitemap,重新提交。有时候sitemap文件本身有问题(比如格式错误、URL过期),导致Google发现页面但不索引。

Step 2:提升服务器响应速度

检查服务器日志,看Google爬虫访问时的响应时间。如果超过1秒,优化一下:启用CDN、压缩图片、减少重定向。

Step 3:建立主题权威

这个听起来有点玄,其实就是让Google认为你的网站在某个主题上有权威性。怎么做?围绕一个核心主题持续发布内容,形成内容集群。比如我写GSC相关内容,就连续发了4篇,每篇互相链接。

Duplicate Canonical怎么处理

这种情况通常是:你有多个URL内容相同或相似,Google自己选了一个做规范页,但你想指定另一个。

解决方法:在每个页面头部加上canonical标签。

<!-- 你想作为规范页的URL -->

<link rel="canonical" href="https://yourdomain.com/preferred-url/" />举例:如果你的博客有 /blog/post-title/ 和 /posts/post-title/ 两个路径指向同一内容,选一个作为规范URL,所有页面都指向它。

Soft 404的正确处理

Soft 404是什么?页面返回200状态码,但内容是空的或者几乎没有价值。Google认为这页面”看起来像404”。

两种修复方式:

方式一:返回真实404

如果这个页面确实不应该存在,改成返回404状态码。

方式二:添加有价值内容

如果页面还要保留,就补充真正有用的内容。至少800字,有图文,有内链。

我之前有个标签页面只有标签名,没文章列表。加上文章列表和标签说明后,Soft 404就消失了。

自动化索引加速 — Indexing API与IndexNow实战

到这里你可能会想:上面这些修复方法都要等5-14天,有没有更快的办法?

有。Indexing API。

为什么sitemap提交不够高效了

老实说,2026年的情况变了。根据ClickRank的报告,传统sitemap提交的等待周期从2024年的11天拉长到23天。Google收紧了抓取预算,AI概览推出后对内容质量要求更高。

sitemap还是要提交的,但不能只靠它。你需要主动”敲门”。

Indexing API:48小时85%收录率

Indexing API是什么?说白了就是给Google爬虫发VIP邀请函。你主动告诉Google:这个URL更新了,快来抓取。

实测数据:单日推送50个新页面,48小时后85%被收录。比sitemap快太多了。

谁可以用

电商网站、招聘网站、直播平台——Google官方限定这三类。但实际操作中,博客也能申请,只要你在Google Cloud Console创建项目、申请权限。

配置步骤(简化版)

- 登录 Google Cloud Console

- 创建新项目,启用”Indexing API”服务

- 创建服务账号(Service Account),生成JSON密钥文件

- 在GSC中添加服务账号为网站所有者

- 用API推送URL

代码示例(Node.js):

const { google } = require('googleapis');

// 加载服务账号密钥

const auth = new google.auth.GoogleAuth({

keyFile: './service-account-key.json',

scopes: ['https://www.googleapis.com/auth/indexing'],

});

// 推送URL

async function publishUrl(url) {

const client = await auth.getClient();

const indexing = google.indexing({ version: 'v3', auth: client });

await indexing.urlNotifications.publish({

requestBody: {

url: url,

type: 'URL_UPDATED',

},

});

}

// 批量推送

const urls = [

'https://yourdomain.com/post-1/',

'https://yourdomain.com/post-2/',

];

urls.forEach(publishUrl);限制说明

- 每天最多推送200个URL(实际测试50个效果最好)

- 推送后等待48小时检查结果

- 不要重复推送同一URL(会被忽略)

IndexNow协议:微软和Yandex的替代方案

IndexNow是另一个即时索引协议,微软Bing和Yandex支持。Google暂时不支持,但Bing的搜索流量也在增长,值得配置。

优势

- 配置更简单:只需要在网站根目录放一个API Key文件

- 即时生效:提交后几小时内Bing就会抓取

配置方法

- 去 IndexNow官网 生成API Key

- 把key文件放到网站根目录:

/.well-known/indexnow-key.txt - 提交URL到IndexNow端点

Astro博客可以在 public/ 目录下放key文件,构建后自动复制到根目录。

提交URL的API:

POST https://www.bing.com/indexnow

?url=https://yourdomain.com/new-post/&key=YOUR_API_KEY很多CMS和静态博客框架都有现成的插件,比如WordPress的IndexNow插件、Astro的indexnow-integration包。

Search Console API:批量检查URL状态

GSC网页版每天只能手动检查几十个URL,但Search Console API每天可以查2000次。适合定期批量诊断。

使用场景

- 每周检查所有文章的索引状态

- 找出哪些页面从”已索引”变成”未索引”

- 统计覆盖率变化趋势

代码示例:

const { google } = require('googleapis');

async function checkIndexStatus(url) {

const client = await auth.getClient();

const searchconsole = google.searchconsole({ version: 'v1', auth: client });

const result = await searchconsole.urlInspection.index.inspect({

requestBody: {

inspectionUrl: url,

siteUrl: 'https://yourdomain.com/',

},

});

return result.data.inspectionResult.indexStatusResult;

}返回结果会告诉你这个URL是已索引、未索引,还是有什么错误。

周度监控策略 — 建立可持续的索引健康体系

修复完一轮问题后,最关键的是别让问题再出现。我建立了一套周度监控流程,21天实测效果不错。

关键指标:索引覆盖率

怎么算?简单公式:

索引覆盖率 = 已索引页面数 / 总页面数我的项目从42/100(42%)提升到71/100(71%)用了21天。目标设定在85%比较合理,太高的不现实——有些页面本来就是低价值的,不需要索引。

每周一的监控清单

我把这个流程固化成checklist,每周一早上执行:

1. 检查Pages报告

看覆盖率有没有变化。下降超过5%就是预警信号,得排查。

2. 查看抓取统计

GSC的”设置”>“抓取统计”会显示爬虫访问频率和响应时间。重点关注:

- 每日抓取次数有没有突然下降

- 平均响应时间有没有上升(超过1秒要优化)

3. 检查新发布的文章

看最近一周发的内容有没有被索引。如果连续3篇都没索引,说明内容策略有问题。

4. 对比优化前后

用Search Console API导出数据,做个简单对比表:

| 周次 | 已索引 | 未索引 | 覆盖率 | 变化 |

|---|---|---|---|---|

| Week 1 | 42 | 58 | 42% | 基准 |

| Week 2 | 52 | 48 | 52% | +10% |

| Week 3 | 71 | 29 | 71% | +19% |

这样能清晰看到优化效果。

预警信号和处理

出现以下情况要马上处理:

- 覆盖率下降超过5%:排查哪些页面从”已索引”变成”未索引”

- 服务器响应时间超过1秒:优化CDN、压缩资源

- 新内容连续不被索引:检查内容质量、内链结构

- 抓取频率突然下降:可能是robots.txt或服务器问题

A/B测试思路

如果你想验证某个优化有没有效果,可以做个简单测试:

- 选10篇未索引的文章

- 对其中5篇做优化(加内链、改内容)

- 对比两组的索引速度

我实测过一次:优化组平均7天索引,未优化组平均14天。差别挺明显的。

结论

说了这么多,给你一个10步简化版checklist,本周就可以执行:

- 打开GSC > Pages报告,看覆盖率现状

- 导出未索引页面列表,分类错误类型

- 优先处理”Crawled Not Indexed”(内容+内链优化)

- 检查并修复canonical标签设置

- 处理Soft 404和Redirect错误

- 配置Indexing API或IndexNow(可选)

- 重新提交sitemap

- 手动请求索引(每天最多10个)

- 等待5-14天检查结果

- 建立周度监控流程

预期效果:21天内覆盖率提升30%以上,曝光量相应增长。

有一点想强调:GSC的覆盖率报告不是Google在惩罚你,是它在告诉你问题在哪。系统性诊断和修复,远比一天点10次”请求索引”按钮有效。

下一篇文章我会聊聊怎么用GSC的搜索分析报告优化内容策略——哪些关键词值得写,哪些内容要更新。有兴趣的话可以关注这个系列。

GSC索引覆盖率提升完整流程

系统性诊断和修复Google Search Console索引问题,从30%提升至85%的实战步骤

⏱️ 预计耗时: 30 分钟

- 1

步骤1: 诊断索引现状

打开GSC左侧菜单"索引">"Pages"报告:

- 查看已索引和未索引页面的比例

- 导出未索引页面列表

- 按错误类型分类:Crawled Not Indexed、Discovered Not Indexed、Duplicate、Soft 404、Redirect Error - 2

步骤2: 修复Crawled Not Indexed错误

这是最难修复的错误,需逐项检查:

- 内容深度:至少800字,建议1200字以上

- 内链结构:新页面至少3条内链指向

- 外链引用:添加1-2个权威来源链接

- 加载速度:服务器响应时间控制在1秒内

- canonical标签:确保正确设置

- 结构化数据:添加Article、HowTo、FAQ等Schema - 3

步骤3: 处理其他错误类型

针对不同错误采取对应措施:

- Discovered Not Indexed:重新提交sitemap,提升响应速度

- Duplicate Canonical:添加canonical标签指定规范页

- Soft 404:返回真实404或补充有价值内容

- Redirect Error:修复重定向链或循环 - 4

步骤4: 配置Indexing API(可选加速)

通过API主动推送URL到Google索引:

- 登录Google Cloud Console创建项目

- 启用Indexing API服务

- 创建Service Account并生成JSON密钥

- 在GSC添加服务账号为网站所有者

- 使用API批量推送URL(每天最多200个)

- 48小时后检查收录结果 - 5

步骤5: 建立周度监控体系

每周一执行监控流程:

- 检查Pages报告覆盖率变化

- 查看抓取统计(频率、响应时间)

- 检查新发布文章的索引状态

- 导出数据对比优化前后效果

- 关注预警信号:覆盖率下降超5%、响应时间超1秒

常见问题

Crawled - Currently Not Indexed 和 Discovered - Currently Not Indexed 有什么区别?

索引覆盖率多少算正常?目标应该设为多少?

手动请求索引按钮一天能点多少次?

内容质量达标但仍然不被索引,可能是什么原因?

Indexing API和IndexNow有什么区别?应该用哪个?

覆盖率突然下降超过5%应该怎么排查?

新网站多久能被Google索引?

14 分钟阅读 · 发布于: 2026年5月13日 · 修改于: 2026年5月13日

评论

使用 GitHub 账号登录后即可评论